近日,AI界传出了一则引人瞩目的消息:一名仅凭一篇博客文章就加入OpenAI的研究员,可能正在使用其提出的神经网络隐藏层优化器Muon来训练GPT-5。这一消息由AI云服务商Hyperbolic的联合创始人兼CTO Yuchen Jin在社交平台X上爆出,迅速引起了业界的广泛关注。

据悉,这位研究员名为Keller Jordan,他在2024年12月发表了一篇题为《Muon:神经网络隐藏层的优化器》的博客文章。文章详细介绍了Muon的设计思路、实证结果以及与其他优化器的对比。令人惊讶的是,正是这篇博客成为了Keller Jordan加入OpenAI的敲门砖。

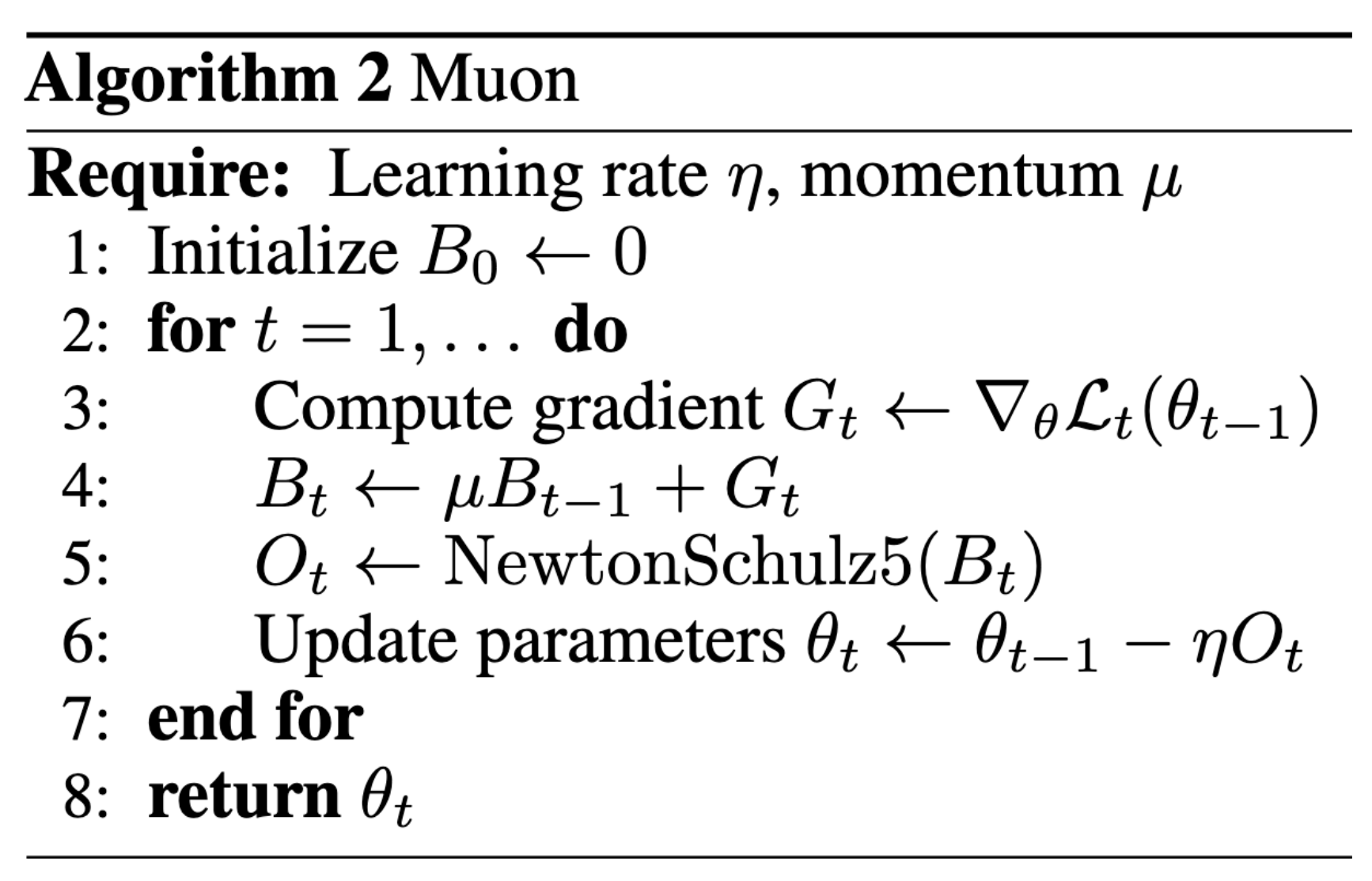

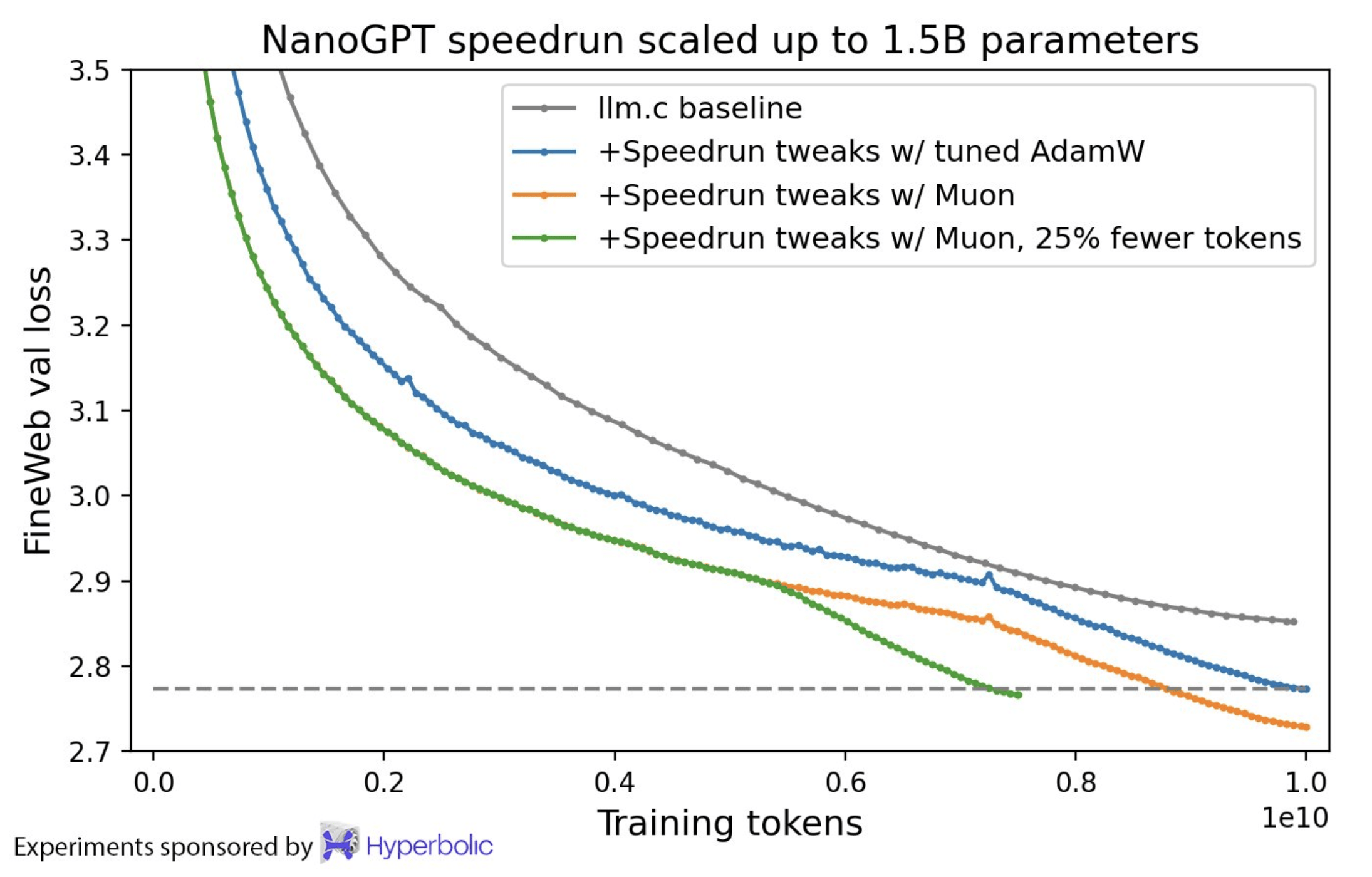

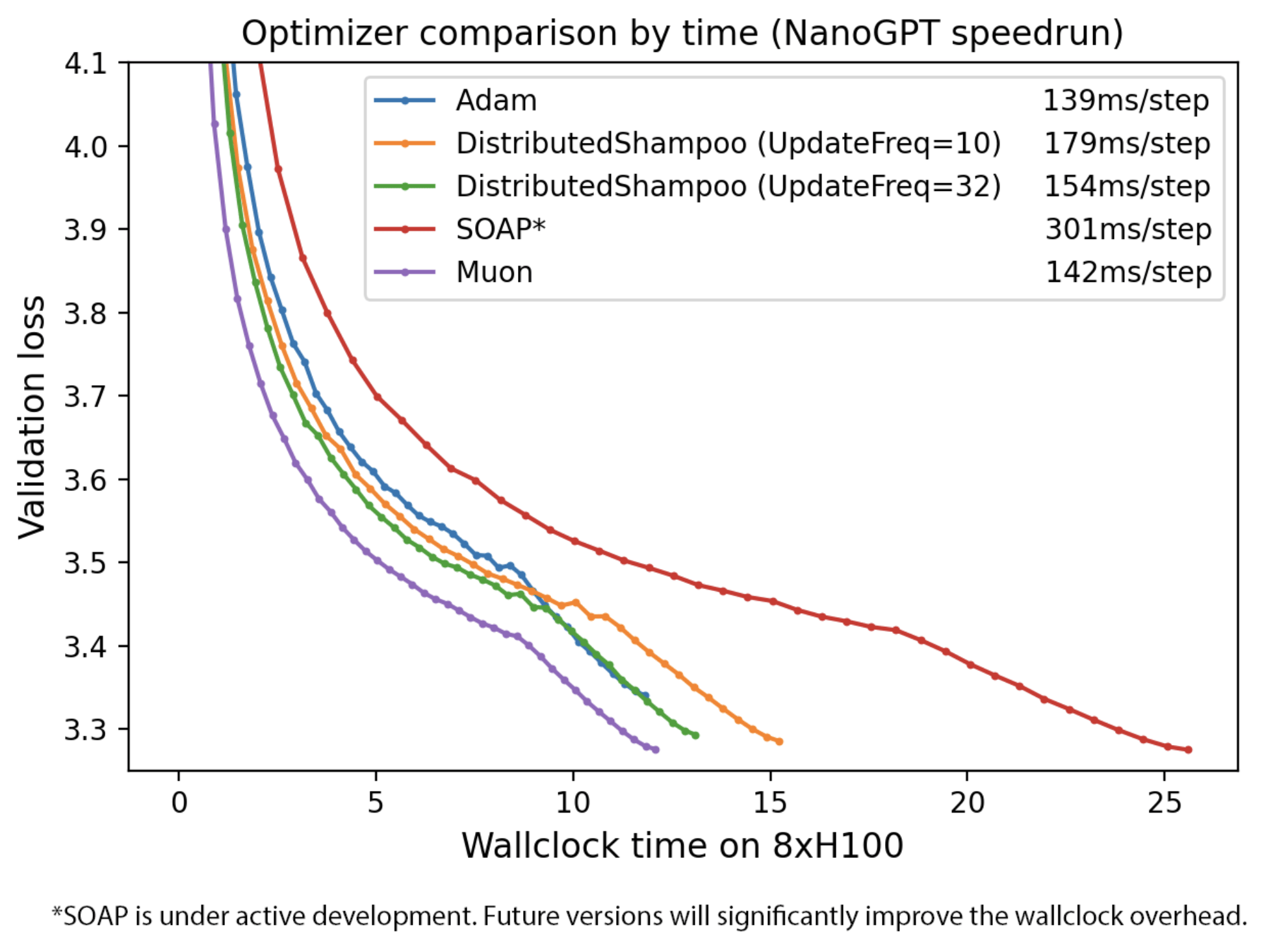

Muon是一种针对神经网络隐藏层二维参数的优化器,其设计旨在提高训练速度。Keller Jordan在博客中提到,Muon通过使用Newton-Schulz迭代法作为后处理步骤,优化了SGD-momentum生成的更新,使得更新矩阵近似正交化。这一改进在多个实证研究中取得了显著成果,包括在CIFAR-10和NanoGPT快速运行等任务上刷新了训练速度记录。

除了速度上的提升,Muon还展示了在扩展到更大规模模型时的潜力。在HellaSwag任务上,使用Muon训练了一个1.5B参数的转换器,使其达到了GPT-2 XL级别的性能,而训练时间却比使用AdamW缩短了近三分之一。这些成果无疑为Muon在大型语言模型训练中的应用提供了有力支持。

Keller Jordan在博客中还批判了当前神经网络优化研究中的一些不良风气,特别是糟糕的基线设置问题。他指出,许多声称能够击败AdamW的新优化器往往没有充分调整AdamW基线,导致结果无法复制或达到宣传效果。为了纠正这种情况,他提出了更高的证据标准,要求新方法必须在竞争性训练任务中取得成功。

这一观点在业界引起了广泛共鸣。许多研究人员表示,他们曾经浪费了大量时间和精力在复制和构建这类无法达到预期效果的方法上。Keller Jordan的提议为神经网络优化研究提供了新的方向,强调了实证研究和竞争性任务的重要性。

随着Muon在OpenAI的潜在应用被曝光,业界对这一新技术的期待进一步升级。许多专家表示,如果Muon确实能够成为GPT-5的重要部分,那么它将为大型语言模型的训练带来革命性的变化。不过,也有一些人对Muon的可扩展性和在大型GPU集群中的分布能力表示担忧。

尽管如此,Keller Jordan的博客文章已经为Muon赢得了广泛的关注和认可。这一技术的出现不仅为神经网络优化研究提供了新的思路和方法,也为AI界的发展注入了新的活力。随着研究的深入和应用的拓展,我们有理由相信Muon将在未来发挥更加重要的作用。