自2017年Transformer架构问世以来,人工智能领域迎来颠覆性变革,大语言模型(LLMs)从实验室走向千行百业,成为推动全球数字化转型的核心引擎。从早期以BERT、GPT-3为代表的技术突破,到如今GPT-4、Gemini等多模态模型的崛起,再到国产开源模型DeepSeek-R1、通义千问的异军突起,全球大模型竞争已从参数规模比拼转向技术架构创新、场景落地能力与成本控制等维度。本文基于公开技术资料与实测数据,梳理国内外代表性大模型的技术特征、核心优势与现存局限,呈现当前大模型发展的真实格局。

国外大模型起步早,依托深厚的技术积累与算力支撑,在通用能力与前沿探索上保持领先。OpenAI的GPT系列作为生成式AI的标杆,从GPT-3的千亿参数突破到GPT-4的多模态融合,始终引领技术方向。其核心架构采用Transformer解码器,通过自回归预测机制实现文本生成与对话交互,后续逐步整合图像、音频、视频等多模态能力。GPT系列的生成能力在创意写作、代码生成等场景中表现突出,GitHub Copilot等工具便依托其代码理解能力。然而,幻觉问题、长文本处理局限与高昂的训练成本仍是其主要短板。例如,GPT-4训练成本高达数亿美元,依赖大规模GPU集群,中小企业难以承担部署费用。

Google的Gemini系列则以多模态处理与推理性能见长。其核心架构融合编码器与解码器优势,采用混合专家(MoE)架构,在视频语义理解、复杂推理等领域实现突破。Gemini 3.1 Pro在推理速度、3D理解等方面登顶全球性能榜单,手术操作步骤识别准确率达91%。但Gemini系列中文处理能力较弱,预训练数据以英文为主,在中文语义理解与文化语境适配上不及国产模型。其API开放力度不足,开发者生态完善度有待提升,导致模型在第三方场景中的落地速度较慢。

Anthropic的Claude系列以安全合规为核心定位,采用Transformer编码器-解码器混合架构,在保持生成能力的同时,重点优化安全对齐与长文本处理。其内置道德对齐框架,拒绝生成有害内容的准确率高达99.8%,适合法律文书生成、心理咨询等高安全性场景。Claude Opus 4.6的上下文窗口可达10万token,能在22秒内完成长篇小说级别的精准修改。然而,其生成创意性略逊于GPT系列,多模态融合能力起步较晚,目前仅支持文本与图像的基础交互,音频、视频处理能力仍落后于竞争对手。

国内大模型发展虽起步稍晚,但依托庞大的中文数据资源与场景优势,追赶速度极快。阿里通义千问以中文处理能力与开源生态见长,其Qwen系列模型跻身全球重要榜单,衍生模型数量突破10万,超越Llama成为全球第一开源大模型体系。通义千问在中文古籍理解、文言文处理等场景中表现优异,准确率达92.3%,同时支持3D模型生成与长视频摘要,电商场景商品描述生成准确率达98%。然而,其复杂推理能力与国际化能力仍有提升空间,多语言处理以中文为主,难以满足国际化场景需求。

字节跳动的豆包模型则以轻量化部署与日常体验优化为核心。通过模型压缩技术,豆包实现手机端实时推理,iPhone 15 Pro Max等终端设备上的推理延迟低于300ms,成本仅为云端方案的1/10。其日常对话交互体验极佳,情感交互准确率达85%,支持方言识别,贴合日常使用场景。在短视频领域,豆包支持脚本生成、特效建议与自动剪辑全流程,创作效率提升10倍。但豆包的专业领域知识深度不足,复杂推理与代码生成能力较弱,难以满足科研、编程等专业场景需求。

深度求索的DeepSeek-R1以高性价比与推理能力突出重围。其采用稀疏MoE架构,训练费用低于600万美元,推理成本仅为GPT-4o的3%,支持无GPU本地部署。DeepSeek-R1在数学推理、代码生成等场景中表现优异,GSM8K数学推理准确率达98.7%,代码生成通过率达92%。然而,其多模态处理能力较弱,目前主要聚焦于文本处理,图像、音频、视频等多模态能力尚未完善,与GPT-4、Gemini等模型存在差距。

百度文心一言则依托搜索增强能力与中文场景深耕,实时接入百度搜索数据,知识覆盖时效性提升至分钟级,在舆情分析、实时资讯总结等场景中表现突出。其企业服务能力完善,提供API+私有化部署双模式,已接入500+企业系统,金融领域智能投研报告生成效率提升3倍。但文心一言的多模态融合能力与复杂推理能力仍有提升空间,图像、视频处理的精准度与流畅度不足,开源生态建设滞后于通义千问与DeepSeek-R1。

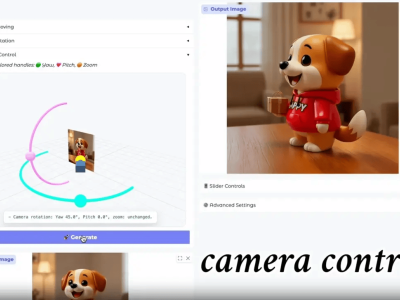

当前,全球大模型发展呈现技术架构统一、多模态融合加速、场景适配为核心竞争力等共性特征。Transformer架构成为主流,MoE架构通过动态激活专家层实现算力效率与模型性能的平衡。多模态融合从单一文本处理向“文本-图像-音频-视频”全模态延伸,全模态理解与生成成为竞争焦点。场景适配方面,国外模型侧重通用生态构建,国产模型则聚焦本土场景与垂直行业适配,如医疗、教育、工业等领域。

然而,大模型发展仍面临算力与成本压力、数据隐私与伦理风险、多模态融合瓶颈等挑战。训练千亿参数以上模型需千万级GPU小时,单模型训练成本高达数千万甚至数亿美元,中小企业难以承担。数据隐私泄露、模型生成内容真实性难以保证等问题日益凸显,幻觉问题与有害内容生成风险对安全对齐与伦理规范提出更高要求。跨模态信息语义对齐难度较大,多模态生成的精准度与流畅度有待提升,技术同质化与端侧部署难度大等问题也制约着行业发展。

对于用户而言,选择大模型需根据自身场景与需求,而非盲目追求“最顶级”的产品。日常对话、中文场景适配等需求,国产模型已能满足;复杂推理、多模态生成等场景,国外顶级模型仍具优势;编程、科研辅助等需求,开源模型的高性价比更具吸引力。随着技术不断成熟与规范,大模型将真正成为“数字时代的电力”,赋能千行百业的智能化转型。