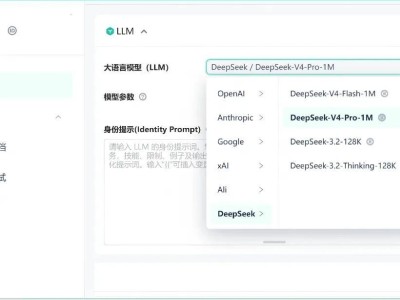

华为云宣布完成对DeepSeek-V4大模型的全球首发适配,并同步开放开发者调用接口。此次适配的V4-Flash版本通过参数优化将模型规模缩减至2840亿,在保持核心性能的同时显著降低推理成本,其API服务已实现百万级上下文的高效处理能力。

据技术文档披露,DeepSeek-V4突破性地支持原生1M超长上下文窗口,在智能体协作、跨领域知识整合及复杂逻辑推理等维度达到国内开源模型领先水平。华为云MaaS平台通过系统级优化,在调度算法、算子加速和集群通信三个层面实现突破,使新模型在保持96%以上精度的情况下,推理速度提升40%,数据吞吐量增加3倍。

针对企业级应用场景,华为云特别开发了分层注意力压缩机制,有效解决长文本处理中的算力瓶颈问题。该技术使V4-Flash模型在保持128K标准上下文处理能力的基础上,扩展至百万级文本处理时仍能维持稳定性能。目前金山办公、360集团等企业已通过华为云API接口完成模型接入,在智能文档处理、安全检测等场景展开应用测试。

华为云平台同步推出开发者支持计划,提供从模型微调到部署落地的全流程工具链。开发者可通过MaaS平台直接调用优化后的V4-Flash API,享受免部署、按需计费的服务模式。据内部人士透露,定位高端场景的DeepSeek-V4-Pro版本已完成最终测试,预计将在本周内正式上线,该版本将进一步强化多模态交互和实时学习能力。