在AI领域,一款名为DeepSeek R1的大模型在问世仅128天后,便迅速在业界掀起了波澜。这款模型以其独特的策略,对整个大模型市场产生了深远的影响。

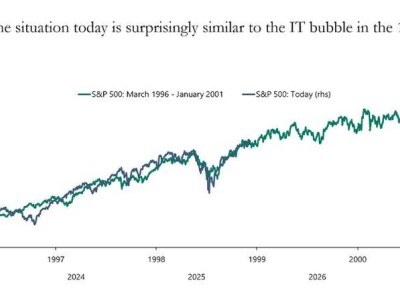

DeepSeek R1的推出,首先在大模型价格方面带来了显著变化。据悉,OpenAI在六月更新的o3价格相较于之前的o1版本,直接打了两折。这一变化无疑与DeepSeek R1的竞争力息息相关,它凭借强大的性能和相对较低的价格,成功打破了市场的平衡。

与此同时,DeepSeek模型在第三方平台上的使用量呈现出爆炸式增长。与刚发布时相比,使用量增长了近20倍,这一惊人的增长速度不仅推动了DeepSeek自身的普及,也为众多云计算厂商带来了可观的收益。

然而,令人意外的是,尽管DeepSeek在第三方平台上大放异彩,但其自家网站和API的市场份额却并未随之提升,反而出现了下滑趋势。这一变化与AI产品市场整体持续增长的趋势形成了鲜明对比,引发了业界的广泛关注。

据SemiAnalysis发布的一份报告指出,DeepSeek之所以能够在价格上占据优势,很大程度上得益于其在服务质量上所做的妥协。用户在DeepSeek官方平台上使用模型时,往往需要等待数秒才能看到第一个字符的出现,这一延迟现象相较于其他平台显得尤为明显。尽管DeepSeek V3与R1模型在版本更新后性能有所提升,但延迟问题并未得到有效解决。

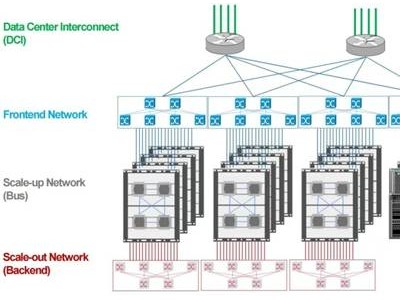

报告还指出,DeepSeek在推理计算资源上进行了精心调配,将有限的资源更多地用于内部研发,而非外部推理服务。这一策略导致DeepSeek在官方平台上提供的上下文窗口大小相较于其他主流模型提供商显得较小,无法满足一些特定场景下的需求。因此,许多用户转而选择第三方平台,以获取更大的上下文窗口和更快的响应速度。

尽管DeepSeek在官方平台上的表现不尽如人意,但其开源策略却为其赢得了广泛的影响力和生态培养机会。许多云服务提供商纷纷托管DeepSeek模型,进一步推动了其普及和应用。

在DeepSeek的影响下,其他大模型供应商也开始调整策略。例如,Claude为了缓解算力紧张的问题,降低了输出速度,但仍努力平衡用户体验。Claude模型还被设计成生成更简洁的回复,以在同等条件下减少token的使用量。

随着AI竞赛的日益激烈,大模型供应商们正在不断探索新的优化策略。他们不再仅仅追求模型的智能上限,而是更加注重提升每个token所能提供的智能。这一趋势无疑将推动AI技术的进一步发展,为用户带来更加高效、智能的体验。