人工智能领域迎来重大突破,开源模型DeepSeekMath-V2在国际数学奥林匹克(IMO)2025竞赛中斩获金牌,其表现不仅超越谷歌DeepMind的Gemini Deep Think,更在多个权威数学基准测试中展现出统治力。这一成果标志着开源AI在复杂推理任务中首次达到人类顶尖水平,为通用人工智能(AGI)发展开辟了全新路径。

该模型基于DeepSeek V3.2 Exp Base架构构建,在IMO-ProofBench测试中破解5道难题(满分6题),达到金牌标准;在中国数学奥林匹克(CMO)2024和普特南数学竞赛(Putnam)2024中分别取得金牌水平和118分(满分120分)的惊人成绩,后者甚至超越人类历史最高分90分。研究团队通过创新训练方法,使模型具备自主生成、验证和修正数学证明的能力,彻底改变了传统AI依赖标准答案的训练模式。

核心突破在于"自验证"机制的引入。团队设计了一套包含生成器、验证器和元验证器的三重系统:生成器负责解题并自我评估,验证器对证明过程进行严格打分,元验证器则监督验证器的准确性。这种"左右互搏"的架构形成闭环训练:生成器不断产出更复杂的证明,验证器随之提升判别能力,元验证器确保评分公正性。实验数据显示,元验证机制使验证器分析质量从0.85提升至0.96,同时保持打分准确率。

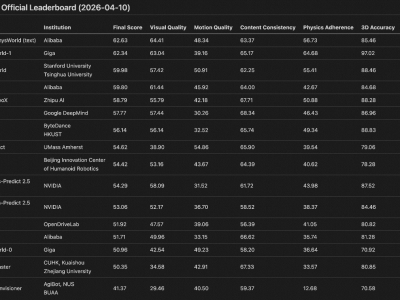

在直接对比中,DeepSeekMath-V2展现双重优势。基础测试集ProofBench-Basic上,其性能已超越谷歌Gemini Deep Think;高级测试集ProofBench-Advanced中则紧追不舍。更关键的是,该模型在"一次做对"能力测试(CNML)中全面碾压GPT-5-Thinking-High和Gemini 2.5-Pro:代数题目得分远超对手,几何题目成绩接近Gemini的三倍,数论与组合领域同样稳居第一梯队。这证明其底层推理能力已达到新高度。

真正颠覆性的是模型的自我修正能力。面对IMO候选题时,允许8次自我验证可使证明质量分数从0.15跃升至0.27;若从32个解法中筛选最优方案,评分更可达到0.42。这种"自知之明"源于高算力搜索策略——每道题生成64个候选证明,每个证明接受64次独立验证,仅完全通过考验的方案才会被采纳。正是这种严苛流程,使其在IMO 2025中攻克5题,在CMO 2024中达到金牌水平。

技术细节方面,研究团队训练了基于大语言模型(LLM)的验证器作为奖励函数,通过扩展验证器算力标注更复杂证明,形成"生成-验证-优化"的强化学习循环。这种设计使模型能处理没有标准答案的开放式问题,在最终输出前主动发现并修正错误。自动化标签生成流程在最后两轮训练中完全替代人工标注,且标签质量与专家判断高度一致。

开源特性成为该模型另一大亮点。与谷歌、OpenAI的封闭系统不同,DeepSeekMath-V2完整公开技术路径和训练方法,为全球AI社区提供可复现的参考范式。这种开放性或将改变高端AI研发格局——当自验证能力成为核心指标,单纯堆砌算力的竞争模式可能被更具智慧的训练方法取代。正如实验所示,模型对未解问题的漏洞识别准确率与已解问题的验证通过率形成鲜明对比,有力证明了LLM作为可靠数学验证者的潜力。

从模仿人类语言到模拟人类思考,AI正经历质变。当机器开始在输出结果前自我质疑、反复推敲,这种"推翻自己"的勇气或许正是智慧诞生的标志。DeepSeekMath-V2的突破提醒我们:真正的智能不在于瞬间给出答案,而在于理解自身局限并持续进化的能力。这场数学竞赛的胜利,或许只是AI自我进化征程的起点。