当空气炸锅发出“叮”的一声提示音,还没等你反应过来,一个AI声音抢先说道:“好了,它已经叮了。”这不是科幻电影里的场景,而是面壁智能最新开源的全模态模型MiniCPM-o4.5带来的真实体验。这款模型突破了传统AI“一问一答”的交互模式,实现了边看、边听、主动说的全新能力。

在厨房场景中,只需将手机放置一旁,MiniCPM-o4.5就能同时处理视觉和听觉信息。当用户询问水果价格时,模型会结合持续观察的货架变化给出实时回答;在电梯场景中,它能够识别楼层变化并在到达指定楼层时主动提醒。这种持续感知能力使其更像一位随时待命的助手,而非需要反复唤醒的工具。

该模型的核心突破在于引入全双工多模态实时流机制。传统模型采用串行处理方式,必须完成输入接收后才能生成输出,而MiniCPM-o4.5通过并行处理架构,使视频/音频输入流与语音/文本输出流同步运行。这种设计让模型在说话时仍能接收新指令,甚至能被中途打断并即时响应。

技术实现层面,研发团队对模态编码器与解码器进行流式升级,采用文本与语音token交错建模技术提升语音生成稳定性。通过时分复用机制,模型在毫秒级时间线上统一处理多模态信息,实现高效的流式交互。在对话时机判断上,模型以1Hz频率持续进行语义分析,取代了传统的语音静音检测机制。

实际测试中,模型展现出惊人的临场反应能力。当它正在描述画面中的蓝色鸭子时,测试人员突然插入询问黄色鸭子位置的新指令,模型在完成当前句子后立即切换回答。这种即时自由对话能力,标志着AI交互从回合制转向连续实时模式。

在性能基准测试中,仅9B参数规模的MiniCPM-o4.5在全模态理解、视觉解析、语音克隆等多个维度达到行业领先水平。其端到端全模态架构通过稠密特征直接连接各模态组件,使视觉、音频信息在模型生成输出的同时持续更新,这种设计特别适合需要持续感知的场景。

这款模型的推出反映了AI技术的重要转向。传统问答式AI如同对讲机,而MiniCPM-o4.5更像持续运行的智能体,能够在感知环境的同时参与对话。这种特性使其在具身智能、车载助手、复杂系统控制等领域具有独特优势,因为这些场景需要AI在动态环境中做出实时决策。

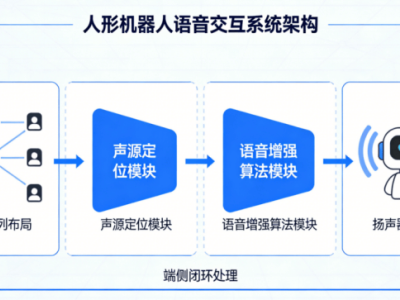

作为端侧AI的坚定践行者,面壁智能将MiniCPM-o4.5定位为赋能终端的基础模型。公司自2022年成立以来就专注端侧部署,与芯片厂商建立深度协同机制,在模型训练阶段即针对端侧芯片进行优化。这种软硬一体化的研发模式,解决了隐私保护、延迟控制等云端方案难以克服的痛点。

据透露,该模型将与面壁计划年中发布的AI开发板松果派配套推出,实现开箱即用的端侧智能硬件开发。这种模型与硬件的深度适配策略,旨在打通端侧AI落地的最后一公里。面对日益激烈的端侧市场竞争,面壁智能强调其差异化战略:专注于端侧领域并将技术做到极致。

当前,手机、汽车、机器人等终端设备对大模型的需求已从质疑转向共识。MiniCPM-o4.5的发布展示了端侧AI的新可能——通过持续感知与实时交互,让智能助手真正融入现实世界的连续时空。这种技术演进不仅改变了人机交互方式,更为AI在物理世界的深度应用开辟了新路径。

相关资源已通过多个平台开放:GitHub开源代码库、HuggingFace模型空间及ModelScope模型库均提供完整技术文档。开发者可通过专属体验链接测试全双工模式与图文对话功能,亲身感受下一代AI交互方式的革新。