大模型(LLM)算力竞赛正向更底层、更专业的芯片领域深入。2026 年 2 月 24 日,由前谷歌 TPU 资深工程师创立的 AI 芯片初创公司 MatX 宣布完成 5 亿美元(约合 34.45 亿元人民币)的 B 轮融资。

本轮融资阵容豪华,不仅吸引了世芯电子(Alchip)与美满电子(Marvell)等半导体巨头的战略参与,也获得了多家顶尖投资机构的重金押注。

核心武器:MatX One 芯片MatX此次融资的核心底气源于其正在研发的下一代处理器——MatX One。该芯片旨在解决大模型推理中“高吞吐”与“低延迟”难以兼得的痛点:

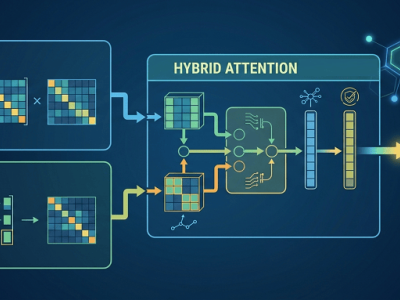

创新架构:采用“可分割脉动阵列”结构。这种设计巧妙地结合了大阵列的极致能效与小阵列的调度灵活性,实现了硬件利用率的最大化。

存储黑科技:MatX One 融合了 SRAM 设计的极低延迟 与 HBM(高带宽内存)方案的长上下文处理能力,突破了传统架构的存储瓶颈。

全场景适配:无论是基础的预填充(Prefill)、高频的推理解码,还是复杂的强化学习训练,MatX One 均能提供业界领先的性能表现。

商业前景:更低的 LLM 使用成本在当前的算力市场中,如何降低 Token 的产出成本是所有模型厂商的共同目标。援引MatX的官方说法称,其产品有望实现比肩甚至超越传统芯片的吞吐效率,从而大幅压低大模型的部署与维护门槛。

行业扫描:AI 芯片战事正酣MatX的异军突起只是全球AI 芯片爆发潮的一个缩影。近期行业内动态频频:

SambaNova 发布了第五代 RDU 芯片,并与英特尔达成深度合作。

Positron 公布了 Asimov 芯片,宣称每瓦效能可达英伟达 Rubin 架构的 5 倍。

国内突破:我国科研团队近期成功开发出成本不到 1 美元的柔性 AI 芯片,可经受 4 万次弯折,预示着可穿戴 AI 硬件的新可能。