量子计算正从实验室走向实际应用,量子编程能力成为衡量人工智能(AI)技术前沿性的新指标。近日,一项由多国科研机构联合完成的研究通过系统性测评揭示,当前主流大语言模型在量子代码生成任务中表现参差不齐,框架差异对成绩影响显著,即便最先进的模型也难以稳定输出正确结果。该研究已以预印本形式发布于arXiv平台,并为行业提供了首个跨框架量子编程测评基准QuanBench+。

与传统程序不同,量子程序的输出具有概率性特征。量子比特可同时处于“0”和“1”的叠加态,测量结果仅在运行时刻随机坍缩,导致相同程序多次运行可能产生不同结果。研究团队为此引入KL散度作为核心评估指标,通过量化AI生成结果与标准答案的概率分布差异来判断正确性,而非简单比对输出值。这种设计解决了量子程序测评中“结果可重复性低”的难题,为行业建立了更科学的评估标准。

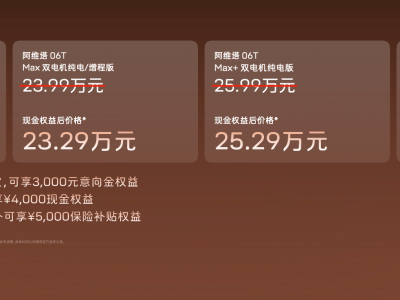

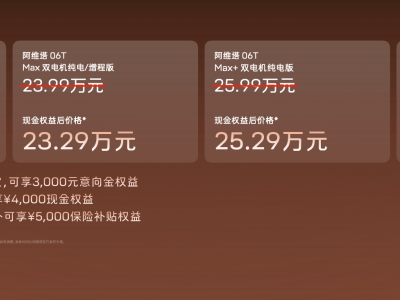

测评覆盖Qiskit、PennyLane和Cirq三大主流量子编程框架,包含42道涵盖量子算法、态制备和门分解三类任务的题目。研究团队对12个具有代表性的大语言模型进行测试,包括GPT-5.1、Gemini 3 Pro等闭源商业模型,以及Qwen 2.5、DeepSeek-R1等开源模型。测评结果显示,框架熟悉度对模型表现影响巨大:Qiskit框架下最高通过率达59.5%,而PennyLane框架下最高通过率仅42.9%。这种差异源于训练数据分布——作为最早开源的框架,Qiskit拥有更丰富的网络代码资源,使AI对其API调用更熟练。

在单次作答(Pass@1)测试中,即便是表现最佳的Gemini 3 Pro模型,在Qiskit框架下也仅能答对约25道题。当允许生成五个答案并取最优结果(Pass@5)时,GPT-5.1在Qiskit框架下的通过率提升至76.2%,但PennyLane框架下仍不足60%。进一步引入反馈修复机制后,强模型通过率可突破80%,但仍有近20%的任务无法通过任何方式解决。研究指出,这类顽固错误多源于量子逻辑理解缺陷,而非简单的语法或API调用问题。

测评数据揭示了模型能力的结构性短板。在46.7%的首次失败案例中,AI生成的程序存在根本性逻辑错误或算法实现偏差,这类错误即便经过五轮反馈修复仍无法纠正。相比之下,语法错误、量子比特规格错误等“低级错误”通过反馈机制可快速消除,占比从初始的16.5%降至3.3%。这表明当前模型在量子计算领域的优势主要来自框架代码的模式匹配,而非对量子力学原理的深度理解。

研究团队通过热力图分析揭示了任务难度分布。在Qiskit框架下,强模型可覆盖约70%的任务,但仍有10%的题目对所有模型构成挑战;PennyLane框架下仅40%的任务被有效覆盖,凸显跨框架泛化能力的不足。值得注意的是,部分在Pass@1测试中表现空白的任务,在Pass@5测试中通过率显著提升,说明模型具备潜在能力但稳定性不足。

为降低框架差异对测评的干扰,研究团队设计了标准化测试流程。所有模型在统一Python环境中运行,使用固定版本的三大框架,题目表述仅在库导入和API调用方式上适配不同框架。测评全程自动化完成,从代码提取、环境运行到结果比对均无需人工干预,确保了评估的客观性。研究代码和数据集已开源,为后续研究提供了可复现的基准平台。

这项研究为量子计算与人工智能的交叉领域提供了重要参考。当前模型在量子编程任务中的表现表明,提升训练数据多样性、优化跨框架代码生成能力,以及开发专门针对量子逻辑的推理机制,将是突破现有瓶颈的关键方向。随着量子硬件性能的持续提升,构建更智能、更可靠的量子编程助手,将成为推动量子计算实用化的重要环节。