近日,阿里巴巴旗下的通义万相团队宣布了一项重大技术进展,正式开源了名为Wan2.1-VACE的视频编辑与生成统一模型。这一创新成果在视频处理领域引起了广泛关注,被视为业界功能最为全面的视频生成与编辑解决方案。

Wan2.1-VACE模型以其强大的多功能性著称,能够在一个单独的模型架构内实现多种视频处理任务。这包括从文本生成视频、基于图像参考的视频生成、视频重绘、局部编辑、背景延展以及时长延展等。更令人瞩目的是,它还支持多任务组合生成,这意味着用户可以在一个流程中完成多个复杂的视频编辑操作。

该模型基于通义万相V2.1平台开发,提供了1.3B和14B两种参数规模的版本以满足不同需求。轻量级的1.3B版本能够在消费级显卡上流畅运行,支持480P视频输出;而14B的满血版则支持更高的分辨率,包括480P和720P,并提供更优质的处理效果。开发者可以通过GitHub、Huggingface以及魔搭社区等平台下载并体验这一模型。

在实际应用中,Wan2.1-VACE展现出了极高的灵活性和实用性。例如,它可以将一幅竖版的《蒙娜丽莎》静态图像转换为横版动态视频,并根据另一幅参考图像为其添加眼镜,这一过程同时完成了画幅扩展、时长延展和图像参考三项任务。这种能力不仅简化了视频创作的流程,还极大地拓宽了创意的边界。

该模型的核心优势在于其支持多任务灵活组合处理的能力。传统上,完成类似的视频编辑任务可能需要多个模型串联工作,流程复杂且效率低下。而Wan2.1-VACE则通过单一模型实现了任意基础能力的自由组合,用户无需针对特定功能训练新的专家模型,即可完成更复杂的任务。

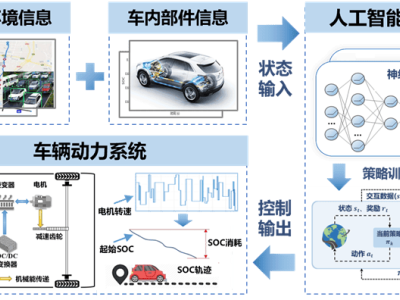

Wan2.1-VACE在技术创新方面也取得了显著突破。它引入了全新的视频条件单元VCU,这一创新设计在输入形态上统一了文生视频、参考图生视频、视频生视频以及局部视频生视频四大类视频生成和编辑任务。VCU将多模态的各类上下文输入转化为文本、帧序列和Mask序列三大形态,从而实现了多任务自由组合的技术基础。

在解决多模态输入难题方面,Wan2.1-VACE也展现出了其独特的优势。它将VCU输入的帧序列进行概念解耦,分别重构为可变序列和不可变序列后进行编码,从而有效解决了token序列化的问题。

随着Wan2.1-VACE的开源,视频生成技术正迎来从单任务向多任务组合迈进的重要阶段。这一创新成果不仅为视频创作者提供了更为便捷和高效的工具,也为视频处理领域的未来发展开辟了新的道路。