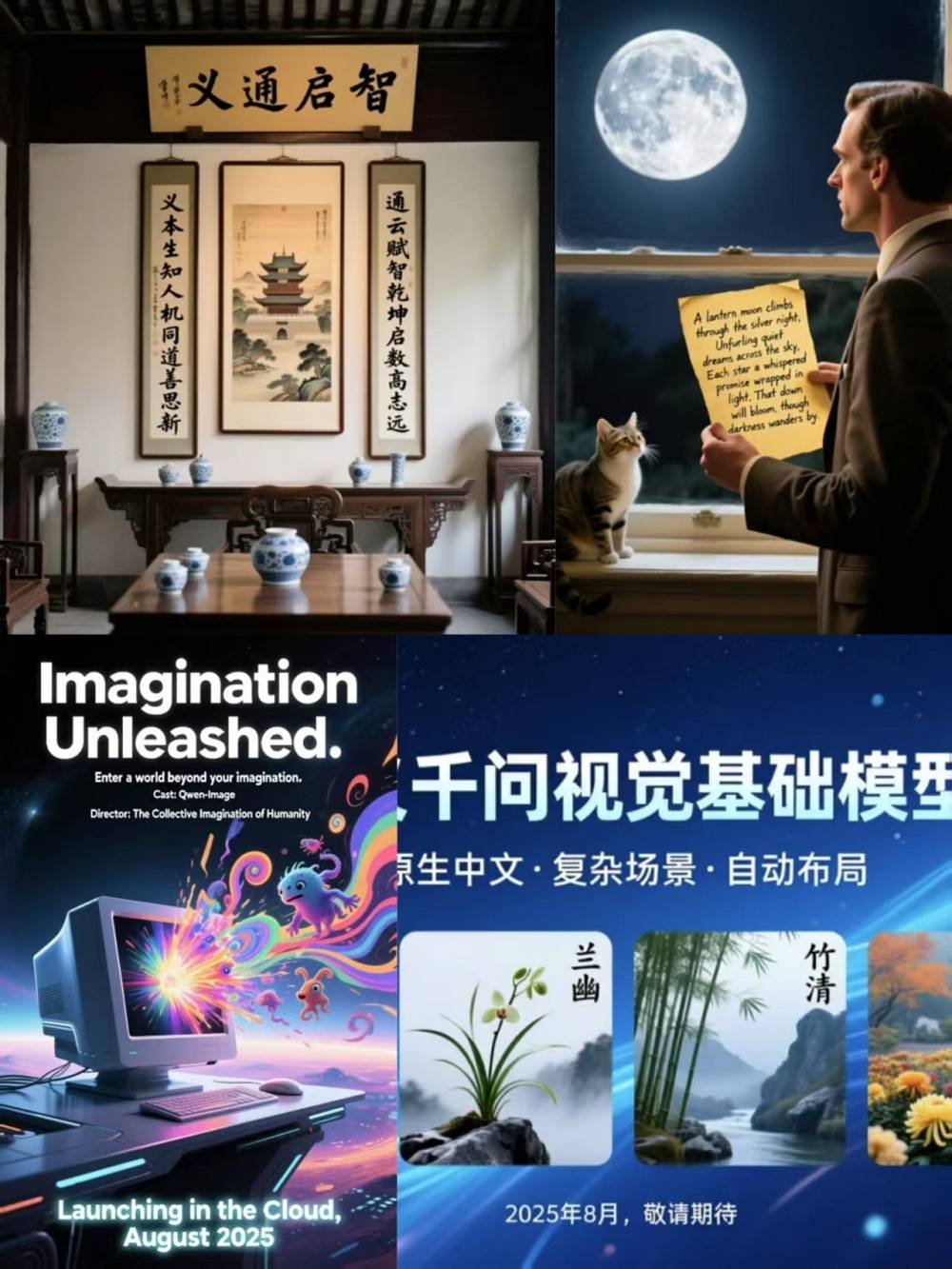

近日,阿里巴巴正式推出了其通义千问系列中的首个图像生成基础模型——Qwen-Image。这款模型的问世,标志着国产图像生成技术迈上了一个新的台阶,以其卓越的复杂文本渲染能力,引起了业界的广泛关注。

Qwen-Image的核心竞争力在于其强大的文本处理能力。无论是在何种场景中,它都能精准地生成多种语言和风格的文字。尤为它甚至能够模拟毛笔书法,或是直接生成包含文本和图像的PPT页面。这一特性,无疑为图像生成技术在各类实际应用中开辟了更广阔的空间。

在实际测试中,Qwen-Image展现出了令人惊艳的表现。例如,在根据提示词生成“宫崎骏”风格的图像时,它不仅准确捕捉到了风格要求,还巧妙地结合了构图的景深变化,将“云存储”、“云计算”等字样自然地融入画面。这种文字与画面的完美融合,充分展示了Qwen-Image在复杂文本渲染方面的实力。

除了文本处理,Qwen-Image在通用图像生成方面也同样出色。从照片级的写实场景到印象派的绘画风格,从动漫风格到极简设计,它都能游刃有余地应对。这种多元化的艺术风格支持,使得Qwen-Image在图像生成领域具有极高的灵活性和适用性。

据了解,Qwen-Image采用了MMDiT(多模态扩散Transformer)架构,其中“MM”代表模型的多模态内容生成能力,“DiT”则代表其基于扩散的Transformer结构。这一架构的采用,为Qwen-Image提供了强大的技术支撑,使其在多个公开基准测试中取得了优异的成绩。

在与全球头部的开源、闭源图像生成模型的对比中,Qwen-Image共获得了12项SOTA(最佳表现)认证。特别是在通用图像生成测试、图像编辑测试以及文本渲染测试上,它都展现出了超越其他模型的实力。尤其是在中文文本渲染方面,Qwen-Image更是大幅领先现有的最先进模型。

目前,Qwen-Image已在魔搭、Hugging Face等社区开源,用户可以在QwenChat平台中直接体验这款模型。同时,Qwen-Image的技术报告也已同步开源,详细揭秘了这款模型的具体技术实现。

在图像编辑方面,Qwen-Image同样表现出色。它能够根据用户的提示词,对原始图像进行精准的修改,同时保持视觉一致性和语义连贯性。这一特性,使得Qwen-Image在图像编辑领域具有极高的应用价值。

Qwen-Image的架构由三个核心组件构成:Qwen2.5-VL多模态大语言模型作为条件编码器,负责提取文本特征;Wan-2.1视频生成模型的分自编码器作为图像分词器,负责将图像压缩为潜在表示;多模态扩散Transformer作为主干扩散模型,负责在文本引导下建模噪声与图像潜在表示之间的复杂联合分布。

为了提升模型的性能,Qwen团队在数据工程、渐进式学习策略、增强的多任务训练范式以及可扩展的基础设施优化等方面进行了大量的工作。他们构建了一套涵盖大规模数据采集、标注、过滤、合成增强与类别平衡的数据处理流程,为模型的训练提供了高质量的数据支撑。

通过采用课程学习策略,Qwen-Image从基础的文本渲染任务起步,逐步过渡到段落级和布局敏感型描述的生成,显著提升了模型对多样化语言的理解与生成能力。同时,他们还引入了强化学习进一步优化生成偏好,使得Qwen-Image的输出更加符合人类的审美标准。

可以预见的是,随着Qwen-Image的开源和广泛应用,图像生成技术将在更多领域发挥其独特的价值。无论是海报制作、PPT生成还是精准图像编辑等领域,Qwen-Image都将为用户带来更加便捷、高效和智能的体验。