在2025人工智能计算大会上,浪潮信息推出的元脑SD200与HC1000两款AI服务器成为焦点。这两款产品通过底层架构创新,在DeepSeek R1大模型运行中实现了8.9毫秒的Token生成速度,并将推理成本压缩至每百万Token仅1元,为智能体产业化提供了关键技术支撑。

8.9毫秒的响应速度意味着什么?人类眨眼需要100-400毫秒,而AI生成每个Token的时间比眨眼快数十倍。这种突破使AI交互从"延迟对话"迈向"实时响应",用户提问与系统反馈几乎同步完成。传统AI服务中常见的"逐字输出"现象,在此技术支撑下彻底成为历史。

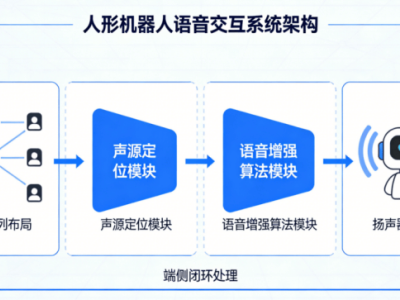

支撑这一速度的核心是"多主机3D Mesh"系统架构。该架构通过在单个机箱内集成64颗国产AI芯片,构建了高效的数据传输网络。其专用互连协议采用三层精简设计,原生支持内存语义,将通信延迟压缩至百纳秒级。配合自研的Smart Fabric Manager技术,系统可动态规划最优通信路径,实现0.69微秒的行业最低延迟。

这项技术突破的影响远超聊天机器人领域。在金融高频交易中,毫秒级延迟可能决定交易成败;自动驾驶场景下,数据响应速度直接影响行车安全;工业自动化领域,通信效率直接关乎生产效率。智能体时代的竞争本质是速度竞争,技术落后者将面临淘汰风险。

成本方面的突破同样具有颠覆性。HC1000服务器通过"全对称DirectCom极速架构",将推理成本降至1元/百万Token。这一价格使AI服务从"企业专属"变为"普惠资源",中小企业和个人开发者均可负担大规模AI应用。传统架构中计算与通信分离导致的效率损失,在此被"边算边传"的流水线模式彻底解决。

该架构的创新点在于计算单元与通信通道的1:1直连设计,实现全局无阻塞通信。支持从1024卡扩展至52万卡的超大规模部署能力,使单卡成本降低60%以上。这种设计让AI推理成本接近人力成本,未来企业可能以"实习生团队"的预算,获得7×24小时工作的AI智能体服务。

浪潮的技术突破标志着AI竞争焦点转移。过去行业聚焦模型参数规模,如今转向速度与成本的底层优化。再强大的模型,若缺乏高效计算架构支撑,终将沦为实验室展示品。这如同制造超级跑车却无配套高速公路,性能优势无法转化为实际价值。

中国AI产业正从应用创新向基础设施创新深化。当速度与成本不再是障碍,智能体技术才能真正扎根现实场景。这场由浪潮引发的技术变革,或将催生改变世界的超级应用,其影响可能远超当前预期。