苹果公司近日推出了一款名为STARFlow-V的新型视频生成模型,该模型在技术路径上与当前主流的扩散模型截然不同,转而采用“归一化流”技术,旨在提升长视频生成的稳定性和减少错误累积。这一创新技术直接学习随机噪声与复杂视频数据之间的数学变换,为视频生成领域带来了新的可能性。

传统扩散模型通过多步迭代去噪生成视频,而STARFlow-V的“归一化流”技术则实现了训练过程的单次完成,无需多次小迭代,显著提高了训练效率。在生成速度方面,该模型训练完成后可直接输出视频,无需迭代计算,生成速度大幅提升。由于减少了逐步生成过程中的错误累积,STARFlow-V在生成质量上也表现出色。

苹果公司表示,STARFlow-V是首个在视觉质量和生成速度上能与扩散模型相媲美的技术。通过并行处理和重用先前帧数据,该模型生成五秒视频的速度较初始版本提升了约15倍。这一优势使其在处理长视频时更具竞争力。

针对长视频生成中常见的误差累积问题,STARFlow-V采用了双架构设计。一个组件负责管理跨帧的时间序列,确保运动一致性;另一个组件则优化单个帧内的细节,提升画面质量。这种设计使STARFlow-V在长达30秒的演示片段中保持了稳定性,而竞争对手如NOVA和Self-Forcing在几秒后便出现模糊或色彩失真。

STARFlow-V的多功能性也是其一大亮点。该模型无需修改即可处理多种任务,包括文本转视频、图像转视频(将输入图像作为起始帧)以及视频编辑(允许用户添加或删除对象)。这种灵活性使其在不同应用场景中具有广泛潜力。

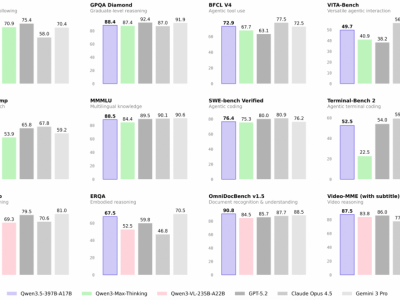

在性能表现方面,STARFlow-V在VBench基准测试中获得了79.7分。虽然落后于Veo3(85.06)和HunyuanVideo(83.24)等顶尖扩散模型,但它明显优于其他自回归模型,尤其在空间关系和人体表征方面表现突出。然而,该模型仍存在一些局限,例如分辨率相对较低(640×480,16帧/秒),且目前无法在标准显卡上实时使用。

更值得关注的是,STARFlow-V在物理模拟方面存在明显缺陷。例如,在演示中出现了“章鱼穿过玻璃”和“石头凭空出现”等不符合物理规律的现象。苹果公司承认这些限制,并表示未来将专注于加快计算速度、缩小模型规模,以及使用更注重物理精确性的训练数据。

目前,STARFlow-V的相关代码已在GitHub上公开,模型权重也将随后在Hugging Face上发布。这一举措为研究人员和开发者提供了进一步探索和改进该模型的机会。