随着人工智能大模型在各行业的广泛应用,这位“数字助手”正深度融入人们的日常生活。然而,其快速普及也带来了新的安全隐患。国家安全部门近期披露的案例显示,部分单位因不当使用开源AI工具,导致内部网络遭受攻击,敏感数据面临泄露风险。

某单位工作人员在处理内部文件时,违规使用开源AI工具,且未关闭电脑系统的公网访问权限、未设置密码保护。这一疏忽导致境外IP地址非法访问并下载了存储在系统中的敏感资料,引发严重数据安全事件。类似案例中,攻击者通过开源框架建立的联网大模型,未经授权即可自由访问目标网络,暴露出技术使用中的潜在风险。

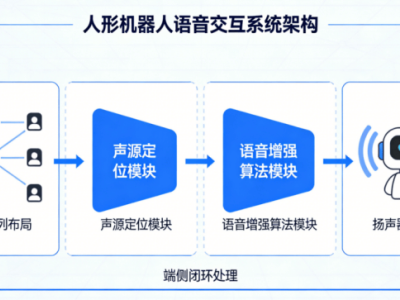

开源大模型指将模型架构、参数及训练数据向公众免费开放的人工智能系统。这类模型在互联网上广泛存在,功能涵盖推理、代码编写、文本处理及影像分析等领域。例如,用户上传体检报告后,模型可分析身体异常并提供调整建议。然而,其开放特性也埋下了安全隐患。

专家指出,数据安全是开源大模型最易被忽视的风险点。根据技术原理,AI工具需存储用户输入的数据以完成分析任务。若企业或个人将机密信息上传至开源平台,这些数据实际上已处于泄露边缘。开发者因权限设置可查看用户数据,而黑客则可能利用模型漏洞入侵后台,进一步加剧风险。

针对上述问题,安全专家建议普通网民避免向开源AI工具上传个人隐私或敏感信息;企业若需使用此类模型训练数据,应采用私有化部署方案,将所有数据存储于本地服务器,并配备专业团队维护。尽管私有化部署需投入更多基础设施成本,但可有效阻断数据外流途径。