AI算力领域正经历一场从训练向推理的深度转型,英伟达与OpenAI的最新布局成为这一趋势的核心注脚。据行业消息,英伟达计划在下月GTC开发者大会上推出融合Groq语言处理单元(LPU)技术的新一代推理芯片,该产品被其CEO黄仁勋称为"颠覆性系统"。OpenAI已确认成为首批大客户,将采购大规模专用推理算力,同时与初创企业Cerebras达成数十亿美元合作,后者宣称其推理芯片速度已超越传统GPU架构。

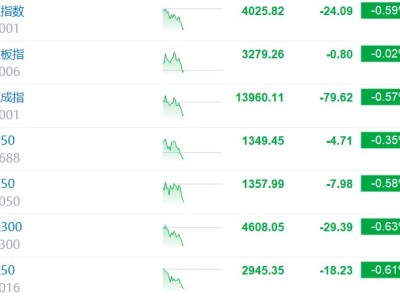

申万宏源研究报告指出,推理算力正呈现四大变革方向:专用架构崛起挑战GPU主导地位,纯CPU部署场景显著增加,国产芯片突破加速供应链多元化,以及算力需求从单次训练转向海量Token消耗。数据显示,春节期间国内头部模型推理量激增,豆包除夕当日处理633亿tokens,千问春节活动参与人数超1.2亿。全球模型调用平台OpenRouter数据显示,2月第三周中国模型调用量达4.12万亿tokens,首次超越美国的2.94万亿,次周更攀升至5.16万亿,三周涨幅达127%,全球前五模型中中国占据四席。

技术架构层面,LPU与GPU的分野愈发清晰。英伟达通过200亿美元技术许可交易获取Groq核心专利,并吸纳其创始人团队,标志着纯推理芯片获得顶级厂商认可。LPU针对推理场景的两大瓶颈——延迟和内存带宽进行优化,其架构设计在解码阶段效率显著高于传统GPU。据透露,英伟达新品可能采用下一代Feynman架构,通过3D堆叠技术深度整合LPU与SRAM,形成训练端GPU-HBM、推理端ASIC-LPU-SRAM的明确分工格局。

系统级革新同样成为焦点。随着AI应用从聊天机器人向智能体(Agent)演进,算力系统需同时满足低延迟、高吞吐与深度思考需求。申万宏源研究提出三层网络架构模型:快反应层采用SRAM加速芯片实现毫秒级响应,慢思考层依赖多核CPU集群处理复杂逻辑,记忆层则通过SSD存储长期数据。英伟达已调整硬件策略,本月宣布与meta完成首次大规模纯CPU部署,支持其广告定向智能体,打破以往GPU捆绑销售模式。

国产算力突破成为另一重要变量。新一代国产推理芯片实现多项技术跃升:支持FP8/MXFP4等低精度格式,算力达1-2P;向量计算能力通过SIMD/SIMT双模型设计大幅提升;互联带宽增至2TB/s。特别值得关注的是PD分离技术,通过自研两种规格HBM分别适配预填充(Prefill)与解码(Decode)场景,其中PR版本采用低成本方案,可降低推理阶段投资成本30%以上,预计2026年一季度量产。供应链数据印证了这一趋势,某头部封测企业2.5D封装收入从2022年0.5亿元暴增至2024年18.2亿元,显示国产算力芯片产能持续扩张。

这场算力革命的驱动力来自两大结构性变化:大模型商业化进程加速,Claude等模型密集发布行业插件;智能体技术落地提速,openclaw、千问Agent等产品进入真实生产场景。每次模型调用与任务执行背后,均需庞大推理算力支撑。申万宏源研究强调,性价比将成为核心竞争要素,能够提供充足、低成本推理芯片的厂商将主导新一轮产业格局重塑。