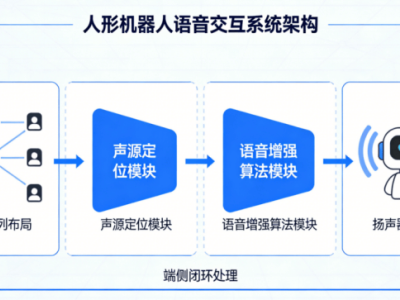

当下,AI发展重心正从“大模型”向“智能体”转变。大模型时代,交互模式相对简单,用户输入提示词,模型经过思考给出答案。而智能体时代,交互变得复杂多样,不仅有人机交互,还有机机交互。模型不仅要理解用户话语,还需自主调用浏览器、代码解释器等工具与外部环境互动,交互次数从几次激增至几十次甚至上百次。在此过程中,智能体每次调用工具产生的输入输出虽短,可能仅几百个token,但随着交互轮次增加,上下文会不断累积,最终形成几十万token的庞大数据。

这种多轮次、长上下文、短追加的智能体任务模式,带来了新的问题。对于Transformer架构的模型而言,在处理新任务时,大部分所需上下文已在之前交互中计算过,可直接读取缓存,即KV-Cache。KV-Cache命中率常高达95%以上,其作用如同人追剧时记住前面剧情,无需重复观看就能理解新剧情。然而,强大的GPU处理几百个token的新交互可能不到1毫秒,但获取几十万token的KV-Cache数据却需较长时间,就像大厨炒菜只需1秒,助手买菜却要10秒。这使得智能体推理的最大瓶颈从算力转变为KV-Cache数据的输入输出速度。

为提升推理性能,业内普遍采用“预填充-解码分离”(PD分离)架构。该架构将GPU集群分为预填充引擎和解码引擎两部分。预填充引擎负责处理海量输入文本,是计算密集型任务,擅长批量处理;解码引擎负责逐字生成回答,对延迟敏感,但受内存限制。在这种架构下,预填充引擎需不断从外部存储加载海量KV-Cache数据,其存储网卡常处于过饱和状态,而解码引擎的存储网卡大部分时间却闲置,导致高性能芯片集群硬件资源闲置,造成极大浪费。