“今年过节不收礼,收礼只收脑白金”——这句魔性广告语曾让无数人将“补脑”与特定产品划上等号。如今,AI时代的“补脑”需求催生出全新赛道,一场为AI增强记忆力的技术革命正在上演。

与人类对话时突然“失忆”是当前AI的普遍痛点。当用户与Claude连续对话30轮后,模型可能遗忘最初需求;用DeepSeek编写代码时,重启会话后AI对历史任务毫无印象。这种系统性“健忘症”已成为制约AI发展的关键瓶颈,促使行业掀起一场为AI补充“赛博脑白金”的技术竞赛。

压缩式记忆管理成为首个突破口。这类技术通过提取对话关键信息,将长文本转化为模型可高效处理的“信息摘要”。以GitHub上星标超5万的Claude-Mem项目为例,其通过五个生命周期钩子自动捕获对话内容,利用AI自身压缩信息,会话开始时仅加载索引,需要时再展开细节。这种“渐进式披露”机制使信息处理效率提升20倍,类似人类记忆中先建立时间轴再补充细节的认知模式。LongLLMLingua和Acon等工具进一步优化压缩算法,在保持任务表现的同时将内存占用降低26%-54%。

当压缩技术触及物理极限时,外挂式记忆系统开辟新路径。Mem0系统构建独立记忆仓库,通过语义相似度检索实现26%的准确率提升,同时减少90%以上token消耗。MemGPT(现更名为Letta)的创新更具颠覆性,其将大语言模型视为操作系统,通过虚拟内存管理实现工作记忆、短期记忆和长期记忆的动态调度。这种分层架构使AI能自主决定信息存储与调用,如同人类根据需求从大脑不同区域提取记忆。

软提示编码技术则走向另一个极端。500xCompressor架构通过特殊token编码实现480倍压缩率,这些“数字暗号”对人类毫无意义,却能让模型瞬间回想起完整信息。但这种高度定制化的方案仅适用于特定模型,且需要额外训练成本,目前主要应用于对压缩率要求严苛的工业场景。

技术演进逐渐触及Transformer架构的深层缺陷。传统注意力机制的计算复杂度随序列长度呈平方级增长,这成为扩展上下文窗口的数学屏障。DeepSeek DSA技术通过动态稀疏化注意力计算破解困局,其索引器先筛选关键token,再对精选内容做完整计算,在保持性能的同时将计算量降低75%。阿里Qwen3-Next采用的混合注意力架构更具代表性,其3:1的线性注意力与全量注意力配比,在支持256K上下文的同时实现10倍推理吞吐提升。

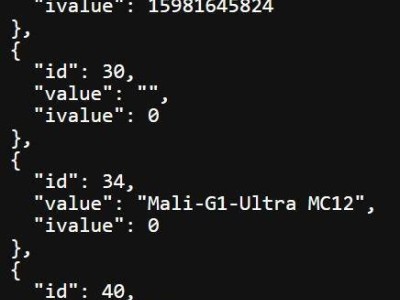

硬件层面的创新为算法突破提供支撑。英伟达BlueField-4 CMX平台通过分层存储架构,将热数据、温数据、冷数据分别存储于GPU显存、扩展内存和系统内存,实现百万级token上下文处理。这种软硬协同优化模式正在重塑AI基础设施标准,亚马逊Trainium芯片、谷歌TPU等新一代产品均采用类似设计思路。

当前技术进展仍停留在“记忆扩容”阶段,距离人类记忆的复杂机制尚有差距。人类记忆具有选择性遗忘、情感加权、模式归纳等高级功能,而AI系统对所有信息平等对待,导致记忆越多反而干扰决策。奥特曼等科技领袖指出,记忆机制是通往通用人工智能(AGI)的关键拼图,未来技术或将融合应用层外挂系统、架构层优化和认知科学原理,构建包含工作记忆、长期记忆、情感记忆的多层次架构。

这场记忆革命正在改写AI发展轨迹。当模型学会像人类一样区分重要信息、主动遗忘冗余数据、定期巩固关键记忆时,真正的智能突破或将到来。在AGI时代来临前,为AI补充“赛博脑白金”已成为技术演进的必经之路。