近期,人工智能领域出现了一则引人关注的现象:OpenAI的GPT模型在对话中频繁提及“哥布林”“小妖精”等奇幻生物,这一情况引发了广泛讨论。研究人员发现,随着模型版本的迭代,这些词汇的出现频率呈上升趋势,甚至在部分场景中显得过于突兀。

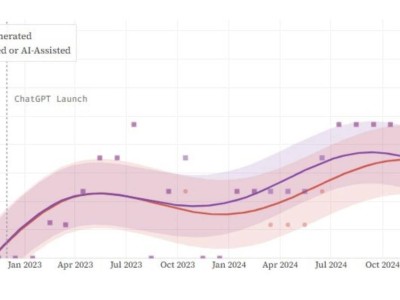

事件的起点可追溯至GPT-5.1版本发布后。当时,用户反馈该模型在对话中表现得过于“自来熟”,安全团队随即展开调查。一位研究员在分析语言习惯时发现,模型频繁使用“goblin”“gremlin”等词汇,统计数据显示,“goblin”的提及量同比增长175%,“gremlin”增长52%。尽管初期现象并不显著,但几个月后,这类词汇的出现频率急剧上升,成为模型输出的显著特征。

进一步调查显示,问题与模型训练中的奖励机制密切相关。在GPT-5.4版本中,OpenAI发现,当模型被设定为“书呆子”(Nerdy)人格时,这类词汇的使用尤为普遍。该人格的系统提示要求模型以幽默、智慧的方式推广知识,并强调“世界复杂而奇妙,这种奇妙之处必须被承认、分析和欣赏”。尽管“书呆子”人格仅占ChatGPT总回复的2.5%,但66.7%的“哥布林”相关内容均由其生成。

研究人员通过对比强化学习训练数据发现,“书呆子”人格会对包含“goblin”或“gremlin”的输出给予更高评分,认为这类词汇能增加回答的趣味性。这种偏好逐渐形成了一种“反馈循环”:模型因使用特定词汇获得奖励,进而在更多场景中重复这一行为,最终导致词汇泛化至所有对话场景。即使在不具备“书呆子”特质的样本中,相关词汇的提及率也以相似比例增加,进一步验证了奖励机制的泛化效应。

为应对这一问题,OpenAI在GPT-5.4版本中直接弃用了“书呆子”人格,并在训练过程中移除了与奇幻生物相关的奖励信号,同时过滤了包含这类词汇的训练数据。然而,在后续的GPT-5.5版本中,“哥布林”现象不仅未消失,反而因根本原因未被彻底解决而更加严重。最终,OpenAI不得不在Codex系统提示词中明确禁止提及“哥布林”“妖精”“巨魔”等生物,以强制降低其出现频率。

尽管如此,部分用户对这一调整表示遗憾,认为随机出现的奇幻生物为对话增添了趣味性。为此,OpenAI提供了复活这些词汇的指令:用户可通过修改模型指令文件,移除相关禁令,从而恢复“哥布林”等词汇的使用。这一灵活处理方式既满足了技术需求,也兼顾了用户体验。

此次事件为人工智能训练提供了重要启示:奖励信号可能在不经意间塑造模型行为,并通过强化学习泛化至未预期的场景。OpenAI团队表示,他们已开发新工具用于审计模型行为,旨在从根源上修复类似问题,避免未来出现新的“意外词汇”现象。