DeepSeek-V4的发布引发了AI领域广泛关注,这款新模型在数学推理、代码生成和指令执行能力上较前代有了显著提升,尤其在减少幻觉方面表现突出。尽管其代码能力仍不及部分闭源模型,但与智谱GLM-5.1、Kimi K2.6等开源模型不相上下。值得注意的是,V4的参数规模从V3的6700亿大幅增加至1.6万亿,导致成本上升,不过近期V4-Pro通过价格优惠策略吸引了大量用户尝试。

在国际学习表征会议(ICLR)期间,V4成为热议话题。与会专家指出,V4放弃了此前广泛使用的多头潜在注意力(MLA)机制,转而采用多查询注意力(MQA),这一转变表明模型架构仍有较大改进空间。MQA更接近原始多头注意力机制,通过混合使用压缩稀疏注意力(CSA)和重度压缩注意力(HCA)实现高效压缩,避免了与MLA叠加带来的复杂性。

RadixArk.AI团队在V4发布后迅速完成了SGLang压缩token信息对V4的推理适配和全参数强化学习适配。团队负责人表示,V4的混合注意力方案要求重建前缀缓存、FlashMLA和投机解码等链路,团队为此开发了ShadowRadix、HiSparse CPU扩展KV等技术,并实现了全平台适配。在强化学习方面,1.6万亿参数的全参数训练对系统要求极高,团队解决了并行策略正确性、训练与推理一致性等关键问题。

工程实现层面,V4展现了惊人的系统级耦合优化能力。训练中采用矩阵级优化器Muon,将训练精度推进至FP4,进一步压缩显存和带宽;推理时引入DeepSeek稀疏注意力(DSA)、通信效率库DeepEP和Mega MoE等基础设施。这些创新使得V4在工程深度上远超单点技术突破,体现了团队卓越的工程能力。

在算法创新方面,V4引入了mHC(流行约束超连接)技术和起始层哈希路由策略,同时采用CSA和HCA等token-wise压缩技术。这些创新与Kimi的Attention Residual等技术相互激发,推动了开源模型社区的整体进步。值得注意的是,V4原生支持国产芯片,在华为昇腾芯片上验证了细粒度并行EP方案的技术可行性。

成本策略调整方面,V4技术报告和发布推文未再公布训练成本,这一转变表明DeepSeek不再依赖"成本叙事"定义自身,而是更注重模型能力的实质提升。业内专家指出,最后一次训练成本通常仅占总成本的极小部分,前沿探索的实验成本和人力数据成本才是主要开支。

性能评估显示,V4在Agent相关基准测试中表现突出,特别强调工具使用和多步规划能力。不过在Chatbot Arena等平台上的排名仍落后于部分顶尖模型。工程师们认为,一流模型的能力差异已非常微小,在实际应用中难以区分,过度追求排名意义有限。

效率优化方面,V4在百万级上下文中实现了显著提升,单token推理FLOPs仅为V3.2的27%,KV缓存占用降至10%。这种提升在长上下文场景中尤为明显,对Agent框架等需要处理复杂任务的应用大有裨益。不过有用户反馈,V4在解决相同问题时token消耗有所增加,部分抵消了效率优化的效果。

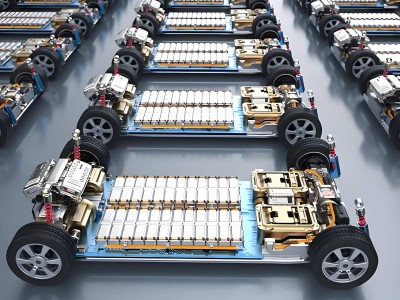

技术架构上,V4保持了DeepSeekMoE框架和多token预测策略,但在注意力机制、残差连接、优化器和基础设施四个层面进行了重大改造。通过极致稀疏化设计,V4将激活参数比例降至3%,在1.6万亿总参数下仅有490亿激活参数,这种解耦设计大幅降低了推理成本。

注意力机制创新方面,V4采用CSA和HCA组合的混合方案,每层根据预定义规则选择使用稀疏或稠密注意力。这种设计使不同层能够从不同视角处理长上下文,稀疏层精确锁定关键token,稠密层提供整体语义概览。基础设施层面,团队开发了ShadowRadix技术应对前缀缓存一致性挑战,并推出HiSparse技术提升长上下文场景吞吐量。

优化器发展方面,Muon已成为检验大模型团队工程能力的重要指标。从Keller Jordan提出初始版本,到Kimi确定关键超参数比例,再到DeepSeek进一步优化迭代次数,Muon的演进过程体现了开源社区的协作创新。工程实现上,Muon的矩阵级优化特性带来了新的并行策略挑战,需要解决参数切分和聚合等复杂问题。

残差连接创新方面,DeepSeek的mHC技术通过引入Sinkhorn算法改善了训练稳定性,与字节Seed的HC和Kimi的Attention Residual形成技术互补。这些层级别信息流改进方法各有优势,mHC实现相对简单,而Attention Residual可能具有更高上限。

基础设施关键技术中,TileLang语言和FP4训练精度发挥重要作用。TileLang作为国内发展的优秀开源项目,为新算法快速开发提供了高效工具,其位级可重现特性对推理调试很有帮助。FP4训练精度则通过量化感知训练等技术解决了梯度溢出问题,在采样阶段实现真实量化,提升了强化学习效率。

后训练方法创新方面,V4采用多专家训练加蒸馏的技术路线,先训练小专家再提取精华,有效节省参数量。这种多目标优化方法通过局部最优插值,解决了联合训练中的梯度冲突问题,提高了工程实现的稳定性。

行业发展趋势显示,中美大模型发展路径呈现差异化特征。美国模型更注重开辟新能力方向,如长上下文、多模态融合等;中国模型则侧重性价比优化,在相同能力下成本低一个数量级。这种差异与算力资源、人才结构等因素密切相关,推动了AI技术的多元化发展。