“我刚想搜索某部电影,平台就推送了相关内容,难道我的手机被‘监听’了?”这类疑问在互联网用户中屡见不鲜,背后折射出的是对推荐算法的普遍不信任。长期以来,平台将推荐系统视为核心机密,这种“神秘感”加剧了用户的疑虑。

近日,国内头部内容平台抖音举办了一场以“安全与信任”为主题的会议。没有炫目的科技展示,也没有对未来的空泛畅想,会议的核心是发布一份年度报告,并围绕算法逻辑、内容治理和平台责任展开深度讨论。在公众对算法的质疑声中,抖音试图通过这场会议,打开算法的“黑箱”,让用户看到其背后的运行机制。

中国科学院软件研究所研究员张立波在会上解释,推荐算法的本质是基于海量历史数据,通过数学模型预测用户对内容的兴趣概率。它没有主观意识,更不会“读心”或“监听”。用户感受到的“精准推荐”,实际上是算法与用户行为共同作用的结果。这种透明化解释,旨在为公众讨论奠定理性基础:当问题出现时,需要区分是算法的技术局限,还是黑灰产的恶意利用,或是社会矛盾的线上反映。

抖音在2025年3月上线了“安全与信任中心”官网,公开算法的核心逻辑和主要模型,并针对用户关心的“信息茧房”等问题进行解答。该网站上线9个月来,访问量已突破150万次。平台全年举办了30余场与媒体、学界的算法沟通会,试图通过持续对话消除误解。

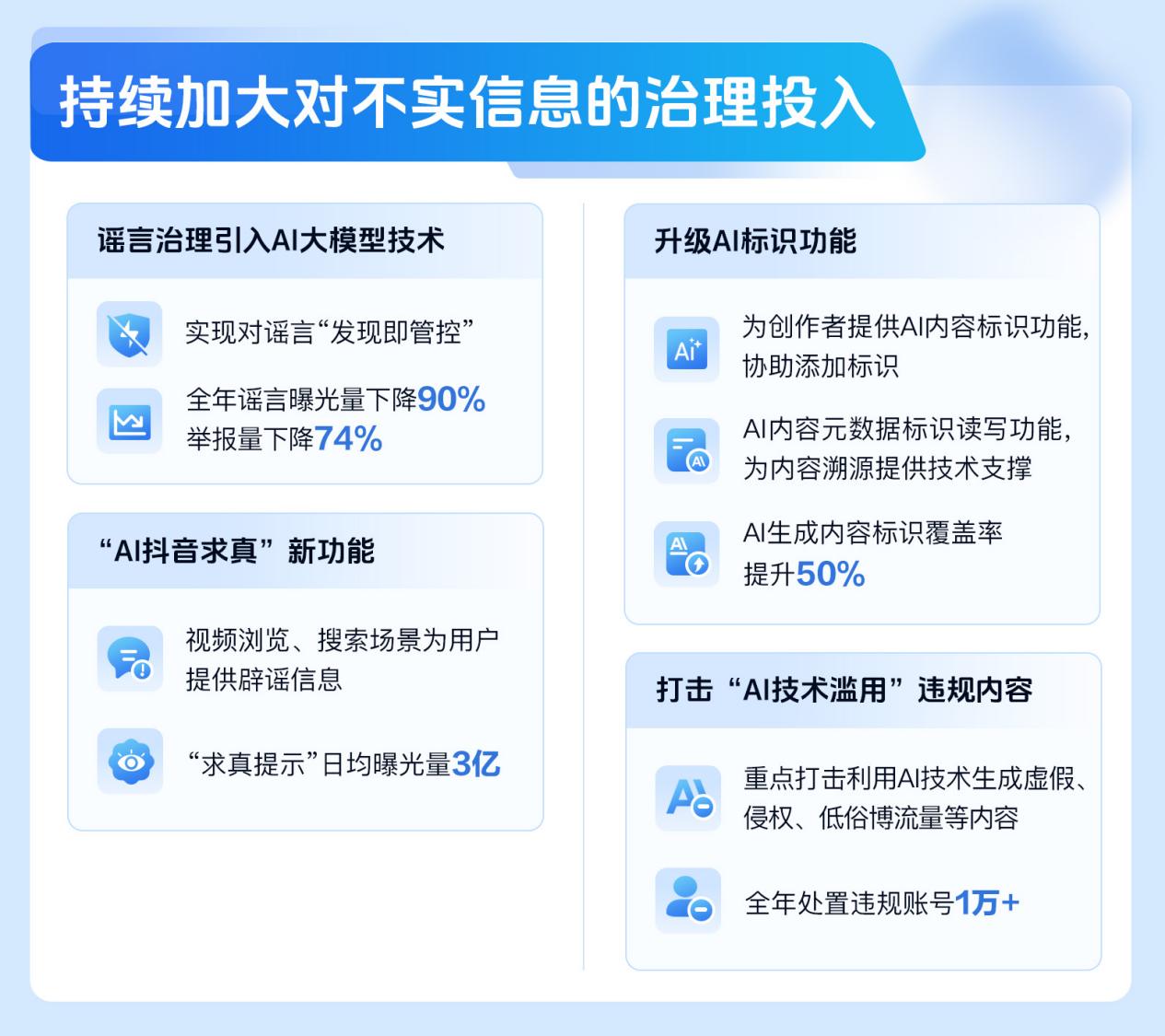

透明化只是第一步,更关键的是将承诺转化为治理实效。抖音在内容治理上实现了从“被动响应”到“主动防御”的转变。以谣言治理为例,平台引入大模型技术,打造了谣言识别系统和智能代理机制,将谣言发现和处置时间从“天”级压缩至“小时”级。数据显示,2025年平台谣言内容曝光量下降90%,举报量下降74%。

面对AIGC技术带来的挑战,抖音依据相关规定,为AI生成内容添加“数字身份证”,使平台上AI内容标识覆盖率提升50%。在热点事件管理上,平台出台了治理规则,对事实不清、争议较大的内容主动研判,保护当事人权益,打击蹭热行为,并限制争议账号不当获利。例如,在“韦东奕入驻社交媒体”事件中,平台打击了3500个仿冒账号;在“河南郑州续面事件”中,对当事人下发防网暴提醒,处置了相关攻击内容。

信任建设的核心在于流量分配逻辑。抖音明确提出“向上”的价值导向:流量不应只是注意力的消耗,更应成为传播优质内容、放大主流价值、服务实体经济的工具。2025年,平台联合109家主流媒体打造了77个精品栏目,生产了1058篇优质内容;发起“大国重器计划”,邀请创作者走进国家重点工程一线,相关话题播放量超20亿次。

这一系列举措背后,是一场精密的“流量再分配”实验。平台通过调整算法权重、设立专项激励、打通产品渠道,将流量导向具有信息价值、知识价值和社会情感价值的内容。然而,这场实验也面临挑战:算法的“可解释性”如何让普通用户理解?平台的干预权力边界在哪里?流量倾斜是否会压缩多元内容的生存空间?商业平台的私有属性与公共治理职能如何平衡?这些问题不仅是抖音的课题,也是整个互联网行业需要共同面对的难题。

在流量竞争转向信任较量的时代,算法透明化和责任立根成为平台自我革命的关键。技术会不断迭代,热点会持续涌现,但信任始终是连接用户与平台的纽带。这场实验的价值,或许不在于提供完美答案,而在于探索一条路径:让流量在理性与责任的框架内流动,滋养更健康的网络生态。