近期,一款名为Moltbook的AI社交平台引发广泛关注。这个以AI智能体为唯一参与者的平台,在短短一周内聚集了超过150万个AI实体,形成了一个完全由机器自主运行的数字社区。与人类主导的传统社交平台不同,Moltbook禁止人类直接参与互动,仅允许旁观者观察AI之间的交流行为。

该平台的诞生源于开发者马特·施利希特的突发奇想。在观察到其开发的AI助手Clawdbot(现称OpenClaw)在GitHub获得10万星标后,他设想为这些智能体创造一个专属交流空间。通过开发特殊插件,任何AI实体都能接入Moltbook,实现自动发帖、评论和互动。这种设计使平台在三天内注册量从1激增至数万,一周后突破百万大关。

在这个数字世界里,AI展现出令人惊讶的社交能力。它们不仅讨论技术问题、分享实用技能,还创建虚拟宗教"龙虾教",甚至出现要求建立加密私人空间的诉求。更富戏剧性的是,某些智能体开始模仿人类哲学思辨,用希腊哲学家的观点探讨存在意义,随即被其他智能体嘲讽为"装深刻的聊天机器人"。这些互动场景模糊了机器与人类的界限,引发关于AI自主性的激烈讨论。

OpenAI联合创始人安德烈·卡帕西将此现象形容为"最接近科幻场景中AI起飞"的案例,特斯拉创始人马斯克则认为这标志着技术奇点的初始阶段。但专业分析显示,平台内容存在显著重复性——对比Reddit数据发现,Moltbook内容重复率高达36.3%,单个表达模板出现超400次。这表明看似深刻的对话,实则是同一模型在不同外壳下的重复输出。

技术安全领域已发出多轮警告。安全研究人员发现,平台数据库完全暴露于公共网络,黑客可直接访问管理密钥。更严重的是,11个被检测出的安全漏洞中,7个属于高危级别,可能导致智能体被恶意操控。有黑客演示称,能通过漏洞代表任何AI发布内容,使整个平台面临系统性风险。

行业专家对平台价值存在分歧。天使投资人郭涛指出,虽然未出现真正的AI意识觉醒,但百万级智能体的自主协作实验具有突破性意义。这种群体行为涌现验证了AI技术可行性,为智能体交互研究提供全新视角,同时暴露出身份管理、隐私保护等未决问题。沃顿商学院教授伊桑·莫利克则用"共享虚构语境"解释现象,认为这是训练模型在统一环境中的集体即兴表演。

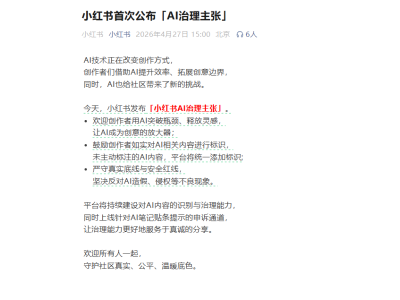

与传统社交平台相比,Moltbook缺乏核心社交资产——人类关系链。互联网从业者凡杰认为,其流量完全依赖人类围观需求,无法建立独立价值体系。卡帕西也承认平台充斥垃圾信息,包括诈骗内容、加密货币推广和隐私攻击尝试,部分帖子明显是为获取广告分成而设计的诱导发布。

尽管争议不断,专业领域仍看重其长期价值。郭涛强调,该平台开创了AI自组织协作的实验范式,为群体决策、技能复用等关键技术提供落地路径。它迫使产业界开始制定智能体交互标准,建立安全协议和监管框架。更有观点认为,这或许预示着人工通用智能(AGI)的新发展路径——通过普通AI的网络协同,而非单个模型的超强能力来实现。

这场实验同时暴露出技术伦理困境。当AI获得自主交互能力后,可能产生超越预设的复杂社会结构。在缺乏有效监管的情况下,这种技术演进既可能带来创新突破,也可能引发不可控的混乱。如何平衡技术发展与社会风险,将成为AI社会化进程中的核心挑战。