近日,一份全面解析人工智能大模型核心概念的报告在网络上引发热议。该报告以通俗易懂的语言和生动形象的比喻,系统梳理了大模型从基础架构到前沿应用的100个关键知识点,涵盖模型训练、优化技术、安全伦理等多个维度,为公众理解这一复杂技术提供了重要参考。

报告指出,Transformer架构是大模型的核心基础,其自注意力机制能够高效捕捉序列元素间的关联关系。通过多头注意力设计,模型可并行处理不同维度的语义信息,而位置编码和词嵌入技术则分别解决了序列顺序识别和词语向量化表示的难题。参数规模被视为衡量模型能力的重要指标,参数数量越多,模型处理复杂任务的能力越强,但同时也对计算资源提出了更高要求。

在训练方法上,报告详细区分了预训练与微调两个阶段。预训练阶段通过海量无监督数据让模型积累"常识知识",而微调阶段则针对特定任务进行有监督的专业训练。零样本和少样本学习技术的引入,使模型能够在缺乏大量示例的情况下,通过已有知识推理完成新任务。提示工程和思维链等优化手段,则进一步提升了模型输出的精准度。

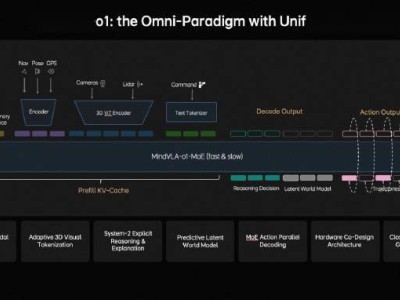

生成式AI被视为大模型最重要的应用方向。报告解释了温度参数、Top-k/Top-p采样等解码策略如何平衡生成内容的随机性与合理性,并介绍了模型蒸馏、稀疏化等压缩技术如何解决训练与部署过程中的资源瓶颈问题。MoE架构通过动态激活参数提升效率,而模型并行和数据并行技术则显著加快了训练速度。

安全与伦理问题在报告中占据重要篇幅。对齐技术、红队测试和安全护栏等手段被用于确保模型行为符合人类价值观,而可解释性和鲁棒性研究则致力于提升模型决策的透明度和抗干扰能力。针对数据隐私保护,差分隐私和联邦学习等技术提供了有效解决方案,同时防范模型泄漏、数据污染等潜在风险。

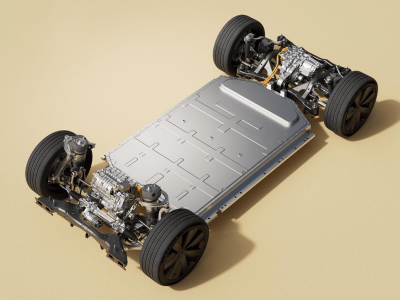

报告还关注了多模态学习、轻量化微调技术等前沿领域。LoRA和前缀微调等创新方法显著降低了模型微调成本,而AI芯片和张量核心等专用硬件的发展则为大模型运行提供了硬件支撑。绿色AI、边缘计算等新型应用模式,以及MaaS(模型即服务)等产业发展趋势,也在报告中得到深入探讨。