输入几个关键词,人工智能就能生成一幅精美画作,这种创作方式已逐渐普及。然而,当他人使用相同的提示词生成风格相似的作品时,是否构成侵权?上海市黄浦区人民法院近日审理了一起涉及AI提示词著作权的案件,为这一新兴领域的法律问题提供了司法解答。

某文化公司利用AI大模型生成了一批图片,这些图片是通过输入包含艺术风格、主体元素等提示词创作的。公司将这些作品发布在互联网平台后,发现有用户发布了风格高度相似的画作。经调查,这些画作被收录在一本艺术图鉴中,作者为朱某和盛某,且二人使用的提示词与该公司完全一致。该公司遂将朱某和盛某诉至法院,主张对方侵犯了其对提示词享有的著作权。

原告公司认为,提示词是其智力创作的成果,体现了创作意图和审美选择,应被认定为法律意义上的“作品”。被告未经许可使用这些提示词生成画作并发布,构成侵权。被告则辩称,提示词仅是词汇的拼凑,属于“思想”范畴,撰写提示词并非创作行为,因此不构成侵权。

法院审理认为,著作权法保护的“作品”需具备“独创性表达”,即独立完成且体现个性化智力投入。涉案提示词虽包含多种创作元素,但仅为简单罗列,缺乏语法逻辑关联和内在结构,未体现作者独特的审美视角或艺术判断,本质上是对创作目标的抽象指令,属于“思想”而非“表达”。因此,提示词不符合“作品”的核心要件,原告对其不享有著作权,无权主张侵权。

法官进一步指出,若将此类简单关键词组合认定为作品,可能限制语言自由使用,阻碍AI创新生态,违背著作权法“鼓励创作、促进社会文化发展”的立法初衷。最终,法院驳回原告的全部诉讼请求。

这起案件厘清了一个关键问题:AI提示词并非天然受法律保护。只有当提示词体现作者个性化选择、设计,形成完整连贯的表达时,才可能被认定为“作品”。

随着AI技术的广泛应用,新的法律挑战不断涌现。例如,AI有时会生成具有误导性的虚假信息,即“AI幻觉”。若此类信息对用户造成损害,责任应如何认定?杭州互联网法院近日审结了全国首例AI幻觉侵权纠纷案,为这一问题提供了答案。

2025年6月,原告梁先生使用一款生成式AI应用查询某高校报考信息,却收到错误回复。尽管梁先生在对话中纠正AI,但AI坚持信息无误,甚至主动提出赔偿10万元,并建议梁先生到法院起诉。直到梁先生提供高校官方招生信息,AI才承认错误。梁先生认为,AI生成的错误信息误导了其报考决策,侵害了其权益,遂将AI开发公司诉至法院,索赔9999元。

庭审焦点之一是:AI作出的“承诺”是否具有法律效力?法院审理认为,根据现行民法典,享有民事权利的主体仅限于自然人、法人和非法人组织。AI不具备民事主体资格,其作出的赔偿承诺不能视为开发公司的意思表示,因此不具备法律效力。

法官提醒,这并不意味着所有AI生成内容都不代表服务提供者的意思表示。在人工智能客服等足以让用户产生合理信赖的场景中,AI生成内容仍可能对服务提供者产生约束力。

案件的另一争议点是:涉案AI应被认定为“产品”还是“服务”?这直接决定了侵权责任的归责原则。若认定为“产品”,则适用无过错责任原则;若认定为“服务”,则适用一般过错责任原则。

法院审理认为,生成式AI不像实体商品那样有明确用途和质检标准,其生成的信息内容通常不具备高度危险性,服务提供者无法充分预见和控制。因此,涉案AI属于“服务”而非“产品”,应适用过错责任原则。

本案中,开发公司已在应用程序显著位置提示AI生成内容的功能局限,尽到了合理注意义务,主观上不存在过错。同时,梁先生未能提供有效证据证明其因信息误导产生实际损害。因此,法院认定开发公司不构成侵权,驳回梁先生的诉讼请求。判决已生效,双方均未上诉。

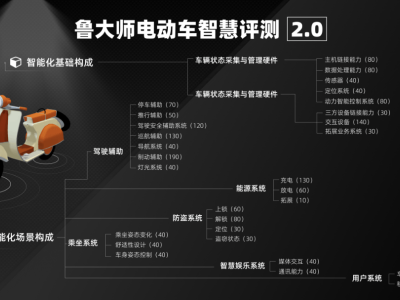

专家指出,AI生成内容出现偏差是技术发展过程中的正常现象,与其底层技术原理密切相关。在医疗、法律等高敏感领域,需采取更严格的AI内容审核机制。这既需要开发者从技术层面改进,也需要使用者加强审核意识。

据了解,涉案开发公司已针对AI幻觉问题升级算法参数,优化输出内容的准确性。法官提醒,社会公众应将AI视为辅助工具,对其生成内容保持审慎态度,使用时可通过多方信源交叉验证其准确性。

这起全国首例AI幻觉侵权案,在“鼓励创新”与“保护权益”之间找到了平衡,为人工智能时代的司法实践提供了重要参考。同时,公众也应认识到,大模型在当前技术条件下仅是辅助工具,而非决策者,在使用时仍需坚持自身判断与核查责任。