谷歌今日正式发布新一代开源大模型Gemma 4,凭借突破性的单位参数智能水平,成为该公司迄今为止最强大的开源模型。该系列模型专为复杂推理场景和智能体工作流设计,在性能与效率之间实现全新平衡,为开发者提供前沿AI能力与更低硬件成本的双重优势。

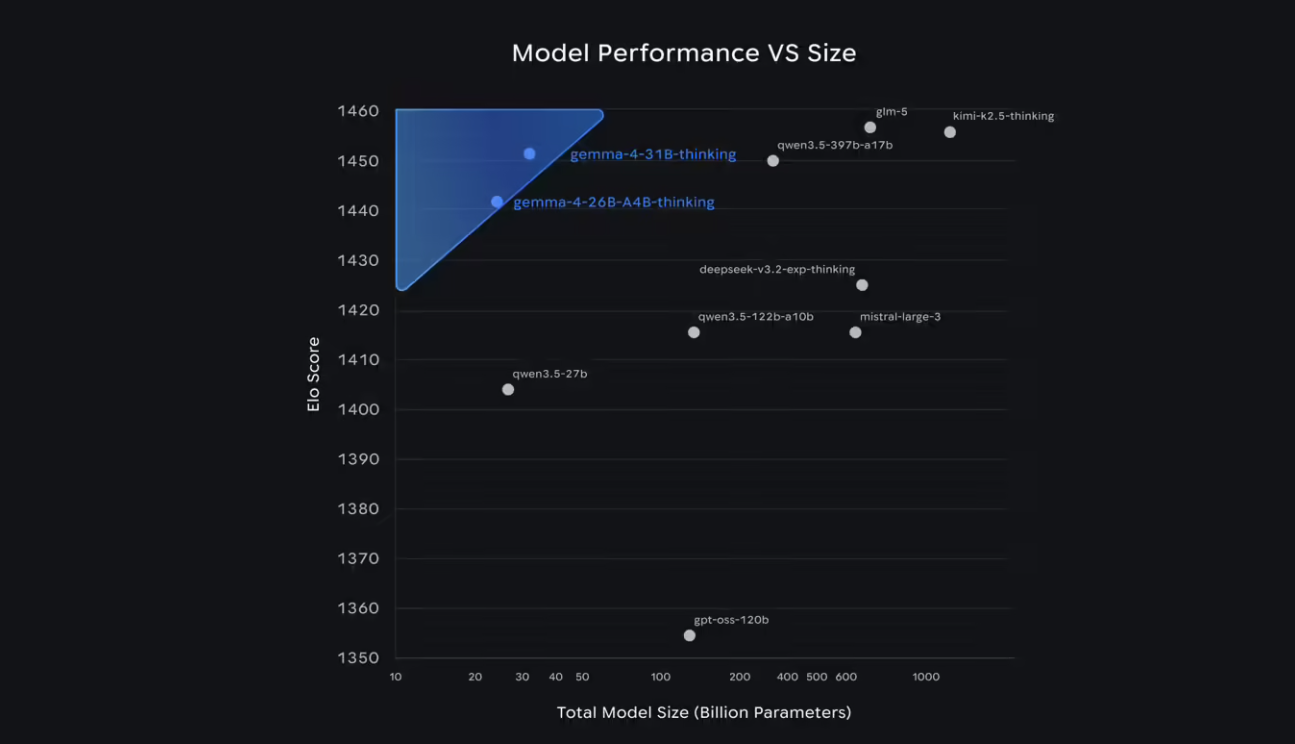

Gemma 4推出四种规格模型,涵盖从端侧设备到数据中心的全场景需求:20亿参数的E2B与40亿参数的E4B主打端侧部署,260亿参数的混合专家模型(MoE)和310亿参数的稠密模型(31B)则面向高性能计算场景。所有模型均突破传统对话应用边界,在数学推理、代码生成、多模态处理等复杂任务中展现卓越能力。其中31B模型在Arena AI文本生成基准测试中位列全球开源模型第三,26B模型排名第六,性能超越参数规模20倍的同类模型。

端侧模型通过架构创新重新定义本地部署价值。E2B与E4B采用内存优化设计,推理时仅激活对应参数量的计算单元,在保持20亿和40亿有效参数的同时,实现近零延迟响应。这两款模型已与高通、联发科等芯片厂商完成适配优化,可在智能手机、树莓派等设备上完全离线运行,支持语音识别、图像理解等10余种多模态任务。安卓开发者现可通过AICore预览版构建智能体流程,与谷歌此前发布的Gemini Nano 4保持向前兼容。

针对专业开发场景,26B混合专家模型采用动态参数激活技术,推理时仅调用38亿参数即可完成复杂任务,在保持低延迟的同时显著降低计算资源消耗。31B稠密模型则通过非量化bfloat16权重设计,可高效运行于单张80GB显存的英伟达H100 GPU,量化版本更支持消费级显卡部署,为编程助手、智能体开发等场景提供强大基础能力。

该系列模型的核心突破体现在多维度能力升级:在推理性能方面,数学基准测试得分较前代提升47%,支持多步逻辑规划与复杂指令执行;代码生成模块可离线生成高质量代码,将开发工作站转化为本地AI编程环境;视觉处理模块兼容可变分辨率输入,在OCR识别、图表解析等任务中准确率突破92%;上下文窗口扩展至256K tokens,可一次性处理完整代码库或长篇文档。

多语言支持成为另一大亮点。基于超过140种语言的原生训练数据,Gemma 4在低资源语言处理任务中表现优异,开发者可轻松构建全球化应用。谷歌特别优化了模型在非拉丁语系中的表现,阿拉伯语、印地语等语言的语义理解准确率较前代提升33%。