3D数字人行业已陷入发展怪圈:全行业的竞争维度,始终困在"视觉上够不够像人"的颜值内卷里。但行业集体忽略的是,再精致的建模、再逼真的渲染,都无法成为用户长期深度交互的核心理由。

真正卡住数字人产业发展天花板的,从来不是视觉层面的"不像人",而是其始终未能构建起与人类相似自然的表达能力和更流畅的动作。很多时候,数字人看似嘴在动、手在挥,肢体动作却与对话语义完全脱钩,面部表情和台词情绪彻底割裂,这种深入骨髓的机械感与违和感,直接斩断了人与数字人之间建立情感联结、实现深度交互的所有可能。

人类真实沟通中,超70%的信息与情绪都藏在非语言信号里,耸肩的无奈、挑眉的质疑,这些细节才是对话的灵魂。但这背后是行业面临的三个瓶颈:一是中文对话场景高质量数据荒,覆盖全身动作的高质量数据集近乎空白;二是复合语义下动作漂移,面对融合情绪的复杂表达,模型语义理解能力急剧退化;三是音画节奏错位,动作机械生硬,与语音重音、停顿完全脱节。

这三道枷锁,把数字人困在"预设脚本播放机器"的定位里,始终迈不开从"能说话"、"能动"到"懂交流"的关键一步。而SentiPulse(思维光谱)联合中国人民大学高瓴人工智能学院推出的SentiAvatar交互式3D数字人框架,正是为打破这些瓶颈而来。面向全球开源的3D动作生成完整解决方案,让数字人跳出预设动作桎梏,实现贴合语境与情绪的自然实时交互,真正告别"提线木偶"式交互。

国内首个交互式3D数字人框架,让3D数字人动作有"灵魂"

针对行业底层痛点,SentiAvatar打造了3D动作生成新范式。

在数据底座层,SuSuInterActs数据集围绕单一角色SUSU(22岁,温柔活泼,情感丰富)构建。包含2.1万段片段、37小时的多模态对话语料,涵盖同步语音、行为标注文本、全身动作与面部表情,填补中文高质量数据的空白。

为打破场景限制,让数字人交互摆脱"脚本化",团队在预训练阶段引入了自研的Motion Foundation Model动作基础模型,在200K+条异质动作序列(约676小时)上训练通用运动先验,让数字人的能力远超对话场景本身。

此外,SentiAvatar创新提出plan-then-infill双通道并行架构,在动作生成时,将身体动作与面部表情分开处理,先规划"做什么动作",再插入"如何逐帧执行",让整体动作生成效果更流畅。

具体而言,第一阶段,LLM语义规划器接收行为标签文本和稀疏音频Token,输出稀疏关键帧动作Token序列。为支持多轮流式连续生成,模型以前一句话的最后两个关键帧音频-动作Token对作为上下文前缀,从下一个关键帧位置续写,实现无缝跨句过渡;第二阶段,Body Infill Transformer在相邻关键帧之间填入中间3帧,以逐帧 HuBERT连续特征(768维,20FPS)作为条件信号。模型采用5帧滑动窗口,首尾帧已知,预测中间3帧(12个动作Token)。推理时使用迭代置信度解码策略(默认6步),逐步接受高置信度预测,避免一次性预测的质量退化。

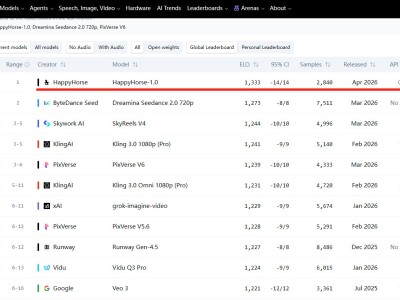

权威实验结果显示,SentiAvatar在SuSuInterActs和行业通用BEATv2两个数据集上,多项核心指标均达到当前国际最优水平(SOTA),性能全面领跑行业主流模型。

在自建的SuSuInterActs测试集上,SentiAvatar的文本-动作检索召回率R@1达到43.64%,几乎是行业次优基线的2倍;在跨数据集、跨语言的BEATv2评测集上,SentiAvatar以FGD 4.941、BC 8.078的成绩,同时刷新两项指标的SOTA纪录,超越此前行业最优方案,充分验证了模型的跨场景、跨语言泛化能力。

基于自研高质量数据集、动作基础模型与核心架构,SentiAvatar实现了在0.3秒内生成6秒动作序列,支持无限轮次的流式交互。这意味着数字人可以在实时对话中持续生成连贯的动作与表情,无需等待整句结束再批量处理,能直接解决数字人"交互卡顿"的问题。

构建认知-表达闭环,夯实数字人"交互底座"

SentiAvatar已正式上线GitHub开源平台,面向全球科研机构与开发者全面开放,相关技术报告也已同步发布于arXiv。开发者可基于这套开源框架,低成本打造专属的3D数字人,也可拓展其在游戏交互、影视制作、机器人等领域的应用。

当数字人不再是冰冷机械的交互工具,它能读懂你面部表情的隐喻并反馈同样稀缺的情绪价值,变成能感知语境、理解情绪、主动表达的交互主体,下一代"数字生命"即将诞生。