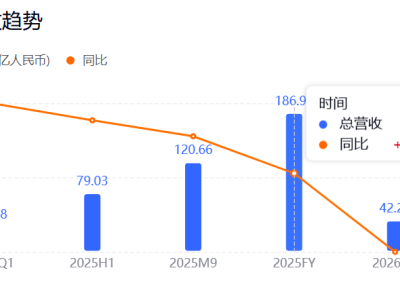

人工智能大模型领域迎来新一轮价格调整,DeepSeek-V4系列模型近日宣布大幅降价。此次调价涉及全系两款产品,其中输入缓存命中场景下的价格直接降至首发价的十分之一,引发行业广泛关注。

具体来看,DeepSeek-V4-Flash模型在输入缓存命中场景下的价格降至每百万tokens 0.02元,而性能更强的Pro版本则为0.025元。值得注意的是,Pro版本同时推出限时优惠活动:在缓存未命中场景下,输入价格从原价大幅下调75%至每百万tokens 3元,输出价格同步降至6元。该优惠将持续至5月5日23点59分,而Flash版本的其他价格保持不变,输入(缓存未命中)和输出价格分别为1元和2元。

价格对比显示,调整后的DeepSeek模型在市场上展现出显著优势。有微博用户通过实际使用场景测算,此次降价后成本可节省约73%,相当于"手机流量从5元1G降至5毛1G"。这种价格调整力度不仅让开发者群体感到惊喜,更被视为重塑行业经济格局的重要举措。部分开发者表示,现在正是评估将工作流程从Claude或GPT迁移至DeepSeek的最佳时机。

行业分析认为,DeepSeek此次降价策略背后是其技术实力的支撑。通过开源架构和长上下文处理能力的双重优势,该模型正在快速吸引开发者生态。有技术观察者指出,输入缓存价格的深度下调,叠加Pro版本的限时优惠,使得中小开发团队首次具备使用顶级模型构建商业应用的可能性。这种"技术普惠"策略或将改变现有市场竞争态势。

社交媒体上,用户对降价反应热烈。有人将这场价格战形容为"token缓存领域的核弹级事件",认为这将彻底改变生产级应用的经济模型。也有开发者肯定其战略意义,指出当顶级模型的使用成本降低到普通团队可承受范围时,将催生更多创新应用场景。目前,DeepSeek官方账号的推文评论区已出现大量关于迁移方案和技术细节的讨论。