随着ChatGPT在全球范围内掀起的人工智能(AI)浪潮,AI技术迅速融入各类电子设备中,成为产品的一大卖点。汽车、手机、家电乃至个人电脑(PC),都纷纷披上了AI的外衣,其中AI PC更是成为了市场的新宠。

AI技术以其提升办公效率、优化学习体验及增强生活便捷性的优势,天然适配PC等设备。因此,各大PC厂商纷纷推出搭载神经网络处理器(NPU)的AI PC,并在产品命名或宣传中显著标注“AI”字样,就连Apple的MacBook在电商平台上也被冠以“AI笔记本”的标签。

然而,尽管AI PC市场热度不减,但仍有不少消费者认为AI PC不过是厂商为了促进产品更新换代而打造的噱头,是“智商税”。对此,联想中国消费PC及平板事业部总经理李伟昌坦承,部分厂商确实以搭载NPU为卖点,但消费者购买后发现实际可用的AI功能有限,未能感受到效率上的显著提升。

那么,AI PC是否真的只是徒有其名?

事实上,目前市场上的AI PC产品大多仅具备本地异构AI算力这一特征,而联想所定义的AI PC,应包含内嵌个人大模型、个人知识库、本地异构AI算力、开放的AI应用生态以及个人隐私和数据安全保障五大要素。AI PC的核心在于能够部署和运行端侧AI大模型,这样既能保护用户隐私数据,又能根据用户习惯训练大模型,提供更加个性化的服务。

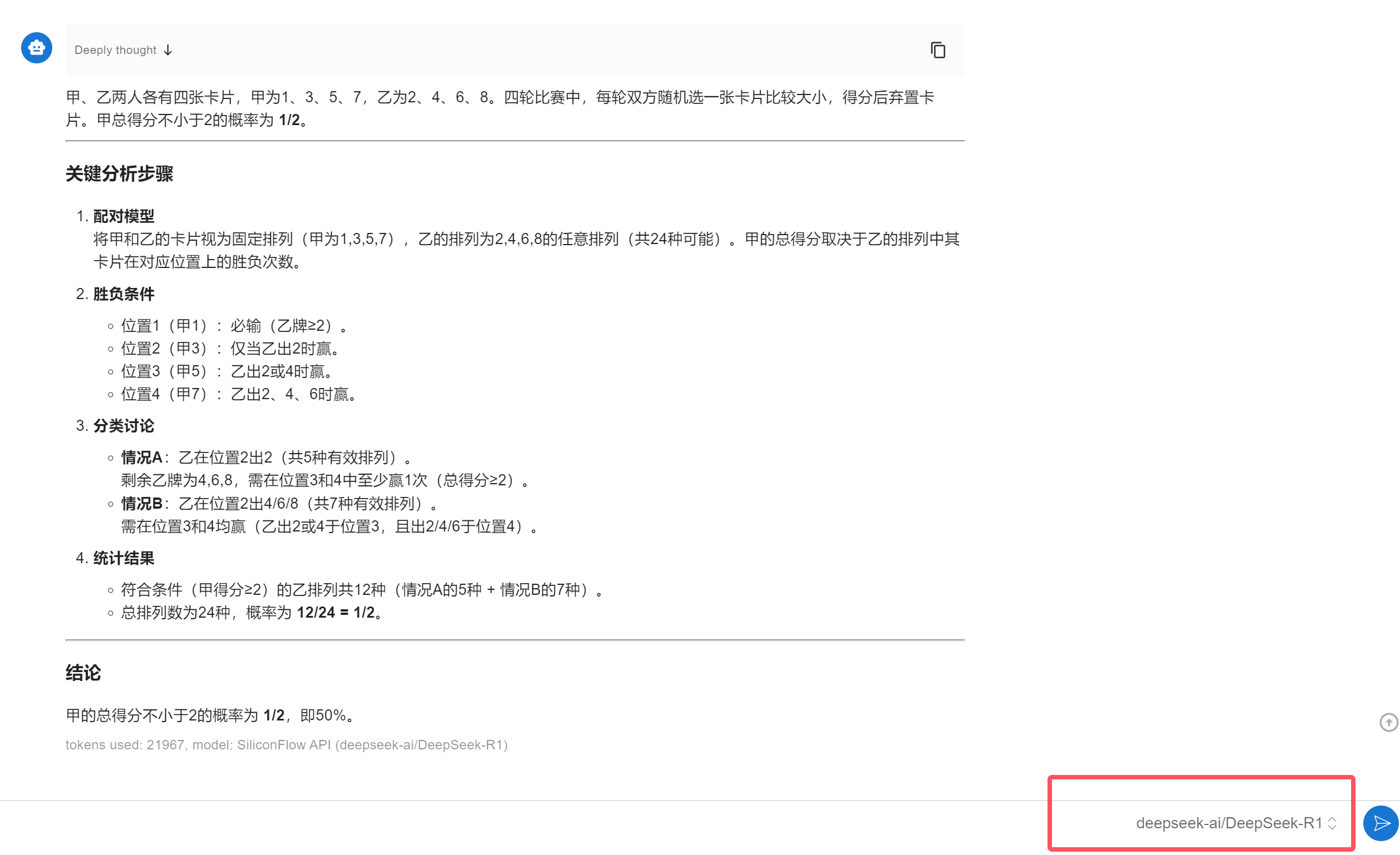

然而,现有的PC硬件配置往往限制了端侧大模型的部署。以DeepSeek-R1模型为例,7B/8B参数的模型需要至少16GB的内存。李伟昌指出,目前主流PC仍多配备16GB内存,运行7B参数模型可能会影响设备的流畅度,而要达到32GB内存才能较为流畅地运行该模型,同时不影响用户在其他应用上的使用。

更重要的是,即便PC内存足够,本地运行的AI大模型也未必能带来理想的用户体验。以一道2024年全国高考数学题为例,虽然满血版的DeepSeek-R1模型能够迅速给出正确答案,但切换到本地部署的7B参数模型后,推理时间长达十几分钟,且给出了错误的答案。这表明,要获得更好的端侧AI体验,需要部署参数更多的AI大模型,而这又需要更大的内存和更高的AI算力。

目前,AI PC在AI功能上的不足以及运行端侧大模型的吃力,使得其未能与未搭载NPU的PC拉开明显差距。要改变这一现状,需要AI大模型开发机构、供应链企业和PC厂商三方面的共同努力。

大模型开发机构需要在确保模型能力和准确性的前提下,进行模型优化或蒸馏,减少对硬件资源的依赖。供应链企业需要降低生产成本,推动硬件价格的合理化。而PC厂商则需要将AI大模型与实际应用紧密结合,提升用户体验。

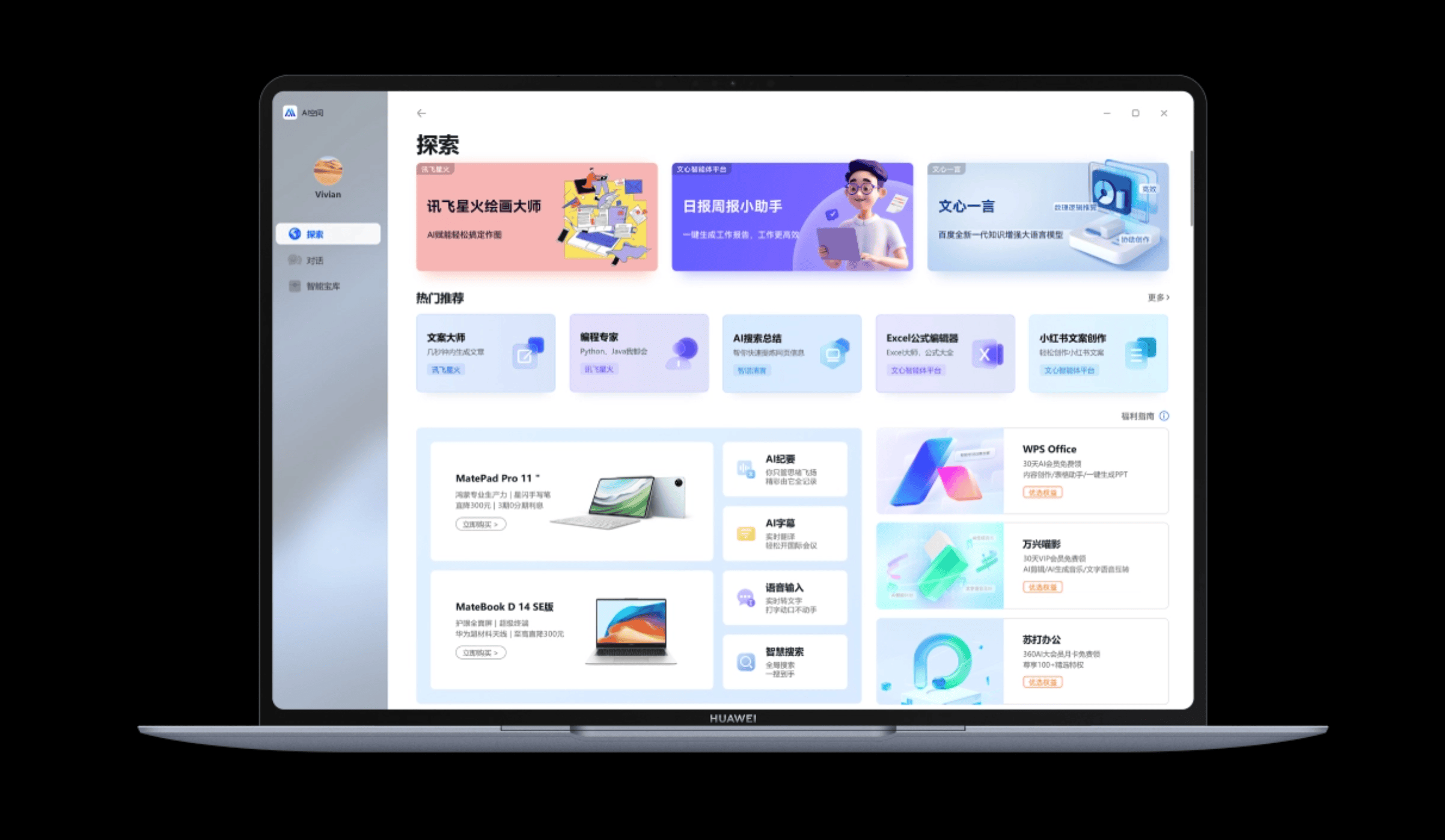

在这方面,华为和联想等厂商已经做出了积极探索。华为的MateBook基于盘古大模型,实现了AI纪要、AI慧眼等功能,大幅提升了工作效率。联想则推出了天禧AI生态“四端一体”战略和个人智能体“小乐同学”,通过跨端协同和多模态大模型的应用,为用户提供更加个性化的服务。

尽管AI PC在技术和市场上面临诸多挑战,但其发展潜力不容忽视。市场调研机构Canalys的数据显示,2024年中国大陆地区AI PC的出货量已达580万台,占总出货量的15%,预计2025年市场份额将达到34%。随着市场规模的扩大,AI PC的成本将进一步降低,吸引更多消费者购买。

多位业内人士表示,AI PC的发展主要受限于内存、芯片等上游产业链,成本控制和规模化生产仍需优化。按照产业升级周期规律,预计2-3年内,AI PC产业链将趋近成熟。