全球最大的AI模型聚合平台OpenRouter上,一场关于算力与电力的较量正在悄然展开。这个被比作AI领域"Steam"的平台,每日处理超过1万亿Token的请求量,长期由美国模型主导市场。然而,近期中国AI模型的表现令人瞩目——今年2月,国产模型调用量三周内激增127%,首次实现对美国模型的超越,其中2月9日至15日单周处理量达4.12万亿Token,远超美国同期的2.94万亿。

这场逆袭背后,隐藏着AI产业最核心的竞争逻辑:当7分钱的电力通过显卡转化为Token后,竟能以18元的价格出售给美国用户,价格差距达25倍。这种看似暴利的商业模式,实则折射出全球算力市场的结构性矛盾——美国虽掌握着最先进的芯片技术,却面临着电力基础设施老化的困境。马斯克等科技巨头不得不通过自建电厂缓解算力中心的用电压力,但这种临时性方案难以应对未来持续增长的算力需求。

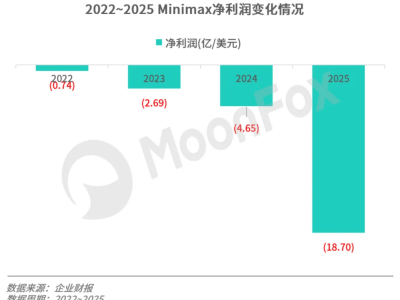

中国模型的崛起并非偶然。以MiniMax M2.5、Kimi K2.5和DeepSeek V3.2为代表的国产模型,凭借价格优势迅速占领市场。这些模型每Token生成成本不足美国同类产品的十分之一,且性能差距持续缩小。OpenRouter平台数据显示,前五名调用量模型中,中国产品占据三席,形成稳定的第一梯队。这种优势直接反映在用户选择上——某开源项目用户抱怨,刚充值的20美元Token余额,在设定简单任务后竟一夜耗尽,凸显出全球AI应用对Token的巨大需求。

但繁荣表象下藏着产业痛点。调查发现,虽然模型来自中国,但支撑这些模型运行的算力中心大多位于美国。以MiniMax M2.5为例,其服务器集群主要部署在美国数据中心,仅DeepSeek V3.2保留了部分国内算力。这种"模型出海、算力留守"的现象,暴露出中国AI产业在全球化进程中的现实困境:数据安全法规限制、高端芯片获取困难以及用户体验优化需求,共同推动企业选择海外算力资源。

美国第14117号行政令成为横亘在中国AI企业面前的壁垒。该法令严格限制向中国传输敏感个人数据,包括基因信息、生物识别、健康数据等。若中国服务器处理这类数据,将直接面临禁令风险。更严峻的是芯片差距——英伟达B200芯片的推理能效达到H100的25倍,这种技术代差使得国内算力中心在成本竞争中处于劣势。典型案例是出海应用Talkie,其虽使用中国训练的模型,但推理算力完全依赖亚马逊、谷歌等美国供应商,运营主体也注册在新加坡以规避风险。

产业格局正在发生微妙变化。IDC最新报告显示,2025年上半年中国加速芯片市场规模突破190万张,国产AI芯片市场份额攀升至35%。华为昇腾等企业推出的新产品,开始在推理端市场与英伟达形成竞争。这种技术突破为算力出海带来转机——当国产芯片能效比接近国际水平时,中国电力成本优势将转化为真正的市场竞争力。与此同时,美国结构性缺电问题持续恶化,其电力基础设施更新需要数十年时间,这为中国算力产业提供了战略机遇期。