在圣何塞SAP中心,英伟达创始人黄仁勋身着标志性黑皮衣,在一场长达两小时的发布会上抛出多项震撼业界的重磅消息。这场以人工智能为核心的技术盛宴,不仅展示了英伟达在芯片领域的突破性进展,更勾勒出AI商业化落地的全新图景。

发布会的核心焦点当属Vera Rubin计算平台的问世。这个专为代理式AI设计的系统整合了七款突破性芯片、五个机架和一台超级计算机,形成完整的AI基础设施解决方案。相较于前代Blackwell平台,新系统在混合专家大模型训练中仅需四分之一的GPU资源,单Token生成成本降低至十分之一,每瓦特推理吞吐量提升达10倍。更引人注目的是其全液冷设计,通过45℃温水循环冷却,将数据中心安装时间从两天压缩至两小时,能源效率实现质的飞跃。

在中央处理器领域,英伟达正式向英特尔和AMD发起挑战。新发布的Vera CPU采用深度定制的Arm v9.2-A Olympus核心,配备88个物理核心和144个线程,单线程性能较传统机架式CPU提升50%。其革命性的"空间多线程"技术通过物理隔离流水线组件,彻底消除多线程资源竞争问题。这款全球首款采用LPDDR5的数据中心CPU,将与Rubin GPU通过1.8TB/s的NVLink-C2C互连技术实现无缝协作,首批合作厂商已涵盖阿里巴巴、meta等科技巨头。

针对AI推理的特殊需求,英伟达通过收购Groq团队推出了LPU(语言处理单元)技术。每个Groq 3 LPU芯片集成500MB SRAM内存,提供150TB/s的惊人带宽,较传统HBM方案提升近7倍。当与Rubin平台协同工作时,这种高低延迟处理器的组合使每兆瓦推理吞吐量提升35倍,万亿参数模型的处理效率提升10倍。英伟达构建的256芯片LPX机架可提供128GB SRAM和40PB/s推理带宽,为大规模AI部署提供硬件基础。

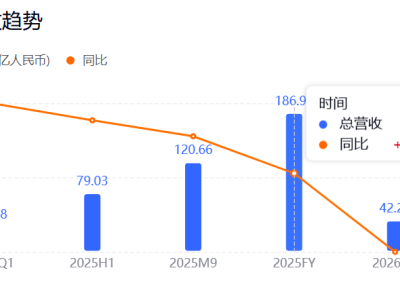

黄仁勋在演讲中揭示了AI需求爆发的底层逻辑:"过去两年AI计算需求增长万倍,推理已成为核心驱动力。"基于这一判断,英伟达预测到2027年将出现万亿级市场需求。为应对这种变革,公司推出Token分层定价体系,从免费层到每小时150美元的顶级服务,构建起AI工厂的商业模式框架。按照其测算,Vera Rubin架构可使Token生成速率提升350倍,远超摩尔定律的演进速度。

在开源领域,英伟达宣布全力支持OpenClaw社区发展,推出配套的NemoClaw安全框架。这个被誉为"AI时代Windows"的代理式系统操作系统,能够在保障数据隐私的前提下,实现大型语言模型与工具系统的深度集成。黄仁勋特别强调:"每家公司都需要制定OpenClaw战略,就像二十年前必须拥抱互联网一样。"

发布会的惊喜远不止于此。英伟达与台积电合作开发的COUPE共同封装光学技术,使Spectrum-X交换器实现芯片级光互连;全新Kyber机架通过垂直插入设计,在单一NVLink域内连接144个GPU;BlueField-4 STX存储机架则将GPU内存扩展至整个数据中心。这些技术突破共同构建起端到端的AI基础设施解决方案。

当黄仁勋展示完整的芯片路线图并宣布"每年推出全新架构"时,现场爆发出持久掌声。这场发布会不仅展示了英伟达的技术实力,更预示着AI产业即将进入大规模商业化落地的新阶段。从芯片设计到系统集成,从商业模式到安全框架,英伟达正在重新定义人工智能时代的游戏规则。