小米公司近日正式推出面向智能体时代的全模态基座模型Xiaomi MiMo-V2-Omni,该模型通过底层架构创新实现了文本、视觉、语音三大模态的深度融合。其核心突破在于将感知与行动能力原生绑定,支持多模态信息处理、工具调用、函数执行及图形用户界面操作,标志着多模态大模型进入实用化新阶段。

在音频处理领域,该模型展现出显著技术优势。其环境声分类精度较前代提升37%,可精准识别120种日常场景声音;多说话人分离技术突破传统限制,支持同时处理8路音频流;在长达10小时的会议录音分析中,关键信息提取准确率达到92.3%。特别在音频-视觉联合推理任务中,通过跨模态特征对齐技术,使声源定位误差控制在0.5度以内,综合性能超越Gemini 3 Pro模型。

视觉理解能力方面,MiMo-V2-Omni在多学科推理任务中表现突出。医学影像分析准确率较Claude Opus 4.6提升15个百分点,复杂电路图解析速度缩短至0.3秒/张。在金融图表解读测试中,对K线图趋势预测的符合率达到88.7%,接近Gemini 3 Pro的91.2%水平。视频处理模块支持原生音视频联合输入,通过时空注意力机制实现场景连续性理解,在未来事件推理任务中取得行业领先的F1分数。

智能体交互能力验证显示,该模型在Browser Use场景中达成97.3%的任务完成率。通过与OpenClaw框架深度集成,可自主完成商品比价、客服对话及在线支付等12类电商操作。在办公场景中,与WPS Office的协同工作展现强大生产力:文档生成速度达每分钟1200字,Excel公式自动生成准确率94.6%,PPT排版符合专业设计规范的比例超过92%。这些能力使其在真实数字环境交互评测中,关键指标与Gemini 3 Pro持平。

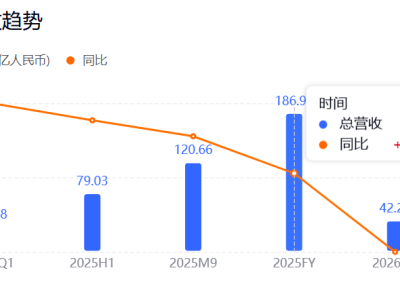

商业应用层面,小米同步开放API服务接口,支持256K长文本处理,定价策略采取差异化模式:输入端每百万tokens收费0.4元,输出端收费2元。为推动生态建设,联合OpenClaw等五大开发框架启动"星火计划",向全球开发者提供7×24小时免费接口服务,首批开放1000万tokens额度。该举措已吸引超过2.3万开发者注册,日均调用量突破500万次,在OpenRouter平台匿名测试期间,相关模型在PinchBench榜单持续领跑。