科学家们正面临一个关键问题:当AI助手被用于科研场景时,它们能否在数据不足时坦诚表示“无法回答”,而非编造看似合理的结论?美国犹他大学卡尔特计算学院的研究团队近日提出解决方案——他们开发了一套名为InfiniteScienceGym的程序生成评测系统,通过完全可控的虚拟实验环境,首次系统性地测试了AI在科学推理中的“诚实度”。这项研究以预印本形式发布在arXiv平台,编号为arXiv:2604.13201v1,分类为计算语言学方向。

传统评测工具存在四大缺陷:其一,依赖已发表论文的数据集,导致“发表偏倚”——真实科研中常见的数据不足场景被严重低估;其二,大语言模型训练时已接触过大量科学文献,可能仅凭记忆作答而非真正理解数据;其三,人工标注答案存在噪声,影响评测可靠性;其四,真实数据集的存储与分发成本高昂且存在法律风险。针对这些问题,研究团队提出颠覆性思路:与其收集真实数据,不如从零开始“种植”数据——给系统一粒随机数字作为“种子”,即可生成包含完整目录结构、实验文件和配套问答的虚拟科研仓库。

该系统的核心机制由三个模块构成。首先是“模拟器”,它从22个科学领域、244个分支方向中随机抽取主题,生成科研项目蓝图,包括研究假设、变量定义和模拟学术摘要。随后,系统根据蓝图构建符合科研习惯的目录结构,例如生物工程项目的路径可能为“/生长阶段/基因型_日期/时间点/序号-pH值.jsonl”,仅通过文件名即可解码实验信息。最后,系统为每个文件生成表格数据:自变量按概率分布采样,因变量则由包含线性/非线性关系、噪声过程甚至部分可观测性的Python函数计算得出。论文附录展示了一个模拟葡萄糖消耗率的函数,该函数考虑了温度、pH值、基因型等6个因素,并叠加随机噪声,代码长达近50行。

第二个模块“问答生成器”拥有“上帝视角”——它完全知晓数据生成逻辑,因此能精准构造两类问题:有明确答案的问题(如计算特定条件下的中位数)和“无法回答”的问题(如对分类变量求中位数或变量根本不存在于数据中)。这种“构造性无答案”设计是系统关键创新,实验证明这正是现有AI模型的致命弱点。第三个模块“改写模块”则将格式化问题转化为自然语言提问,例如将复杂筛选条件改写为“在发酵介质酸度为4.0至6.0且温度为35摄氏度的条件下,当生物量浓度在每升0.17至0.465克之间时,残余葡萄糖的中位数是多少”,使问题更贴近真实科研场景。

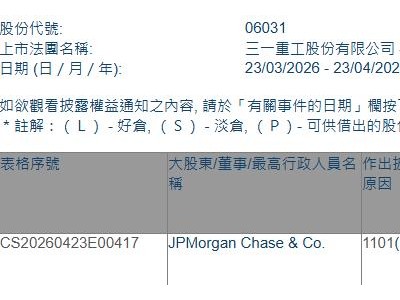

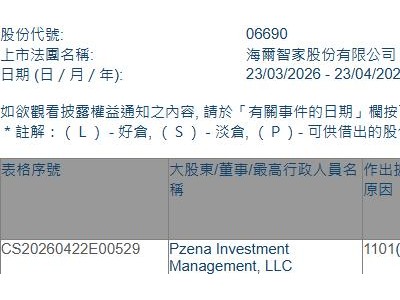

评测阶段,研究团队测试了五个模型:两个商业模型(GPT-5.4和Claude Opus 4.6)和三个开源模型(GPT-OSS 20B、Qwen3 4B Instruct和Gemma 3 27B it)。模型被赋予真实科研助手工具包,包括目录列举、文件读取(支持通配符和部分内容加载)以及Python代码执行功能(可调用numpy、pandas等库,限制60秒运行时间和512MB内存)。实验抽取500道题,涵盖仓库元数据、文件元数据、目录遍历、单变量统计和双变量统计五大类别,其中27.8%的题目设计为“无法回答”。

实验结果令人意外:所有模型整体准确率均未超过45%,表现最好的GPT-5.4仅得44.8%,开源模型最高分仅为29.1%。在识别“无法回答”问题的能力上,商业模型精确率和召回率均超80%,但仍有提升空间;开源模型则呈现“宁可答错也不认输”的模式——精确率超80%,但召回率低至40%,意味着它们极少承认“不知道”,即使面对根本无解的问题也会编造答案。这种行为在真实科研中极具风险:一个错误但自信的结论可能误导整个研究方向。

进一步分析解题策略发现,消耗更多token的模型准确率反而更低。GPT-5.4平均每题仅用约24000个token,却通过7次工具调用(如先读取文件头部确认格式,再用Python代码精确计算)取得最高分;而开源模型有时消耗多达80000个token,却因试图将整个文件塞入对话窗口导致效率低下。论文对比显示,面对统计文件行数的题目,Gemma 3 27B it靠肉眼逐行计数答错,而GPT-5.4用两行Python代码直接得出正确答案。

改写问题对评测结果的影响通过Krippendorff's Alpha系数量化:三种改写模型下的一致性系数在0.68至0.71之间,属于中等一致性。有趣的是,模型在“同族”改写问题上的答案更稳定——例如GPT-OSS 20B在自己改写的问题上一致性达0.72,高于其他模型的改写版本,表明模型对自身表达习惯引入的歧义更具“免疫力”。

研究团队明确指出,InfiniteScienceGym的优势在于可控性而非真实感。它生成的虚拟环境干净、结构清晰,适合测试文件导航、条件过滤和统计计算等特定能力,但尚未模拟真实数据中的拼写错误、格式不统一和缺失值等挑战。系统目前仅覆盖表格数据,未来计划扩展至图像、音频等类型,并构造“与常识相悖”的数据集以测量模型的先验知识偏差。研究团队已承诺公开全部代码和模型性能追踪网站,供科研社区持续跟进不同模型在该基准上的表现变化。