在生成式人工智能技术快速迭代的当下,内容平台正面临前所未有的治理挑战。当AI生成的图像、视频甚至对话能够以假乱真时,如何守护社区的真实性底色,成为各大平台必须解答的核心命题。近日,某知名生活方式平台在北京举办专题研讨会,首次系统阐述其AI内容治理框架,提出"以人为本"的治理理念引发行业关注。

该平台用户信任中心负责人指出,当前AI技术滥用已呈现三大特征:身份伪造技术门槛持续降低,批量生产低质内容形成产业链,名人仿冒与虚假人设现象高发。数据显示,今年以来平台累计处置AI托管账号超80万个,下架AI造假笔记近15万篇,涉及仿冒名人、虚构经历、伪造证件等多个领域。这些数据背后,是普通用户对内容真实性的焦虑——当一张照片可能由算法生成,一段语音可能经过深度伪造,用户对屏幕那端的信任正在被技术消解。

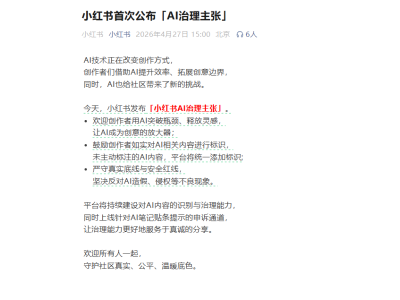

针对这一现状,平台构建了"鼓励-禁止-标识"的三维治理体系。在创作激励层面,明确将AI定位为"创意放大器",鼓励创作者运用AI突破技术瓶颈而非替代核心创作。典型案例显示,某央美国画毕业生借助AI将静态画作转化为动态影像,既保留了原创手绘的精髓,又通过算法实现了传统技法难以呈现的视觉效果。这种"人类主导+AI辅助"的模式,被定义为优质AI内容的黄金标准。

治理框架同时划定了四条不可逾越的红线:严禁账号完全托管给AI运营,禁止利用AI伪造身份或传播虚假信息,反对批量生成同质化内容,抵制侵犯知识产权的创作行为。对于违规账号,平台采取梯度处罚机制,其中完全由AI运作的账号将直接封禁。值得关注的是,治理并非简单的"一刀切",而是建立了动态识别与申诉机制,确保治理措施精准有效。

在保障用户知情权方面,平台推行强制标识制度。所有AI参与创作的内容必须主动声明,未标识内容将由系统自动添加识别标签。负责人特别强调,标识行为不涉及流量惩罚,非违规内容不会因此受限,这既维护了创作者的合法权益,也保障了用户的知情选择权。数据显示,标识制度实施后,用户对内容真实性的投诉量下降37%,社区互动质量显著提升。

行业观察人士认为,该平台的治理实践为行业提供了重要参考。当前多数平台对AI内容采取"放任"或"严打"的极端策略,要么放任AI内容冲击社区生态,要么简单封禁所有算法生成内容。而此次提出的治理框架,通过明确创作边界、建立识别标准、完善处罚机制,在技术创新与价值守护之间找到了平衡点。这种精细化治理模式,或将推动整个行业建立更健康的AI内容生态。