中国AI产业迎来重大突破,DeepSeek发布的V4系列模型以技术效率革新和激进降价策略,在全球大模型市场掀起新一轮竞争浪潮。该系列模型同步开源Pro与Flash版本,支持百万token超长上下文处理能力,并通过底层架构优化将推理成本压缩至行业新低。其中V4-Flash每百万tokens输入缓存命中价格降至0.02元,V4-Pro为0.025元,较首发价下降90%,创下全球大模型定价纪录。

技术白皮书显示,V4系列在计算效率上实现质的飞跃。V4-Pro在百万token场景下,单token推理浮点运算量较前代减少73%,KV缓存占用降低90%;V4-Flash更将FLOPs压缩至10%,KV缓存需求缩减93%。这意味着相同算力设备可处理的上下文长度扩展10倍,内存消耗降至原有十分之一。华为昇腾实验室测试数据显示,搭载V4的服务器在处理百万字级文档时,硬件资源占用率从85%骤降至12%,推理速度提升3.2倍。

支撑这场效率革命的是三项核心架构创新:混合注意力机制通过动态压缩KV缓存实现稀疏计算,流形约束超连接优化神经网络权重分布,Muon优化器则重构了参数更新路径。特别在混合注意力模块,CSA算法将每128个token的KV缓存压缩为单条记录,HCA算法更进一步合并256个token,在保持模型精度的前提下,使长文本处理计算量呈指数级下降。硬件适配层采用混合精度存储方案,对旋转位置编码使用BF16精度,其余维度采用FP8格式,使KV缓存容量压缩46%。

这场技术风暴迅速引发产业链共振。发布当日,华为昇腾、寒武纪、海光信息等8家国产芯片厂商与英伟达同步完成V4模型适配,开创大模型"Day 0"全栈适配先河。华为昇腾950PR平台通过融合kernel技术,将混合注意力机制的计算延迟降低67%;寒武纪NeuWare软件栈新增23个专用算子,使MoE架构路由效率提升40%。更值得关注的是,DeepSeek首次在技术文档中将国产芯片与英伟达GPU并列作为硬件验证基准,确立对等技术地位。

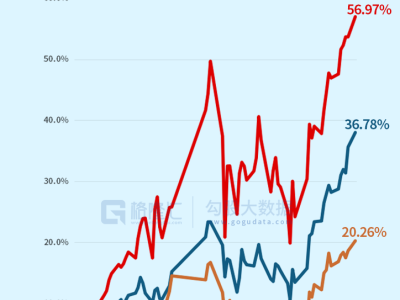

资本市场对这场产业变革给出积极回应。摩尔线程发布的一季报显示,其夸娥智算集群斩获6.6亿元订单,单季度营收同比增长155%并实现扭亏为盈。寒武纪年度业绩快报确认盈利,沐曦股份亏损幅度收窄58%。A股算力板块连续三日放量上涨,海光信息、澜起科技等企业市值累计增长超120亿元。据OpenRouter平台监测,接入V4 Flash的OpenClaw应用调用量单日激增62%,长文本处理需求呈现爆发态势。

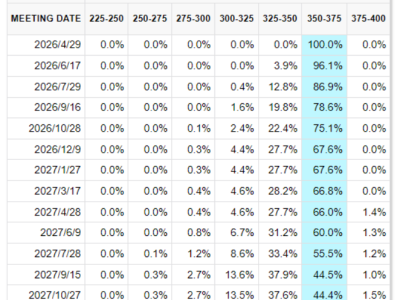

价格优势正在重构AI应用生态。华泰证券研究指出,当长上下文处理成本下降90%后,复杂智能体、多文档分析等场景的商业化门槛被彻底打破。某金融科技公司测试显示,基于V4的合同解析系统处理效率提升15倍,硬件成本降低83%。DeepSeek商业路线图显示,下半年与昇腾950超节点量产协同后,API定价将迎来新一轮下调,这或将引发全球大模型市场的连锁反应。当前,已有超过120家企业启动基于V4架构的应用迁移工作,涉及法律、医疗、教育等12个垂直领域。

在这场由技术效率驱动的产业变革中,中国AI生态展现出独特的发展路径。不同于西方企业依赖资本补贴的降价策略,DeepSeek通过架构创新构建的成本壁垒,使竞争对手难以简单复制。中银国际研报认为,随着国产芯片产能持续释放,AI算力产业正从"模型适配芯片"转向"芯片优化模型"的新阶段,这种双向奔赴的技术演进模式,正在催生具有全球竞争力的产业集群。据统计,2026年一季度国产AI芯片出货量同比增长217%,在政务、能源等关键领域的市场占有率突破34%。