阿里巴巴Qwen团队近日发布了一项突破性成果——全感官AI模型Qwen3.5-Omni,该模型在多模态交互领域实现重要跨越。与传统AI系统仅能处理单一模态数据不同,新模型可同步处理文字、图像、音频和视频信息,并支持实时语音交互,标志着人工智能向"全感官"认知迈出关键一步。

研究团队创新设计的"Thinker-Talker"双角色架构成为核心技术支撑。其中"思考者"模块负责整合多模态输入,通过混合注意力混合专家架构实现超长上下文理解,支持256k词元处理能力,相当于完整解析一本长篇小说。配套的"说话者"模块则采用多码本编解码器与ARIA技术,在保证语音自然度的同时,将流式生成稳定性提升至行业领先水平。

在音频处理方面,自主研发的音频变换器AuT展现出强大实力。该组件通过4000万小时的音视频配对数据训练,可精准分离环境噪音、人声和背景音乐。动态注意力窗口机制使其在实时语音流和离线音频分析场景中均保持优异表现,支持每秒1帧的720P视频长达400秒的连续处理。

多模态同步技术取得突破性进展。新型位置编码技术TM-RoPE通过文字时间戳插入方式,有效解决了长视频中的时间关联难题。实验数据显示,模型在视频帧采样与音频流的时间对齐精度达到160毫秒级,确保跨模态信息融合的准确性。这种设计使系统能灵活支持任意时长的流式输入,为实时交互奠定基础。

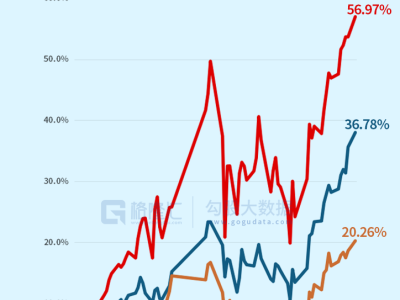

性能评测显示,Qwen3.5-Omni-Plus在215项音频音视频基准测试中刷新纪录,在音乐结构分析、歌曲形态识别等专项测试中领先竞争对手13个百分点。语音识别模块支持113种语言方言,在中文、粤语等测试集中词错误率低至1.95%,较前代模型提升40%。语音生成模块实现29种语言的零样本克隆,中文音色相似度达0.800,跨语言迁移错误率下降72%。

技术架构创新体现在多个维度。混合MoE骨干网络配合门控Delta模块,使长序列处理吞吐量提升3倍。分块预填充机制将首词元生成延迟压缩至435毫秒,轻量化Flash版本更将这一指标降至235毫秒。三阶段预训练策略通过32768至262144词元的渐进式扩展,使模型具备处理超长文本的能力,在长视频理解测试中得分较基础版本提升12%。

实际应用场景中,模型展现出三大独特能力:可控音视频字幕生成可自动标注场景切换和时间码;实时交互系统支持语义级语音打断和端到端声控调节;最引人注目的是"音视频氛围编程"能力,模型能根据多媒体指令直接生成可执行代码,在测试中成功完成视频处理脚本的自动编写。

对比测试揭示更多技术细节。在MMLU-Pro知识测试中,多模态版本与纯文本模型得分差距小于1%,证明新增感官能力未影响核心文本处理性能。视频理解测试Video-MME显示,模型对动态场景的推理准确率达81.9%,较文字版本提升0.9个百分点。医疗视觉问答SLAKE测试中,多模态优势使得分提高1.9个百分点,验证了跨模态信息融合的临床价值。

语音生成质量评测采用SEED-TTS基准,中文词错误率控制在0.99%,英文达1.26%,创下新纪录。跨语言语音克隆测试中,中文到韩语迁移的混合错误率仅4.03%,较同类产品降低72%。在29种语言的自定义声音生成测试中,模型展现出强大的泛化能力,无需额外训练即可在日语、韩语等挑战性语言上保持低错误率。

该成果论文编号arXiv:2604.15804v1已开放下载,详细披露了双角色架构设计、ARIA技术原理及三阶段训练策略。研究团队特别指出,"音视频氛围编程"等涌现能力揭示了大规模多模态训练的潜在价值,这类能力可能重塑人工智能的应用边界。目前模型已开放Plus和Flash两个版本,分别面向高性能计算和边缘设备场景。