在数字化浪潮的推动下,针对产品和工程团队,一份全新的指南应运而生,专注于AI智能体的构建策略与实践。这份指南深入探讨了智能体的定义、应用场景以及设计的基本原则,为行业提供了宝贵的参考。

智能体,这一概念指的是能够自主代表用户执行任务的系统。其核心优势在于,不仅能够利用大型语言模型(LLM)来管理和执行工作流程中的决策,还能够与外部系统交互,动态选择并使用工具,同时确保所有操作都在明确的约束范围内进行。这与那些仅仅集成了LLM却缺乏对工作流控制的应用形成了鲜明对比。

那么,在哪些场景下构建智能体最为合适呢?指南指出,当传统方法在处理复杂决策、维护规则以及处理非结构化数据时面临局限时,便是智能体大显身手的好时机。然而,在着手构建之前,验证用例是否符合这些标准至关重要,否则,采用确定性解决方案可能会更加高效。

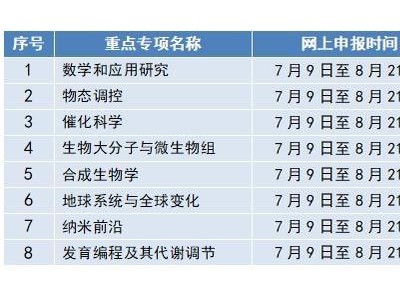

在设计智能体的过程中,有三大核心组件不可或缺:模型、工具和指令。在选择模型时,需要综合考虑任务的复杂度、延迟要求以及成本效益,通常可以先从性能最强的模型入手,随后逐步尝试用更小的模型进行优化。工具方面,需要标准化定义,并根据需求的不同,采用多样化的工具类型。当工具数量增多时,可以考虑引入多智能体协作机制。至于指令,则要求高质量,必须明确、分步骤,清晰定义行动路径,并涵盖可能出现的边缘情况。还可以借助高级模型来生成更高效的指令。

在智能体的编排模式上,主要分为单智能体和多智能体系统两种。单智能体通过增量添加工具来应对多任务,循环运行直至满足退出条件。而多智能体系统则更加复杂,包括经理模式(由一个中央经理智能体协调多个专业智能体)和去中心化模式(智能体之间平等协作,互相移交任务)。

安全性与防护措施在智能体构建中同样占据重要地位。为了形成有效的分层防御体系,可以结合多种防护机制,如相关性分类器、安全分类器等。在构建过程中,必须高度重视数据隐私和内容安全,根据实际情况不断添加新的防护措施并进行优化,以在保障安全与提升用户体验之间找到最佳平衡点。同时,规划人类干预机制也至关重要,当智能体运行超出失败阈值或执行高风险操作时,人类可以迅速介入。

构建可靠的AI智能体并非易事,需要从坚实的基础做起,采用与任务复杂度相匹配的编排模式,并始终将防护措施放在首位。通过小范围启动、逐步扩展并经过用户验证,智能体将能够不断提升能力,最终为企业带来实实在在的业务价值。