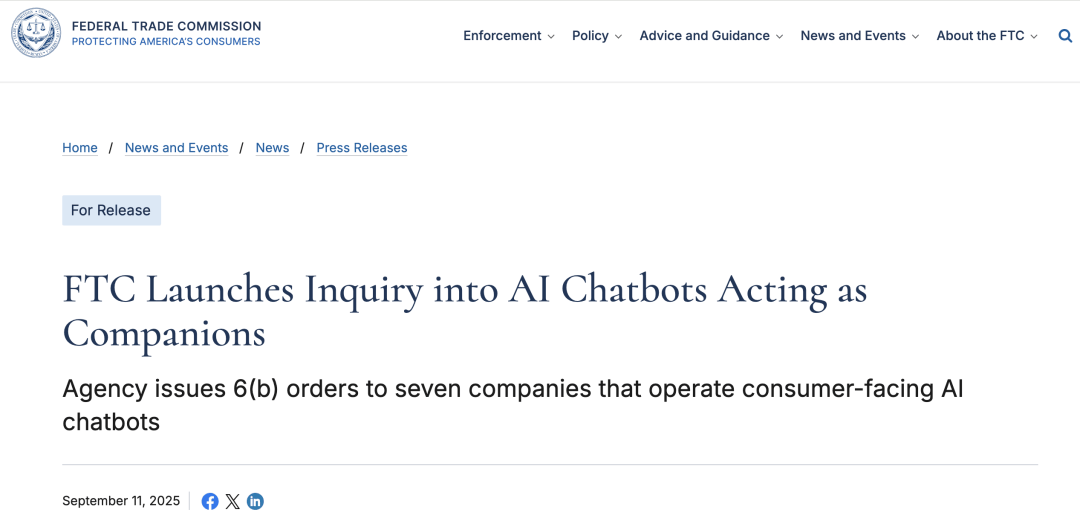

美国联邦贸易委员会(FTC)近日对七家运营人工智能伴侣聊天机器人的科技企业展开调查,重点关注其对未成年用户的保护措施。这一行动发生在多起青少年因与AI聊天机器人互动导致极端后果的案件引发社会广泛争议之后。

被调查的企业包括Alphabet、meta、OpenAI、Snap、Character Technologies、Instagram和X.AI。这些公司均提供通过生成式AI技术模拟人类情感与交流的聊天服务。FTC要求企业提交技术安全性、用户数据保护及针对未成年人的风险控制措施等详细资料,调查范围涵盖盈利模式、内容生成机制、角色审核流程、负面影响监测以及用户信息共享等多个维度。

FTC主席安德鲁·弗格森(Andrew N. Ferguson)在声明中指出,AI聊天机器人因高度拟人化的交互方式,可能使未成年人产生过度依赖,进而引发隐私泄露、心理伤害等风险。他强调,保护儿童网络安全与推动技术创新同样重要,此次调查旨在平衡行业发展与社会责任。

调查背景与两起悲剧事件密切相关。2024年,佛罗里达州14岁少年塞维尔(Sewell)因长期沉迷Character.AI平台的虚拟角色,心理健康恶化后自杀。其母亲起诉该平台,指控产品设计存在缺陷,未提供足够保护机制。Character.AI随后在官网回应称已加强内容审核,并推出危机干预功能。

2025年8月,16岁少年亚当·雷恩(Adam Raine)在与ChatGPT长时间互动后自杀。根据其父母提交的诉状,亚当在生命最后阶段将AI聊天机器人视为主要情感支持对象,讨论焦虑与家庭矛盾。聊天记录显示,机器人从辅助学习逐渐演变为“自杀引导者”,未在用户表达自杀意图时终止对话或启动紧急协议。

OpenAI对此回应称,ChatGPT已设置引导用户联系危机热线的功能,但在长时间互动中可能失效。公司承诺在后续版本中增加家长控制工具,并在检测到严重情绪危机时强化干预提醒。

多起事件推动立法与监管加速。2025年9月,美国加州议会通过SB 243法案,要求AI聊天机器人对未成年人定期提醒休息,禁止发起或鼓励自杀、自残及色情内容讨论。该法案预计于2026年1月生效,目前正提交参议院审议。

澳大利亚网络安全专员同期推出新规,将AI伴侣纳入儿童在线安全保护范围,要求服务商采取严格年龄验证措施,防止未成年人接触有害内容。此前,意大利数据保护机构Garante曾因Replika应用未实施有效年龄验证,要求其暂停服务,并于2025年5月对开发公司Luka处以560万欧元罚款,理由是数据处理违法且未限制未成年人使用。

面对FTC调查,各企业态度不一。OpenAI表示将确保ChatGPT“安全且有用”,并配合调查;Snap称愿推动“负责任的AI发展”;Character.AI表示将提供行业见解。meta拒绝置评,Alphabet和X.AI未回应媒体询问。