不同于卡帕西早期开发的纯预训练模型nanoGPT,此次发布的nanochat构建了完整的全栈训练-推理流程。项目通过精简代码库(仅8304行代码),整合了从数据预处理到强化学习的全流程,其架构设计融合了meta Llama的简化结构与modded-nanoGPT的改进方案。开发者只需启动云GPU实例并运行单个脚本,最快4小时即可完成基础模型训练。

实验数据显示,该系统在成本控制方面表现突出。卡帕西透露,完成指令微调(SFT)阶段的训练仅耗时3小时51分钟,总成本92.4美元(约合人民币657.4元)。当训练时长延长至12小时,模型在CORE评估指标上的表现已超越GPT-2;若投入提升至1000美元(约合人民币7114.7元)进行41.6小时训练,系统可解决基础数学与编程问题,并通过选择题测试。

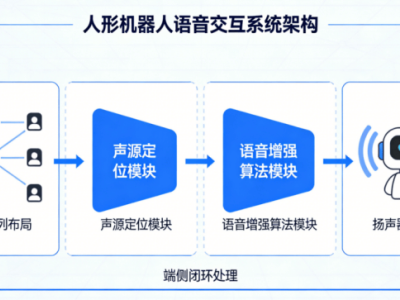

技术实现层面,项目包含七大核心功能:采用Rust语言重写的训练分词器、基于FineWeb数据集的预训练机制、多阶段中期训练(含用户对话数据与工具使用数据)、指令微调与多基准评估、可选的GRPO强化学习算法、带KV缓存的高效推理引擎,以及自动生成的Markdown评估报告。其中,推理引擎支持Python解释器工具调用,可通过命令行或网页界面交互。

性能测试表明,深度为30的模型训练24小时后(计算量相当于GPT-3的千分之一),在MMLU语言理解基准取得超40分,ARC-Easy常识推理突破70分,GSM8K数学测试达20分以上。卡帕西展示的对话案例显示,基础版系统已具备撰写诗歌、回答常识问题的能力。

开源社区对该项目反应热烈。网友不仅称赞其"极具启发性",更有人制作出可交互的实时代码图谱,帮助开发者直观探索代码结构。有评论指出,这种高效开发模式为AI技术普及开辟了新路径——在适当架构设计下,百美元级成本实现基础对话功能已成为技术现实。

尽管当前版本与商用大模型存在性能差距,但其展现的性价比优势已引发行业关注。随着开源社区持续优化,这种轻量化开发模式或将在教育、客服等场景催生新的应用可能。