在人工智能模型推理性能的激烈竞争中,英伟达与AMD的较量有了新进展。Signal65最新发布的SemiAnalysis InferenceMAX基准测试分析报告显示,在Deepseek-R1 0528混合专家(MoE)模型推理场景下,英伟达Blackwell GB200 NVL72机架系统展现出显著优势,其性能远超AMD的Instinct MI355X。

混合专家模型作为一种高效的AI架构,通过将任务分配给不同的“专家”模块来提升处理效率。以Deepseek-R1 0528为例,该模型在处理问题时仅激活最相关的“专家”,而非动用全部资源。然而,这种架构在扩展至大规模集群时,容易因节点间通信延迟和带宽压力导致计算瓶颈,成为制约性能的关键因素。

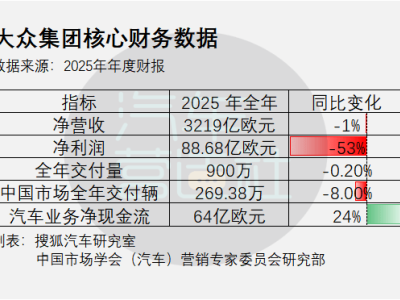

英伟达针对这一挑战推出了“极致协同设计”策略。GB200 NVL72系统通过紧密互联72颗芯片,并配备30TB高速共享内存,大幅优化了全对全通信效率。这种设计有效降低了数据传输延迟,使系统在处理复杂任务时更加流畅。测试数据显示,在类似集群配置下,英伟达方案每GPU的吞吐量达到75 tokens/秒,性能是AMD Instinct MI355X的28倍。

对于超大规模云计算厂商而言,成本与性能同样重要。Signal65结合Oracle云定价数据进行分析后指出,GB200 NVL72机架不仅性能强劲,经济性也令人瞩目。其每token的相对成本仅为AMD方案的十五分之一,同时提供了更高的交互速率,进一步巩固了英伟达在MoE领域的领先地位。

尽管英伟达在MoE领域占据主导,但AMD并未完全失去竞争力。报告提到,AMD的MI355X凭借高容量HBM3e内存,在稠密模型环境中仍是一个极具吸引力的选择。不过,目前AMD尚未推出新一代机架级解决方案来应对NVL72的挑战。

随着行业对机架级扩展方案的需求日益增长,英伟达与AMD的竞争将进一步升级。未来,AMD Helios平台与英伟达Vera Rubin平台的对决备受关注,双方在硬件设计、通信优化和成本控制等方面的创新,或将重新定义AI推理市场的格局。