智谱最新发布的基础模型GLM-5在技术圈掀起热议,这款被冠以“大模型第一股”之称的成果,凭借其显著提升的性能表现,成为行业焦点。其核心突破——异步智能体强化学习算法,被视为支撑模型在真实编程场景中脱颖而出的关键技术,引发开发者与科研人员的广泛关注。

作为下一代基础模型,GLM-5的定位是推动编程范式从“氛围编程”向“智能体工程”转型。据研发团队介绍,模型性能的跃升主要依赖四大技术创新:首先是DSA稀疏注意力机制的引入,这一架构通过动态分配注意力资源,在保持长文本理解与深度推理能力的同时,将训练与推理成本大幅降低,使模型参数规模扩展至7440亿,训练数据量提升至28.5万亿级别。

第二项创新在于构建异步强化学习基础设施。基于前代模型“训练与推理解耦”的设计理念,新系统进一步实现“生成与训练”的深度分离,通过优化GPU利用率,支持大规模智能体轨迹探索。这一改进有效解决了同步流程中的效率瓶颈,使强化学习后训练阶段的迭代速度实现质的飞跃。

在算法层面,GLM-5提出异步智能体强化学习框架,突破了传统依赖迭代自蒸馏与结果监督的训练模式。新算法通过长周期动态交互持续学习,重点优化了模型在复杂环境中的规划能力与自我纠错机制,显著提升了自主决策质量。这一改进被视为模型智能体能力提升的核心驱动力。

国产化适配是GLM-5的另一大亮点。该模型从研发阶段即深度整合中国GPU生态,完成从底层内核到推理框架的全面优化,目前已兼容华为昇腾、摩尔线程、海光等七大主流国产芯片平台。这一布局不仅降低了技术依赖风险,也为国内算力生态的完善提供了实践样本。

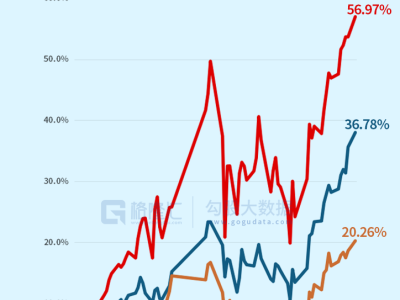

资本市场对GLM-5的发布反应热烈。自模型以“Pony Alpha”代号在OpenRouter平台匿名上线后,相关企业股价持续攀升,较发布前实现翻倍增长,最高触及725港元/股。这一表现反映出投资者对模型技术实力与商业化前景的高度认可。

开源社区同样对GLM-5报以热情。硅谷风投机构a16z的对比数据显示,该模型与全球顶尖闭源模型Claude Opus 4.6的能力差距正在快速缩小,这一结论进一步提振了开源阵营的信心。作为完全开源的模型,GLM-5的技术细节公开后,被开发者誉为“打破技术壁垒的重要里程碑”。

研发团队在技术报告中强调,GLM-5的突破性进展是对外界质疑的有力回应,但开源模型追赶闭源模型的竞赛远未结束。公司表示将持续探索技术边界,构建更高效的底层系统,为人工智能领域注入持续创新动能。