在人工智能领域,让大型语言模型驱动的智能体在复杂多轮互动中稳定学习并达到最优表现,一直是研究人员追求的目标。阿里巴巴通义实验室团队近期取得重要突破,提出了一种名为SeeUPO的新型强化学习算法,为解决这一难题提供了创新方案。

传统的强化学习方法在训练智能体时面临诸多挑战。以烹饪学习为例,智能体如同无法直接品尝自己作品的学徒,只能依赖外部反馈判断行动优劣。现有方法主要分为两类:一类是训练专门的评估网络来预测行动价值,如同为学徒配备品尝助手,但这种方法计算成本高,且评估网络水平不足会误导学习;另一类采用群体对比策略,通过比较多个行动结果来判断优劣,如GRAE算法,虽无需额外评估网络,但在多轮互动场景下,难以准确判断每轮行动的真实价值,导致学习过程不稳定。

多轮互动场景的复杂性远超单轮场景。以准备一顿完整晚餐为例,开胃菜、主菜和甜点的制作顺序和成功与否都会影响最终用餐体验。现有主流强化学习算法在处理这类问题时,存在根本性的权衡困境:无需评估网络的方法计算效率高,但多轮场景下难以保证稳定收敛;能保证收敛的方法又依赖准确的价值函数估计,这在多轮场景中几乎无法实现。

为深入理解这一问题,研究团队对主流算法进行了系统分析。他们发现,GRAE与REINFORCE组合在无折扣设置下虽能保证收敛,但折扣因子不等于1时,梯度估计会产生偏差;GAE与PPU组合理论上能保证单调改进和收敛,但依赖准确的价值网络估计,在多轮场景下难以实现;而GRAE与PPU组合存在致命缺陷,GRAE引入的结构性偏差会破坏PPO原有的单调改进性质,导致优势估计出现系统性偏差,且在多轮场景下这种偏差会随回合数增加而累积,引发严重的信用分配问题。

面对这些理论挑战,研究团队提出了SeeUPO算法。该算法的核心思想是将多轮互动问题转化为一系列顺序执行的多智能体单轮问题。具体而言,它将多轮互动建模为虚拟多智能体系统,每轮对应一个虚拟智能体,各智能体负责特定轮次决策,同时考虑其他智能体行动对全局结果的影响。SeeUPO最独特的设计是反向更新顺序,即按照从最后一轮到第一轮的顺序更新策略。这种设计灵感源自动态规划中的后向归纳法,当更新某一轮策略时,后续轮次策略已更新至最优,使得当前轮次能基于最优后续策略做决策,实现全局优化。

在技术实现上,SeeUPO采用HAML框架保证单调改进性,使用GRAE进行优势估计,避免依赖额外评估网络。同时,它通过优势函数分解实现隐式回合级信用分配,准确评估每轮行动真实贡献,分解基于重要性采样比率,将全局优势函数分解为各轮次条件优势函数。

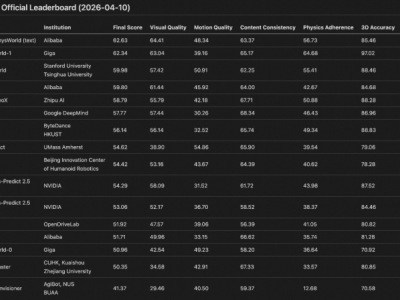

为验证SeeUPO的有效性,研究团队在AppWorld和BFCL v4两个具有挑战性的多轮智能体基准测试上进行了实验。AppWorld是可控的应用程序和人员世界,用于评估交互式编程智能体,要求智能体通过多步API交互完成复杂任务;BFCL v4是伯克利函数调用排行榜的多轮基准测试,注重智能体多轮对话中的函数调用能力,每轮结束进行基于状态和响应的双重检查。实验中,所有方法使用相同训练配置,采用Qwen2.5 - 14B和Qwen3 - 14B两个不同规模基础模型。结果显示,在Qwen3 - 14B模型上,SeeUPO在两个基准测试上平均性能分别达到60.80% avg@4和72.85% pass@4,相对改进幅度为43.3%到54.6%;在Qwen2.5 - 14B模型上,平均性能为53.07% avg@4和63.59% pass@4,相对改进幅度为24.1%到41.9%。SeeUPO在训练稳定性方面表现优异,所有测试场景中训练曲线稳定,未出现灾难性性能崩溃,而其他方法如GRPO和GSPO在某些设置下性能下降严重。

研究团队还进行了一系列消融实验,验证了反向更新顺序的重要性,与随机顺序或正向顺序相比,反向更新性能最佳,证实了后向归纳理论的有效性。同时,比较了三种优势归一化策略,发现批级归一化既能提供数值稳定性,又能保持理论收敛保证,而组级归一化会破坏收敛性保证。

在计算效率方面,SeeUPO因采用回合级顺序更新机制和优势修正项计算,训练时间约为基线方法的1.5倍。但它能更快收敛到更好性能水平,且与其他无评估网络方法使用相同计算资源(8个GPU),传统PPO方法则需16个GPU训练额外价值网络。更重要的是,SeeUPO避免了训练失败风险,从长期看更加经济高效。

SeeUPO不仅是一种实用算法,还为强化学习理论做出重要贡献。研究首次系统性分析了主流强化学习算法在多轮场景下的收敛性问题,填补了此前理论空白。研究证明了在多轮上下文赌博机设置下,反向更新顺序能保证收敛到全局最优策略,为未来算法设计提供新思路。对优势估计偏差的深入分析,解释了现有GRAE - PPU组合方法在多轮场景下表现不佳的原因,对理解和改进现有方法具有重要价值。SeeUPO将复杂问题分解为简单子问题的思路,为处理其他复杂序列决策问题提供了新范式。

Q&A

问:SeeUPO是什么?

答:SeeUPO是阿里巴巴通义实验室开发的新型强化学习算法,用于训练大型语言模型做智能体。它将多轮互动问题转化为多智能体问题,采用反向更新顺序保证训练稳定性和收敛到最优解。

问:为什么SeeUPO比现有方法更好?

答:现有强化学习方法在多轮场景下无法同时实现无需额外评估网络和保证收敛性。SeeUPO通过独特算法设计解决了这一问题,实验中相比基线方法性能提升24.1%到54.6%,且训练稳定。

问:SeeUPO的反向更新顺序有什么特别之处?

答:SeeUPO从最后一轮开始向前更新策略。这样更新某一轮时,后续轮次已是最优状态,当前轮次可基于最优后续策略做决策,实现全局优化。