当前的多模态大语言模型在图像理解任务中常出现“能看不能辨”的尴尬局面:它们能描述图片中的大致场景,却无法准确回答物体数量、空间位置等需要精细视觉分析的问题。法国人工智能公司Valeo.ai联合索邦大学等机构的研究团队发现,这种缺陷源于模型训练时形成的“语言捷径”习惯——AI更倾向于依赖文字规律而非真实视觉信息进行判断。该研究以预印本形式发布于arXiv平台,提出通过改造训练数据结构来破解这一难题。

研究团队将传统图文训练数据与三类特殊任务结合,开发出名为V-GIFT(视觉驱动指令微调)的训练方法。这些任务包括:要求AI判断旋转后的图片角度,迫使模型分析物体朝向;通过黑白图标记点与彩色图乱序颜色的匹配,考验上下文颜色推理能力;在两张不同视角图片中寻找对应点,检验三维空间理解水平。这些题目均无法通过语言规律猜测答案,必须调动视觉感知模块才能正确解答。

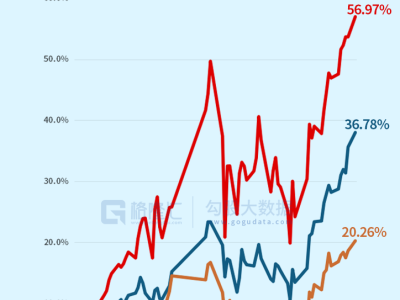

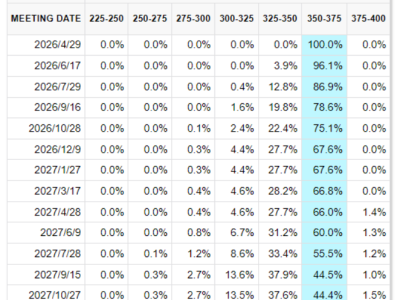

实验数据显示,在原有训练数据中仅加入3%-10%的特殊任务,即可显著提升模型视觉能力。以LLaVA-1.5-Vicuna-7B模型为例,在CVB-2D空间推理测试中得分提升2.6分,POPE物体幻觉测试提升0.2分,MMStar多维推理测试提升1.1分。更强的LLaVA-OneVision-1.5模型在BLINK视觉感知测试中提升达3.4分。值得注意的是,即使特殊任务数据仅来自单张图片的数百个裁切版本,仍能产生有效训练信号,证明关键在于题目设计而非数据规模。

可视化分析揭示了训练效果的本质变化:经过V-GIFT训练的模型在回答问题时,注意力更集中于与问题相关的图像区域。例如面对“图中有几盏台灯”的提问,传统模型注意力分散在背景区域,而改进后模型能精准聚焦台灯位置。TVI指标显示,新模型在回答时对视觉信息的依赖度提升15%-20%,有效减少了语言先验的干扰。

该方法在保持语言能力方面表现优异。测试表明,在MathVista数学推理、OCRBench文字识别等非视觉任务中,改进后模型与基线模型性能持平,部分指标甚至略有提升。这种“视觉增强而不伤语言”的特性,得益于研究团队将特殊任务与常规指令数据混合训练的设计——既强制模型使用视觉模块,又避免破坏原有语言理解能力。

对比实验进一步验证了方法优势:与需要额外损失函数的VIRAL方法相比,V-GIFT在不修改模型结构的情况下取得更好效果;单纯增加训练步数或单独进行视觉预训练均无法产生同等提升。研究还发现,特殊任务必须与常规指令微调同步进行,若分阶段训练会导致性能下降,这印证了视觉与语言能力需要协同培养的结论。

三类特殊任务呈现互补效应:旋转预测对空间关系判断提升最明显,颜色匹配有效减少物体幻觉,跨视角任务增强复杂场景理解。研究者建议根据具体需求选择任务组合——若需全面提升视觉能力,三者并用效果最佳;若专注特定领域,单一任务训练已能产生显著改善。

这项研究为多模态模型训练提供了新思路:与其不断扩充数据规模或复杂化模型结构,不如通过优化训练数据分布来引导正确的学习路径。该方法无需人工标注、不增加推理成本,仅通过改造现有训练流程即可实现性能提升,为开发更可靠的视觉语言模型指明了低成本、高效率的技术方向。完整实验细节可通过arXiv编号2604.12966查阅论文原文。