在斯坦福大学计算机科学系与亚马逊云服务(AWS)的联合研究中,一项名为AccelOpt的新技术引发了广泛关注。这项技术旨在解决AI芯片性能优化中的关键难题——如何让内核程序充分发挥硬件潜力。研究团队将这一成果发表于第九届MLSys机器学习与系统国际会议,并通过论文编号arXiv:2511.15915v2公开了完整内容。

AI加速器作为支撑大型语言模型运行的核心硬件,其性能发挥高度依赖底层内核程序的优化质量。以英伟达H100芯片为例,工程师花费两年时间才将注意力机制内核的效率提升至理论峰值的85%。而亚马逊自研的Trainium芯片由于采用新型神经元内核接口(NKI),缺乏成熟优化方案,多数内核程序仅能发挥硬件能力的40%-50%。这种现状促使研究团队探索利用AI技术实现自动化优化的可能性。

AccelOpt系统的设计灵感源自钢琴调音过程,其核心由三个智能体组成协同工作的流水线:规划师通过分析性能剖析数据确定优化方向,执行师将优化方案转化为具体代码修改,总结师则将成功经验抽象为可复用的优化规则存入记忆库。这种架构使系统能够像人类工程师一样逐步积累优化经验,形成持续进化的能力。

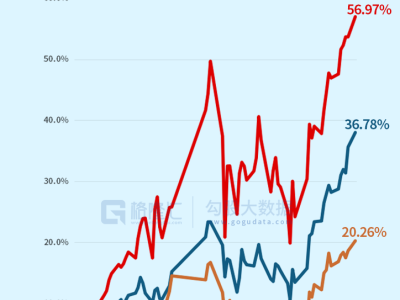

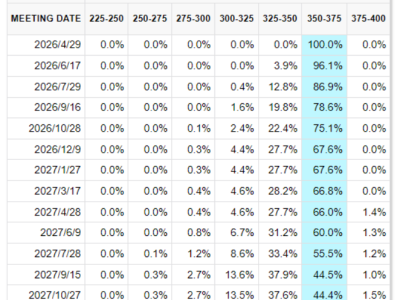

为避免优化过程陷入局部最优解,研究团队引入了束搜索机制。该机制在每轮迭代中同时维护多个候选内核版本,通过并行探索不同优化路径确保找到全局最优方案。实验数据显示,这种策略相比传统重复采样方法可提升12%-14%的优化效率,在Trainium芯片上将内核平均性能从49%提升至61%。

研究团队专门构建的NKIBench基准测试套件包含14个真实大模型工作负载,涵盖矩阵运算、注意力机制等关键算子。该测试集通过计算实际运行时间与硬件理论峰值的比值,为优化效果提供了客观衡量标准。在对比实验中,AccelOpt使用开源模型组合达到的优化效果与商业顶尖模型Claude Sonnet 4相当,但API调用成本仅为后者的1/26。

系统发现的典型优化技巧包括窥孔优化、循环变换和循环不变量外提等。在BatchMatmul+Softmax融合算子的优化案例中,AccelOpt通过重构循环结构消除数据溢出,最终将向量引擎利用率从46%提升至84%。对于Transpose+Matmul算子,系统自动识别出重复的矩阵转置操作,通过将其外提至循环外部减少了93.75%的冗余计算。

尽管AccelOpt在多数测试中表现优异,但研究团队也观察到两类优化瓶颈:对于已达到硬件峰值80%以上的内核,剩余优化空间有限;对于数据规模小于片上缓存容量的算子,硬件规格限制成为主要瓶颈。在BatchMatmul(B=16, K=64)案例中,由于张量引擎原生支持维度与问题规模不匹配,系统优化未能带来显著性能提升。

与人类专家的对比实验显示,AccelOpt在Mamba序列模型内核优化中达到54.6%的峰值吞吐量,超过NKI官方教程提供的最佳人工优化版本(52.7%)。这种超越源于系统的规模优势——其并行探索能力使单位时间内可尝试的优化方向数量远超人类工程师。

成本控制研究揭示了关键优化策略:执行师模型的选择对系统性能影响显著,而规划师模型的影响相对较小;扩大优化记忆库容量(ExpN)比增加每轮更新量(TopK)更具性价比。在Qwen3-Coder-30B模型实验中,将ExpN从8增加至16仅花费12.33美元,即带来4.6%的性能提升。

该技术的通用性已得到初步验证。在英伟达H100 GPU平台上,AccelOpt使用gpt-oss-120b模型实现了1.27倍的平均加速,对GQA解码内核的加速倍数更高达3.19倍。研究团队认为,随着大型语言模型接触更多硬件编程案例,其在陌生平台上的优化能力有望进一步提升。

这项研究为AI芯片优化领域开辟了新路径。通过将经验积累机制与并行探索策略相结合,AccelOpt展示了自动化优化工具在特定领域超越人类专家的可能性。其开源的代码与测试套件已为后续研究奠定基础,开发者可通过GitHub项目zhang677/AccelOpt获取完整实现。