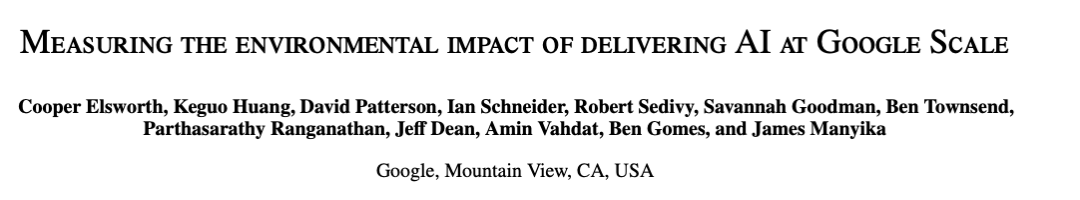

近期,关于大型AI模型能耗巨大的讨论声浪此起彼伏。对此,谷歌以其实际数据作出有力回应,展示了其Gemini模型在能源消耗方面的显著优化。

据谷歌透露,执行一次Gemini查询所消耗的电能仅为0.24瓦时,这一数值相当于微波炉运行一秒所需的电量。同时,这次查询所产生的二氧化碳排放量仅为0.03克,这一数字甚至低于人类一次放屁所产生的二氧化碳量。这次查询所消耗的水量也极为有限,仅相当于大约5滴水。

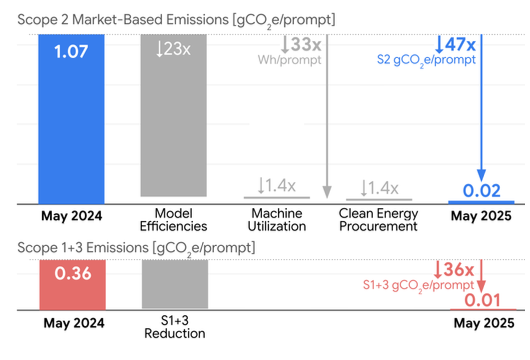

谷歌首席科学家Jeff Dean公开表示,Gemini的实际能耗远低于公众的预期。在过去的一年里,通过持续的模型优化和对清洁能源的利用,Gemini的能耗已经降至最初的三十三分之一,碳排放降至四十四分之一,同时模型的响应质量也得到了显著提升。

谷歌详细阐述了其衡量和降低AI能源消耗的方法。他们指出,目前许多关于AI能耗的计算仅考虑了理论效率,而忽略了实际运行中的多种因素。因此,谷歌开发了一套更为全面的计算方法,包括全系统动态功率、空闲计算机的能耗、CPU和内存的消耗、数据中心的整体开销以及用水量等多个方面。

在降低能耗方面,谷歌采取了全栈式的方法。从定制化的硬件、高效的模型架构,到强大的服务系统,谷歌在每一层都融入了效率优化的理念。Gemini模型采用了更高效的Transformer框架,相比之前的语言建模架构,效率有了显著提升。同时,谷歌还通过融入像MoE和混合推理等机制,进一步减少了计算量和数据传输。

在推理和服务优化方面,谷歌通过推测解码技术和蒸馏技术等手段,提升了AI的交付效率。推测解码技术允许较小的模型先进行预测,再由较大的模型进行验证,从而用更少的芯片提供了更多的响应。而蒸馏技术则可以利用大型模型生成用于服务的小型高效模型。

硬件方面,谷歌一直专注于从零开始设计TPU,以最大化每瓦的性能。最新一代TPU Ironwood的能效比首款公开TPU高出30倍,在推理任务中远超通用CPU。谷歌还通过优化空闲资源、利用高效的编译器和内核系统,进一步提升了数据中心的能源利用效率。

谷歌的数据中心也是其降低能耗的关键环节。其整体平均能源使用效率(PUE)可达1.09,是业界最高效的数据中心之一。在数据中心运营方面,谷歌持续增加清洁能源的使用,以实现全天候无碳运行的目标。同时,他们还通过优化冷却系统,平衡能源、水资源和排放之间的权衡,进一步减少了能耗和水资源的消耗。