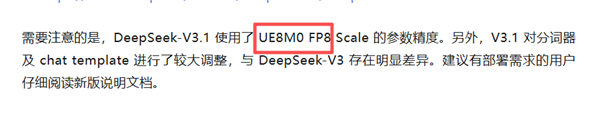

近期,深度求索公司震撼发布了其最新版本的DeepSeek-V3.1,其中一项尤为引人注目的更新便是对UE8M0 FP8格式的支持。这一举措不仅标志着DeepSeek在技术研发上的重大突破,也预示着国产芯片设计即将迈入一个全新的时代。

在DeepSeek官方发布的公告中,明确指出UE8M0 FP8是专为即将面世的下一代国产芯片量身定制的数据格式。这一格式旨在通过更高的灵活性和效率,支持复杂模型的推理过程,从而显著提升芯片的解码效率与运算能力。

东莞证券对此进行了深入分析,指出UE8M0 FP8格式的采用将为国产芯片适配更大规模的AI模型提供可行的技术路径,进而加速国产AI算力生态的构建与完善。这一变化无疑将对整个AI产业产生深远的影响。

那么,UE8M0 FP8究竟是何方神圣?它又将如何改变行业格局呢?据清华大学计算机系人工智能所博士、人工智能领域专家梁斌介绍,DeepSeek此次强调的UE8M0 FP8与英伟达的FP8格式存在显著差异,属于两套不同的标准。

梁斌进一步解释说,随着AI模型的不断发展和复杂化,显存资源显得愈发紧张。因此,需要通过量化技术来压缩模型参数的表达。FP32格式使用32位来表达一个参数,而FP8格式则仅用8位。在可接受的精度损失范围内,使用更低的位数表达参数可以显著提升显存的利用率。

他进一步指出,英伟达的FP8方案(如E4M3/E5M2)与DeepSeek的UE8M0方案在小数表达上存在明显区别。前者保留了3-2位的小数表达,从而保证了较高的精度;而后者则完全舍去了小数部分,以换取更低的功耗、更快的运算速度和更宽松的芯片要求。

梁斌强调,DeepSeek此次支持UE8M0 FP8格式,无疑是在向英伟达发起挑战,同时也为国产芯片厂商指明了方向。未来,AI推理模型将面临两种选择:要么遵循DeepSeek的体系,要么坚守英伟达的阵营。而国内芯片公司显然更倾向于前者,纷纷向UE8M0 FP8标准靠拢。

“华为等国内巨头为了适配这一标准,正全力以赴。一旦成功,将载入史册。DeepSeek此举无疑展现了巨大的勇气和决心,将国产大模型的发展推向了一个前所未有的高度。”梁斌感慨道。