波士顿动力携手丰田研究院,为人形机器人Atlas开创性地引入了大型行为模型(LBM),这一突破性的合作旨在让Atlas具备执行复杂长远操控任务的能力。通过构建“端到端的语言调节策略”,Atlas得以充分利用其身体各项功能,如灵活迈步、精确定位、蹲伏动作、重心转移及自我避障,这些对于解决真实世界中的移动操控挑战至关重要。

为了构建起这一通用化策略体系,波士顿动力采取了四步走的策略。首先,他们通过真实环境下的机器人硬件操作和模拟环境远程操作,广泛收集行为数据。随后,这些数据经过精心处理、注释和管理,被输入到机器学习管道中。紧接着,利用涵盖所有任务的数据集,训练神经网络策略。最后,通过任务测试套件对策略进行评估,评估结果将指导后续数据收集的方向,以及网络架构或推理策略的优化。

在策略制定过程中,波士顿动力坚守三大核心原则。为了最大化任务覆盖率,面对收集高质量、灵敏运动数据,尤其是静态操控任务以外的数据的挑战,公司开发了远程操作系统,将Atlas的模型预测控制器(MPC)与定制虚拟现实(VR)界面相结合,覆盖了从精细手指操作到全身伸展运动的广泛任务。其次,基于多任务数据训练策略在泛化与恢复能力上展现出的优势,波士顿动力采用了多任务、语言调节策略,整合了Atlas的预训练数据、上身操控测试台(MTS)数据及丰田研究院的数据,旨在简化部署、共享策略改进,并逐步解锁紧急行为。最后,他们构建了支持快速迭代与严谨科学的基础设施,结合模拟、硬件测试及面向生产的机器学习基础设施,有效探索数据与策略设计空间,推动机器人性能的持续提升。

Atlas机器人本体拥有78个自由度(DoF),确保了广泛的运动范围和高度灵活性。专为操控任务设计的Atlas MTS则拥有29个自由度,上半身与Atlas完全一致,仅省略了躯干和下半身组件,共享硬件与软件支持数据汇集训练。每个夹爪的7个自由度,使Atlas能够执行强力抓取、捏合抓取等多种策略。波士顿动力依靠Atlas头部的HDR立体摄像机,为远程操作提供态势感知和视觉输入,其成熟的MPC系统能够在保障平衡与避免自碰撞的同时,实现精确操作。

为了支持移动操控,波士顿动力对VR系统进行了升级,新增足部追踪器,实现了足部一对一追踪,并扩展了远程操作控制逻辑,使Atlas的站姿模式、支撑多边形、踏步意图与操作员完全匹配。升级后的VR系统,为操作员提供实时反馈,包括机器人状态、控制目标、传感器读数和触觉反馈,通过增强现实和控制器触觉功能,实现了操作员与机器人的深度同步。

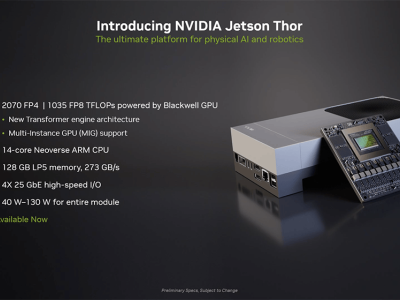

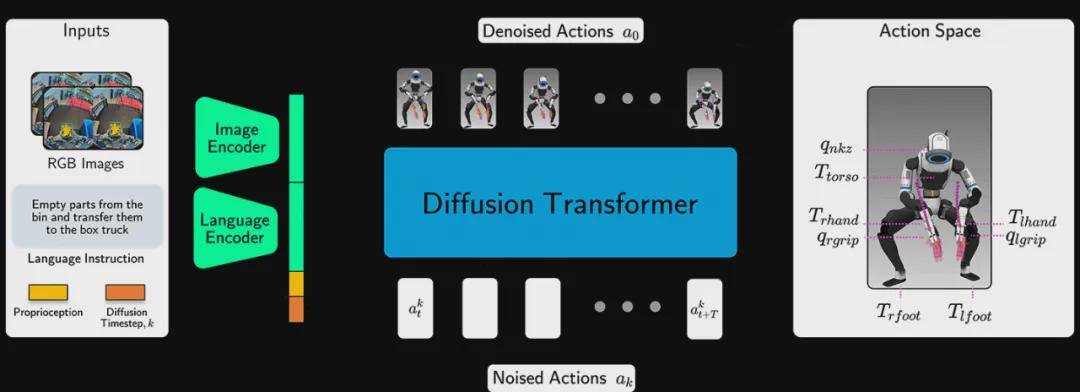

波士顿动力以丰田研究院的LBM为基础,构建了采用4.5亿参数扩散变压器架构与流匹配目标的策略架构。该策略以本体感觉、图像为条件,接收语言提示指定目标,预测并执行动作块。模拟技术在研发中发挥了关键作用,波士顿动力的模拟堆栈忠实还原了硬件与软件堆栈,加速了远程操作系统的迭代,保障了研发进度,同时作为联合训练数据源,为硬件部署的多任务、多体现策略提供了数据支持。

在“Spot Workshop”演示中,Atlas展现了其全身协同能力,完成了包括位置调整、重心降低、精确捏合动作在内的三项连贯子任务,同时避免了自碰撞与环境障碍。依托Atlas MTS上的单一语言调节策略,Atlas能够完成从简单拾取放置到复杂操作如系绳、翻转吧台凳、展开铺平等多种任务,甚至能够操控重达22磅的汽车轮胎。这些任务因几何形状可变和操作序列复杂,传统机器人编程技术难以实现,而LBM的“演示即学习”优势则让这一切成为可能。

波士顿动力公司的策略在推理阶段能够灵活调整执行速度,无需改变训练时间,通过将策略速度提升1.5倍至2倍,显著提升了效率,尽管部分任务动态限制了速度提升,但在特定场景下,机器人速度已超越人类远程操作极限。波士顿动力公司已证明,该技术能够训练多任务语言调节策略,控制Atlas完成涉及运动和灵巧全身操控的长距离任务,其数据驱动方法具有通用性,几乎可用于任何可通过远程操作演示的下游任务。