在人工智能领域,一个长期存在的技术难题是:如何让多个经过专门训练的AI模型协同工作,同时避免性能下降和任务干扰。法国研究团队近期提出了一种创新解决方案——DivMerge技术,这项突破性成果已在知名学术预印本平台arXiv发布,为多任务AI模型的高效整合开辟了新路径。

传统方法在处理多任务AI时面临两难困境:要么为每个任务单独训练模型,导致资源浪费和部署复杂;要么采用通用模型,却难以在所有任务上达到专业水平。更棘手的是,当尝试合并多个专业模型时,常出现"任务干扰"现象,就像让擅长中餐的厨师突然改做法餐,最终可能两头都做不好。研究团队开发的DivMerge技术,通过独特的模型组合方式,成功破解了这一难题。

该技术的核心创新在于"智能任务向量组合"。每个AI模型经过特定任务训练后,其参数会形成独特的"任务向量",记录从通用能力到专业技能的转变轨迹。DivMerge采用基于信息论的动态调配策略,根据任务间的相似性和差异性,自动确定最优组合比例。这种方法如同经验丰富的调酒师,能根据不同酒类的特性和客人偏好,精准调配出完美鸡尾酒。

信息论在技术实现中发挥了关键作用。研究团队运用Jensen-Shannon散度这一数学工具,量化不同模型之间的"距离"。这种度量方法具有对称性,无论比较顺序如何都能得到一致结果,就像测量两个城市间的距离不会因方向改变而变化。基于这种精确的距离衡量,系统能自动学习最优组合方式,且整个过程无需额外标注数据,大幅降低了应用门槛。

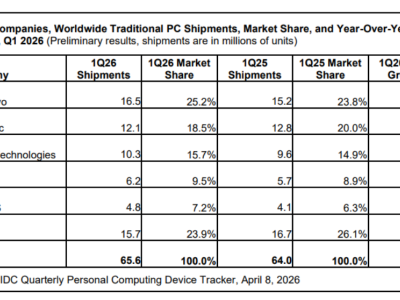

实验数据充分验证了技术优势。在涵盖语法判断、情感分析等任务的GLUE基准测试中,DivMerge在双任务合并场景下,分类任务性能保持率达99.18%,生成任务达98.93%,远超传统方法的88.48%和94.38%。当任务数量增加到7个时,其分类任务性能仍维持在93.06%,而传统方法已骤降至60.51%,显示出卓越的扩展能力。

技术实现层面,DivMerge展现了令人惊叹的简洁性。整个优化过程可通过标准梯度下降方法完成,无需复杂参数调优或特殊训练技巧。研究证明,当优化目标达到最小值时,合并模型能完美实现"权重分离",确保不同任务参数互不干扰,就像专业厨房中每位厨师都有独立工作台,既能协作又能专注各自领域。

深入分析揭示了技术成功的内在机制。研究发现,模型间的散度度量与交叉任务性能存在显著负相关,Jensen-Shannon散度在多数情况下表现优于KL散度。训练动态观察显示,不同任务权重呈现差异化调整:某些任务权重相对独立,另一些则会根据合作任务特性动态变化,反映了AI任务间复杂的关系网络。

实际应用考量方面,技术展现出极强的适应性。仅需25个验证样本(约占原始训练数据0.4%)就能达到理想效果,极大降低了数据需求。在多种模型架构上的测试表明,无论是纯解码器架构的Qwen2.5-0.5B,还是编码器-解码器架构的T5-Base,DivMerge都能保持稳定性能,验证了其通用性和鲁棒性。

这项突破为AI技术落地开辟了新可能。以科技公司为例,面对客户服务、产品推荐、内容审核等多个AI系统,传统方案要么资源消耗巨大,要么牺牲专业性能。DivMerge技术能将这些专业模型智能合并为多功能超级模型,既保持各领域专业能力,又显著降低部署成本,对资源有限的中小企业尤其具有价值。

在教育领域,该技术可助力构建全科目智能教学助手。通过合并数学、语言、历史等科目的专业AI教师模型,系统能为学生提供更全面的学习支持。医疗健康领域同样受益,不同专科的AI诊断系统可整合为综合诊疗平台,为医生提供更完整的决策依据。

技术局限性方面,研究团队坦诚指出当前方法主要在全参数微调设置下验证,在低秩适应等参数高效微调场景下的表现尚需进一步探索。数据分布假设方面,虽然提供了分布偏移的理论分析,但实际应用中的近似分布处理仍需深入研究。随着任务数量持续增长,性能下降问题也提示需要更高效的大规模任务合并策略。

这项研究不仅提供了具体的技术解决方案,更展示了数学理论指导技术开发的成功范例。基于信息论的散度度量、权重分离的理论保证,以及与经典多任务学习的深层联系,为技术的持续改进和扩展奠定了坚实基础。其核心价值在于开创了AI能力整合的新范式——通过智能化组合而非简单叠加实现能力提升,为构建更智能、高效的AI生态系统提供了重要启发。