随着AI编程逐渐融入开发者日常,代码生成效率与规模大幅提升的同时,支撑AI运转的开发工具与基础设施正成为新瓶颈。近期,旧金山AI编码基础设施初创公司Relace宣布完成2300万美元A轮融资,由硅谷知名风投机构Andreessen Horowitz(a16z)领投,Matrix Partners与Y Combinator跟投。这家仅8人的团队,正瞄准这一被忽视的市场空白。

Relace的两位联合创始人Preston Zhou与Eitan Borgnia的履历颇具硅谷特色:二人均毕业于加州理工学院,Zhou在哈佛大学攻读物理学博士期间,于Mitrano Lab从事超快量子物质动力学研究;Borgnia则在马里兰大学College Park跟随机器学习领域学者Tom Goldstein,后进入芝加哥大学师从Ben Zhao攻读机器学习博士。三年前,他们从各自的博士项目退学,投身创业,经历了6次业务转型后,于2023年通过Y Combinator孵化器正式成立Relace,当时团队不足5人。

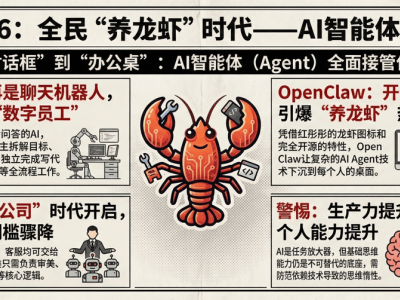

短短两年间,Relace已服务超过40家客户,其中不乏Lovable、Figma、Magic Patterns等明星AI应用公司。在两位创始人看来,软件开发正经历根本性变革——过去代码由工程师逐行编写,所有工具围绕人类工作流程设计;如今,代码越来越多由AI智能体自动生成,它们需要的不是图形界面,而是高频读写、快速合并、智能检索的底层能力。传统开发工具虽功能强大,但设计逻辑仍基于人类开发者:UI界面复杂、代码仓库数量限制、每小时操作次数有限,这些配置在AI智能体并发运行时显得捉襟见肘。

Relace的核心产品围绕三种专用模型展开。首先是Apply模型,它能将AI生成的代码编辑无缝合并回主代码库,无需重写周围代码块——这是通用大语言模型常遇到的难题。据Zhou透露,Apply模型的合并速度超过每秒1万个tokens,比使用GPT-4o mini快至少50倍,语义层面的代码合并可在700毫秒内完成。其次是Embedding模型与Reranking模型,二者形成双阶段检索机制:前者从庞大代码库中快速定位相关文件,后者进一步筛选排序,确保AI智能体获取最准确的上下文信息。测试显示,这套组合能在1至2秒内完成检索,且在实验中占据AI智能体执行链路超过50%的token消耗,优化后不仅速度提升,成本也大幅降低。

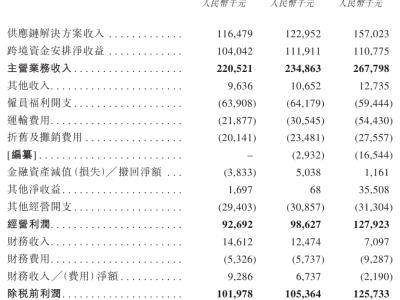

成本问题已成为AI编程行业的痛点。近两年,AI编程工具快速普及,但许多公司虽产品受欢迎,毛利率却惨淡。推理模型虽提升了代码生成能力,却也带来更高推理成本,挤压利润空间。例如,AI编程助手Replit在2025年的毛利率一度陷入负14%至负36%的区间,高昂的模型调用成本是主因。Relace的策略是“小型专用模型+优化基础设施”,针对特定任务训练更小的模型,再通过基础设施协同优化提升效率,而非依赖最昂贵的通用大模型。

除三大模型外,Relace还在构建完整的开发生命周期基础设施,涵盖版本控制、部署、代码库状态管理等环节。此次融资同步推出的Relace Repos,是其首个重量级产品。Repos是专为AI智能体设计的源代码控制系统,完全兼容git协议,但架构上做了针对性改造:支持极高频次的git操作、允许组织创建远超传统限制的仓库数量、为短生命周期沙盒容器分配细粒度访问权限。Repos还深度集成了Relace的Embedding与Reranking模型,使代码检索和上下文加载成为原生能力。

Relace的长期目标是成为企业搭建AI编程智能体的“一站式平台”。未来几个月,他们计划发布Relace代理,针对端到端任务训练,例如快速遍历代码库、自动合并冲突、智能重构代码库。a16z在领投博文中指出,过去代码由人类手工编写,如今代码正成为生成式AI的基础,每个新功能、自动化操作背后都是代码的生成与执行。当这一转变发生时,瓶颈从“如何写代码”变为“如何运行代码”。他们认为,未来突破点不在于更大基础模型,而在于更小、更专的模型配合优化基础设施——这正是Relace的路径。

当前,“提示词生成应用”平台快速增长,传统SaaS厂商也将编码Agent嵌入产品,AI自动生成的代码量持续攀升。但问题在于,几乎每家想做AI编码的公司都在重复造轮子——搭建自己的工具链、沙盒环境、源代码管理系统。这些本应成为“商品化服务”的基础组件,如今却被当作竞争优势,效率低下。类比Web开发演进,数据库、部署流程等早已外包给专业服务商,Relace的赌注是AI编码领域也会走向标准化,而他们希望成为提供基础设施的玩家。