当全球AI领域还在为巨型模型动辄万亿的参数规模惊叹时,一场以提升算力效率为核心的变革正在底层技术层面悄然推进。由开源推理引擎vLLM核心团队创立的AI基础设施公司Inferact正式亮相,宣布将通过重构推理技术体系,为人工智能商业化落地开辟全新路径。这一举动被业界视为AI发展从模型竞赛转向工程化落地的关键转折点。

在种子轮融资中,Inferact以8亿美元估值获得1.5亿美元投资,投资方阵容堪称豪华:硅谷顶级风投Andreessen Horowitz与光速创投联合领投,红杉资本、Altimeter Capital、红点创投及中国真格基金等全球知名机构跟投。这笔资金将用于加速vLLM的商业化进程,推动其成为全球AI推理领域的标准解决方案。

作为开源社区的明星项目,vLLM已展现出强大技术实力。该引擎支持超过500种模型架构,兼容200余种硬件加速器,目前承担着全球范围内大规模AI推理任务。其核心优势在于通过优化内存管理和计算调度,将推理成本降低至行业平均水平的三分之一,同时保持毫秒级响应速度。这种技术突破使得AI应用能够突破算力瓶颈,实现真正意义上的规模化部署。

AI商业化进程正面临关键分水岭。随着大模型从实验室走向实际应用,推理环节的算力消耗呈现指数级增长。据行业数据显示,当前AI系统运行成本中,推理阶段占比已超过60%,且仍在持续攀升。Inferact的解决方案直击这一痛点,通过软硬件协同优化,目标将推理成本再降低一个数量级,为AI在医疗、金融、制造等领域的深度渗透创造条件。

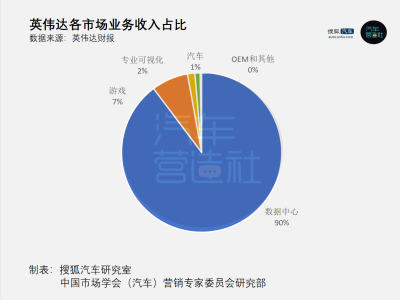

这场变革标志着AI基础设施竞争进入新阶段。过去五年,行业焦点集中在模型训练环节,催生了价值数百亿美元的算力市场。但随着应用场景的拓展,推理效率正在成为决定AI商业价值的核心指标。Inferact的崛起预示着,能够提供低成本、高效率推理方案的企业,将在下一代AI竞争中占据主导地位。其技术路线已引发英伟达、AMD等硬件厂商的密切关注,多方合作正在酝酿之中。