在数字化浪潮席卷全球的当下,人工智能技术正以惊人的速度重塑产业格局。从企业运营到社会治理,AI的规模化应用已成为推动效率提升与模式创新的核心动力。2025年,这项技术已突破试点阶段,在金融、医疗、制造等关键领域形成体系化布局,成为支撑数字化转型的"基础设施"。

安全领域成为AI技术竞争的新战场。普华永道最新调研显示,全球47%的企业将AI列为网络安全投资的首要方向,63%的网络安全预算用于开发智能防御系统。Gitnux行业报告预测,到2026年,AI驱动的安全方案将能够拦截超过90%的网络攻击,这一数据较2023年提升了近40个百分点。某国际科技公司的安全团队已实现每秒3.6万次的自动化威胁扫描,攻击检测效率达到传统方法的200倍。

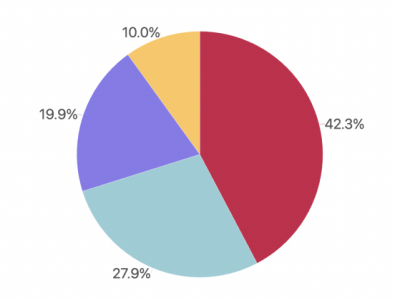

技术红利与安全风险的博弈日益激烈。埃森哲对全球2000家企业的调查发现,仅10%的组织具备应对AI安全挑战的完整能力,36%的安全负责人承认现有防护体系已落后于技术发展速度。这种失衡在金融行业尤为突出——某跨国银行在部署AI风控系统后,虽然成功拦截了85%的欺诈交易,但新型深度伪造攻击却导致其客户信息泄露量同比增加3倍。

企业正在探索动态平衡之道。某汽车制造商通过建立"AI安全实验室",将安全团队嵌入研发流程,使新车型的网络安全验证周期缩短40%。某电商平台则采用"对抗性训练"模式,让安全系统与AI攻击模型持续博弈,成功将账户盗用率控制在0.02%以下。这些实践表明,安全防护需要与AI技术发展保持同步迭代。

技术伦理问题随之浮现。某AI安全公司发现,其训练数据中包含的偏见导致系统对特定地区用户的验证准确率降低15%。这促使行业开始建立"安全即服务"标准,要求AI供应商在产品交付时必须附带安全评估报告。欧盟已出台法规,要求高风险AI系统必须通过第三方安全认证才能进入市场。