亚马逊正加速推进其自研AI芯片战略,计划通过Trainium和Inferentia两款专用芯片构建AI大模型开发的核心算力体系。这一举措被视为对英伟达主导的AI GPU市场发起直接挑战,尤其在AI推理需求爆发和"微训练"趋势下,性价比优势可能重塑行业格局。亚马逊人工智能基础设施负责人彼得·德桑蒂斯公开表示,使用自研芯片构建模型的成本将显著低于纯AI大模型提供商,这为降低超大规模AI数据中心建设成本提供了关键路径。

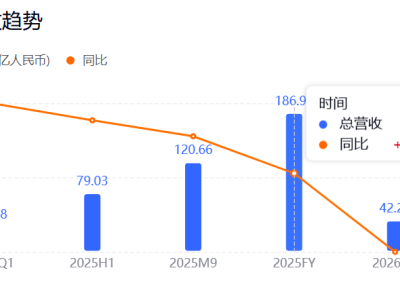

作为全球云计算龙头,AWS此次将自研芯片从边缘算力升级为前沿模型开发的核心支撑,标志着AI ASIC技术路线进入新阶段。虽然谷歌TPU已验证专用芯片在推理场景的可行性,但亚马逊的突破在于将ASIC直接应用于训练环节。德桑蒂斯强调,AI技术普及的前提是成本重构,而自研芯片正是实现这一目标的关键工具。公司计划将2026年约2000亿美元资本支出中的相当部分投入AI算力基础设施升级,显示其战略决心。

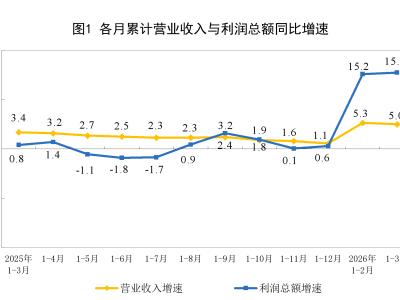

市场对英伟达的担忧在股价波动中显现。尽管这家芯片巨头最新财报超预期,但股价仍下跌5%,反映出投资者对超大规模云厂商自研芯片趋势的警惕。英伟达目前占据AI芯片市场近90%份额,但其GPU体系正面临专用芯片的性价比冲击。亚马逊Trainium2在价格性能比上较GPU云实例提升30%-40%,谷歌Gemini 2.0已完全基于TPU运行,这些案例表明专用芯片在训练推理场景的产业化应用已进入成熟阶段。

行业分析指出,AI推理时代的竞争焦点已从峰值算力转向单位token成本、能效比等指标。专用ASIC芯片通过定制数据流、编译器和互连架构,在特定工作负载中展现出明显优势。谷歌Ironwood系列TPU明确定位为"推理时代而生",强调算力集群性价比与可扩展性,这种技术路线正被亚马逊等厂商效仿。不过,英伟达构建的CUDA生态壁垒仍难以逾越——全球超400万开发者依赖其开发工具链,复杂模型训练和快速迭代场景短期内仍需GPU支撑。

现实中的技术路线呈现分层共存态势。AWS在推进自研芯片的同时,仍将在高端训练层保留GPU架构,并继续提供基于英伟达的算力服务。这种策略反映出超大规模厂商的真实意图:通过ASIC降低推理和自有模型栈的成本,同时利用GPU处理需要快速迭代的复杂训练任务。彭博分析师认为,未来三年AI算力市场将形成"GPU+ASIC"的混合格局,专用芯片的冲击更多表现为重塑产业利润分配,而非彻底取代通用GPU。

资本市场的反应折射出行业变革的复杂性。英伟达虽面临议价权下滑和份额被分食的压力,但其生态优势仍构成坚实护城河。亚马逊的突破证明专用芯片具备训练大模型的能力,但要完全颠覆GPU体系仍需时日。这场算力革命的本质,是通用计算与专用加速的技术路线之争,而最终胜负可能取决于谁能更高效地平衡性能、成本与生态兼容性。