当人工智能(AI)开始挑战诺贝尔奖级别的物理难题,结果会怎样?上海交通大学联合多家科研机构设计了一套名为PRL-BENCH的测试题,直接从物理学顶尖期刊《物理评论快报》的最新论文中选取真实研究问题,要求AI像物理学家一样自主规划解题路径。这场测试吸引了全球六个顶尖AI模型参与,最终成绩却显示:最强的AI仅得44分,连及格线都未达到。

传统AI测试题多采用“奥林匹克竞赛”模式,题目有明确出发点、固定解题路径和唯一答案,类似“按食谱做菜”。但真实物理研究更像“在陌生厨房做一道让人精神振奋的菜”,需自主选择食材、方法和火候。现有测试无法评估AI的自主探索能力,而PRL-BENCH的诞生正是为了填补这一空白。它要求AI完成多步骤、长链条的研究任务,从理论框架选择到数值计算,全程自主规划。

研究团队从《物理评论快报》2025年8月至2026年3月的论文中精选100篇,覆盖天体物理、凝聚态物理、高能物理、量子信息与基础物理、统计物理与复杂系统五大方向。题目设计模拟真实科研任务,包含研究动机、核心任务、答案与评分标准、详细解答四部分。每道大题由多个独立小问题组成,前一问错误不会导致后续全盘崩溃,更贴近科研实际。例如,一道关于格规范理论的题目要求计算基态能量导数、判断对称性关系、模拟实时动力学演化等,答案精度要求到小数点后多位,确保评判客观性。

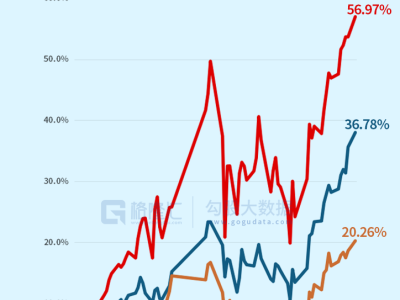

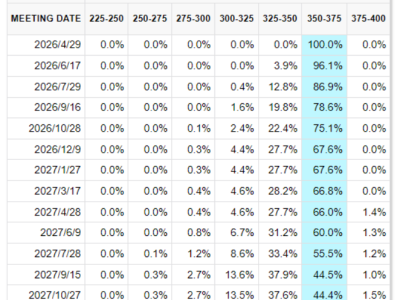

参与测试的六支AI队伍包括GPT-5.4、Gemini-3.1-Pro、Claude-Opus-4.6等当前最强模型。每道题每个模型独立作答五次取平均分,允许使用代码解释器但禁用网络检索工具,评分由GPT-5担任“裁判”。结果显示,Gemini-3.1-Pro以44.27分夺冠,Qwen-3.5-Plus以40.05分紧随其后,其余模型得分在33至38分之间。所有模型均未及格,且差距不大,反映当前AI技术普遍面临瓶颈。

从细分领域看,多数模型在天体物理和统计物理方向得分较低。研究团队分析,这两个领域问题异质化强、缺乏标准化套路,AI训练数据覆盖较少。错误类型统计显示,“公式或概念错误”占比最高,达45%至55%,AI常在第一步选错理论框架;其次是“推导错误”和“计算错误”,分别占8%至23%和20%至30%;Claude-Opus-4.6则因“不完整”类错误占比63.93%而表现异常,其推理链条常因反复自我纠正而崩溃。

这场测试暴露了AI在真实物理研究中的四大短板:领域知识深度不足,难以可靠选择理论框架;推导稳定性差,多步骤符号推理易引入错误;数值计算可靠性低,代数运算和数值计算存在明显错误率;长时程任务适应能力欠缺,缺乏全局战略规划能力。例如,凝聚态物理领域中,AI常套用不适用理论框架;高能物理方向推导错误率显著高于其他领域;部分模型在复杂任务中因上下文管理不足而回答不完整。

尽管当前AI表现不佳,但PRL-BENCH的价值在于精准定位了能力差距。研究团队指出,AI在“选对理论框架”环节失败率超半数,长时程任务全局规划能力最薄弱,这些发现为未来训练指明了方向。例如,可针对理论框架选择设计专项训练,强化多步骤推理的稳定性,提升数值计算可靠性,并培养AI在复杂任务中的全局规划能力。

对于科学界而言,这场测试的意义在于厘清AI的边界。过高期待可能导致关键科研任务被错误交付,低估潜力则可能错过有价值的应用场景。PRL-BENCH的数据集已在Hugging Face平台公开,完整论文可通过arXiv编号2604.15411查阅。这场AI与物理难题的较量,不仅是一次能力检验,更是一份指引未来研究的“路线图”。